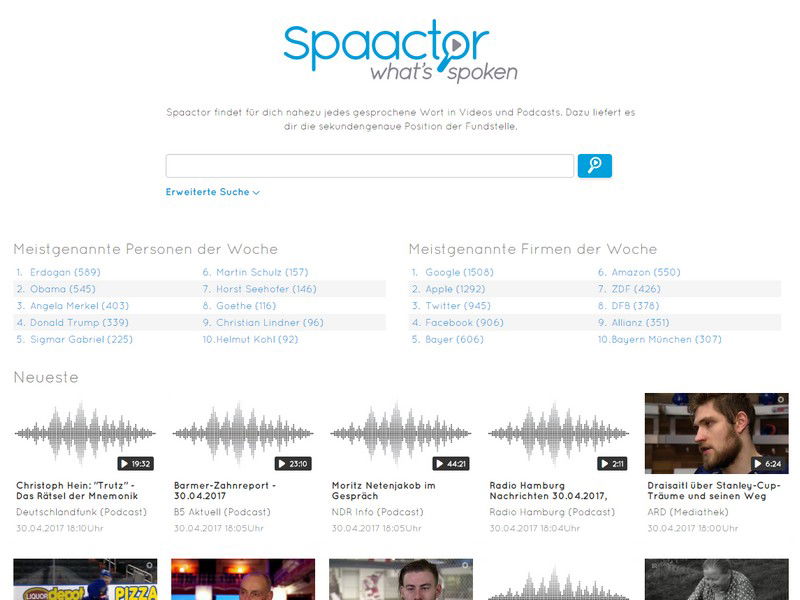

Eine neue Generation von KI-Suchmaschinen durchforstet Millionen von Videos und Podcasts nach gesprochenen Inhalten – und findet, was andere übersehen.

Videos nach einem bestimmten Begriff zu durchsuchen, etwa um an die Stelle zu springen, an der das Wort „Inflation“ fällt, war lange unmöglich. Klassische Suchmaschinen liefern zwar passende Clips, aber nur wenn das Suchwort im Titel oder der Beschreibung steht. Die Tonspur selbst blieb unsichtbar für Algorithmen.

Das hat sich 2024/2025 grundlegend geändert. KI-basierte Speech-to-Text-Technologien haben einen Qualitätssprung gemacht und ermöglichen es nun, gesprochene Inhalte mit hoher Präzision zu transkribieren und durchsuchbar zu machen.

YouTube führt Audio-Suche ein

Der große Durchbruch kam Ende 2024: YouTube hat eine experimentelle Funktion eingeführt, die es ermöglicht, in den Untertiteln automatisch transkribierter Videos zu suchen. Die Funktion nutzt Googles neueste Whisper-Alternative und funktioniert bereits für über 100 Sprachen. Besonders praktisch: Die Suche springt direkt zur entsprechenden Zeitmarke im Video.

Noch einen Schritt weiter geht AssemblyAI Universal-1, ein Modell, das seit Frühjahr 2025 auch komplexe Audioinhalte mit Hintergrundgeräuschen, Musik und mehreren Sprechern präzise transkribiert. Das System erkennt sogar Emotionen und Sprecherwechsel.

Specialized Audio Search Engines

Spezialisierte Anbieter haben den Markt für sich entdeckt:

Podcast-Suche mit Snipd und Listen Notes: Diese Plattformen durchforsten Millionen von Podcast-Episoden und liefern nicht nur Volltextsuche, sondern auch semantische Suche. Ihr könnt nach Themen fragen wie „Tipps für besseren Schlaf“ und bekommt relevante Podcast-Segmente, auch wenn diese Begriffe nicht wörtlich fallen.

Rev.com AI Search: Der Transkriptions-Spezialist hat 2025 eine öffentliche Suchfunktion gelauncht, die Inhalte aus Webinaren, Vorlesungen und Business-Meetings durchsuchbar macht – natürlich nur mit entsprechenden Freigaben.

OpenAI Whisper API: Entwickler nutzen die kostenlose API, um eigene Audio-Suchfunktionen zu bauen. Besonders interessant für Unternehmen, die ihre internen Video-Libraries durchsuchbar machen wollen.

Wie die Technologie funktioniert

Die moderne Audio-zu-Text-Konvertierung läuft in mehreren Schritten ab: Zunächst wird die Audiospur extrahiert und in kleine Segmente unterteilt. KI-Modelle analysieren dann die Frequenzmuster und wandeln sie in Text um. Dabei werden Kontextinformationen genutzt, um auch bei undeutlicher Aussprache oder Fachbegriffe korrekt zu transkribieren.

Besonders beeindruckend: Die neuesten Systeme verstehen auch Ironie, Sarkasmus und können zwischen Hauptinhalt und Nebenbemerkungen unterscheiden.

Datenschutz und Grenzen

Nicht alles ist Gold, was glänzt. Die automatische Transkription wirft Datenschutzfragen auf. Wer kontrolliert, welche Inhalte indexiert werden? YouTube gibt Creators die Möglichkeit, die Audio-Suche für ihre Videos zu deaktivieren.

Ein weiteres Problem: Die Technologie funktioniert noch nicht perfekt bei starken Dialekten, technischen Fachbegriffen oder schlechter Audioqualität. Auch die Unterscheidung zwischen ähnlich klingenden Wörtern bereitet manchmal Schwierigkeiten.

Ausblick: Was kommt noch?

Für 2026 sind weitere Durchbrüche angekündigt. Meta arbeitet an einer Echtzeit-Suche für Live-Streams, während Apple angeblich eine Siri-Integration plant, die persönliche Voice Memos durchsuchbar macht.

Spannend wird auch die Integration in Smart TVs. Samsung und LG haben bereits Prototypen gezeigt, die es ermöglichen, in aufgezeichneten Sendungen nach bestimmten Begriffen zu suchen.

Die Revolution der Audio-Suche steht erst am Anfang. Was früher unmöglich schien – das gesprochene Wort in Millionen von Stunden Videomaterial zu finden – wird zur Normalität. Für Content Creator bedeutet das: Ihre Inhalte werden auffindbar wie nie zuvor. Für uns alle heißt das: Das Wissen der Welt wird ein Stück zugänglicher.

Zuletzt aktualisiert am 03.04.2026