Die großen Social-Media-Plattformen stehen 2026 weiterhin im Zentrum der Debatte um Desinformation und ausländische Wahlbeeinflussung. Was vor Jahren mit dem russischen Eingriff in die US-Wahl 2016 begann, hat sich zu einem dauerhaften Problem entwickelt, das Facebook (jetzt Meta), X (ehemals Twitter) und andere Plattformen bis heute beschäftigt.

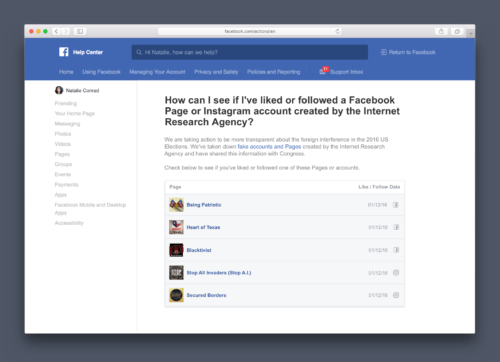

Die damaligen Anti-Propaganda-Tools von Facebook waren nur der Anfang einer langen Auseinandersetzung mit manipulativen Inhalten. Heute, fast zehn Jahre nach der Trump-Wahl 2016, wissen wir deutlich mehr über das Ausmaß der Manipulationen – und darüber, wie wenig sich fundamentell geändert hat.

Was damals als russische Wahlbeeinflussung begann, hat sich zu einem globalen Phänomen entwickelt. Chinesische, iranische und nordkoreanische Akteure nutzen heute dieselben Methoden, um westliche Demokratien zu destabilisieren. Die EU-Wahl 2024 und die deutsche Bundestagswahl standen ebenfalls unter dem Einfluss koordinierter Desinformationskampagnen.

KI verstärkt das Problem

Die Situation hat sich durch Künstliche Intelligenz dramatisch verschärft. Während 2016 noch Menschen manuell Posts und Anzeigen erstellten, generieren heute KI-Systeme in Sekunden täuschend echte Inhalte. Deepfakes von Politikern, KI-generierte Nachrichtenartikel und automatisiert erstellte Social-Media-Profile machen es fast unmöglich, authentische von manipulativen Inhalten zu unterscheiden.

Meta hat zwar seine Erkennungssysteme verbessert, kämpft aber gegen eine Hydra: Für jeden blockierten Bot entstehen zehn neue. Die Plattform entfernt monatlich Milliarden von Posts, doch die schiere Masse macht eine vollständige Kontrolle unmöglich. Besonders problematisch sind mittlerweile WhatsApp-Gruppen, wo sich Verschwörungstheorien und Falschinformationen ungehindert verbreiten.

Der Digital Services Act als Wendepunkt

Immerhin hat die EU 2024 mit dem Digital Services Act (DSA) schärfere Waffen eingeführt. Die großen Plattformen müssen jetzt transparent über ihre Algorithmen berichten und bekommen empfindliche Strafen, wenn sie Desinformation nicht effektiv bekämpfen. Meta zahlte bereits 2025 eine Rekordstrafe von 1,2 Milliarden Euro wegen unzureichender Inhaltsmoderation.

Der DSA zwingt die Plattformen auch dazu, ihre Empfehlungsalgorithmen zu überdenken. Statt nur auf Engagement zu setzen – was polarisierende Inhalte begünstigt – müssen sie jetzt auch gesellschaftliche Auswirkungen berücksichtigen. Ein kleiner Fortschritt, aber längst nicht ausreichend.

Trotz dieser Regulierung bleiben die Herausforderungen gewaltig. X unter Elon Musk hat die Inhaltsmoderation sogar drastisch zurückgefahren und gilt heute als einer der Hauptverbreitungskanäle für Desinformation. Die Plattform verzeichnet einen spürbaren Exodus seriöser Medien und Institutionen.

Neue Akteure, alte Probleme

Zu den etablierten Plattformen gesellen sich neue Herausforderer wie TikTok, dessen chinesische Eigentümerschaft zusätzliche geopolitische Spannungen schafft. Die App steht unter Verdacht, gezielt westliche Gesellschaften zu spalten, indem sie bestimmte Inhalte bevorzugt verbreitet.

Parallel dazu entstehen „alternative“ Plattformen wie Truth Social, Gettr oder Telegram, die sich bewusst als zensurfreie Räume positionieren. Dort verbreiten sich Verschwörungstheorien und extremistische Inhalte oft ungehindert. Diese Fragmentierung der Informationslandschaft macht es noch schwieriger, einen gemeinsamen Faktenbasis zu erhalten.

Was können Nutzer tun?

Angesichts dieser Lage sind Nutzer mehr denn je gefordert, selbst kritisch zu bleiben. Faktenchecker-Tools haben sich verbessert, aber sie erreichen oft nur die, die ohnehin skeptisch sind. Wichtiger ist es, das eigene Informationsverhalten zu reflektieren: Wem folge ich? Welche Quellen nutze ich? Wie schnell teile ich Inhalte?

Browsererweiterungen wie NewsGuard oder der integrierte Faktenchecker in Microsoft Edge helfen dabei, dubiose Quellen zu erkennen. Auch die großen Plattformen bieten mittlerweile Transparenz-Tools an, mit denen ihr sehen könnt, welche Daten über euch gesammelt werden und warum ihr bestimmte Inhalte angezeigt bekommt.

Der Kampf geht weiter

Die Anti-Propaganda-Tools von damals wirken heute naiv. Das Problem ist längst nicht mehr nur russische Wahlbeeinflussung, sondern ein fundamentaler Konflikt zwischen freier Meinungsäußerung und dem Schutz vor Manipulation. KI macht Desinformation billiger und effektiver, während gleichzeitig das Vertrauen in etablierte Medien schwindet.

Die Lösung liegt nicht in einem Tool oder einer Regulierung, sondern in einem gesellschaftlichen Lernprozess. Wir müssen lernen, in einer Welt voller Manipulation zu navigieren – und die Plattformen müssen endlich Verantwortung für die Gesellschaften übernehmen, in denen sie Milliarden verdienen.

Bis dahin bleibt der wichtigste Schutz vor Propaganda das kritische Denken. Denn am Ende entscheidet nicht der Algorithmus, sondern ihr selbst, was ihr glaubt.

Zuletzt aktualisiert am 31.03.2026