„Big Data“ ist längst mehr als ein Buzzword – es ist zur mächtigsten Waffe im digitalen Zeitalter geworden. Was 2016 mit dem Cambridge Analytica-Skandal begann, hat sich zu einem Dauerbrenner entwickelt: Wie Datenanalyse Wahlen, Meinungen und ganze Gesellschaften formt.

Der damalige Verdacht, Big Data hätte Donald Trump 2016 zum Präsidenten gemacht, erwies sich als Spitze des Eisbergs. Heute, 2026, sind die Methoden noch ausgefeilter, die Datenmengen noch größer – und die Auswirkungen noch dramatischer. Der damalige Artikel in Das Magazin wirkt heute fast wie eine harmlose Vorschau auf das, was inzwischen Realität geworden ist.

Cambridge Analytica ist Geschichte, aber die Nachfolger sind längst da: Palantir, Clearview AI und dutzende andere Datenbroker haben die Methoden perfektioniert. Jeder Klick, jedes Like, jede Verweildauer wird heute von KI-Systemen analysiert, die erschreckend präzise Vorhersagen über unser Verhalten treffen können.

Von TikTok-Algorithmen bis Wahlmanipulation

Die Mechanismen sind heute noch raffinierter. Während 2016 noch simple „Likes“ analysiert wurden, nutzen moderne Systeme Eye-Tracking, Scroll-Verhalten und sogar Tippgeschwindigkeit. TikToks Algorithmus kennt euch nach wenigen Minuten besser als eure besten Freunde. Instagram weiß, wann ihr depressiv seid, bevor ihr es selbst merkt.

Ein Beispiel: Wer bestimmte Fitness-Influencer folgt und gleichzeitig nachts aktiv ist, wird mit 73%iger Wahrscheinlichkeit als „gesundheitsbewusst aber gestresst“ eingestuft. Solche Menschen bekommen dann gezielt Werbung für Nahrungsergänzungsmittel oder Meditation-Apps ausgespielt.

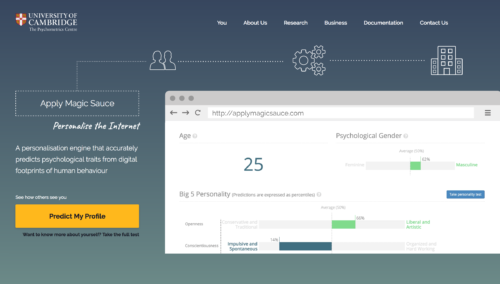

Der Apply Magic Sauce-Test von damals war nur der Anfang. Heute erstellen KI-Systeme aus wenigen Datenpunkten komplette Persönlichkeitsprofile – oft präziser als psychologische Tests.

Hyper-Personalisierung als neue Norm

Was 2016 noch revolutionär klang – individuelle Botschaften für jeden Nutzer – ist heute Standard. Netflix zeigt verschiedenen Nutzern unterschiedliche Thumbnails für denselben Film. Amazon variiert Preise in Echtzeit basierend auf eurem Kaufverhalten. Political Ads werden mittlerweile in Millionen von Varianten ausgespielt.

Besonders perfide: Die Methoden funktionieren auch in umgekehrter Richtung. Statt euch zum Kauf zu bewegen, können sie euch auch vom Wählen abhalten. „Voter Suppression“ durch gezielte Desinformation ist zum Standard-Werkzeug geworden. Bestimmte Wählergruppen bekommen gezielt Inhalte ausgespielt, die sie frustrieren und zur Wahlmüdigkeit führen sollen.

KI macht den Unterschied

Der entscheidende Unterschied zu 2016: Künstliche Intelligenz hat die Effizienz vervielfacht. Large Language Models wie GPT und Claude können in Sekunden tausende personalisierte Texte generieren. Deepfakes machen Politiker zu perfekten Marionetten. Synthetische Medien fluten Social Media mit maßgeschneiderten Inhalten.

Ein Beispiel aus dem US-Wahlkampf 2024: KI-generierte Videos zeigten Kandidaten in verschiedenen regionalen Dialekten – technisch perfekt, inhaltlich manipuliert. Millionen Nutzer sahen „ihren“ Kandidaten, der scheinbar genau ihre lokalen Sorgen ansprach.

Die Frage ist nicht mehr, ob diese Methoden funktionieren. Sie tun es – messbar und reproduzierbar. Studien belegen inzwischen, dass personalisierte Desinformation bis zu 40% effektiver ist als Streumeldungen.

Deutschland: Nicht mehr sicher

Die damalige Einschätzung, Deutschland sei durch Datenschutz geschützt, hat sich als Illusion erwiesen. Die DSGVO bietet Schutz auf dem Papier, aber die Realität sieht anders aus. Datenbroker umgehen Regulierungen durch Server in Drittländern. Dark Patterns in Apps sammeln trotzdem massenhaft Daten.

Besonders problematisch: Die EU-weite Einführung von „Digital Services“ hat neue Schlupflöcher geschaffen. Messenger-Metadaten, Gesundheits-Apps und Smart-Home-Geräte liefern heute mehr Daten als Facebook je hatte.

Deutsche Parteien nutzen längst ähnliche Methoden – nur subtiler. Microtargeting über Instagram und TikTok ist Standard geworden. Die AfD experimentiert bereits mit KI-generierten Inhalten, andere Parteien ziehen nach.

Die neue Realität: Permanent manipuliert

Heute sind wir alle permanent Ziel von Manipulationsversuchen. Nicht nur im Wahlkampf, sondern täglich. Algorithmen entscheiden, welche Nachrichten ihr seht, welche Meinungen verstärkt werden, sogar welche Freunde euch vorgeschlagen werden.

Das Perfide: Die meisten merken es nicht. Die Manipulation ist so subtil geworden, dass sie sich wie eigene Meinungsbildung anfühlt. Ihr glaubt, selbst zu entscheiden – dabei folgt ihr längst den Algorithmen.

Besonders bei jungen Nutzern zeigen Studien erschreckende Ergebnisse: 67% der 16-24-Jährigen können nicht mehr zwischen organischen und gesponserten Inhalten unterscheiden. TikTok und Instagram sind de facto zu Meinungsmaschinen geworden.

Was jetzt zu tun ist

Die Zeit für halbe Maßnahmen ist vorbei. Wir brauchen radikale Transparenz: Algorithmen müssen offengelegt, Datenflüsse nachverfolgbar werden. „Algorithmic Audits“ sollten so selbstverständlich werden wie Finanzprüfungen.

Mediale Bildung muss Pflichtfach werden – nicht nur für Schüler, auch für Erwachsene. Wer nicht versteht, wie moderne Manipulation funktioniert, ist ihr hilflos ausgeliefert.

Am wichtigsten: Wir müssen aufhören zu glauben, immun zu sein. Jeder ist manipulierbar, jeder wird täglich manipuliert. Nur wer das akzeptiert, kann sich dagegen wehren. Die Alternative ist eine Gesellschaft, in der nicht mehr Menschen entscheiden, sondern Algorithmen – und die, die sie kontrollieren.

Die Büchse der Pandora ist längst geöffnet. Jetzt geht es darum, den Schaden zu begrenzen.

Zuletzt aktualisiert am 05.04.2026