Ich habe gestern ein Selfie mit Ursula von der Leyen gemacht. Und eins mit Elon Musk. Dann noch schnell eins mit Tim Cook, Mark Zuckerberg und Jennifer Lawrence. Alles in weniger als fünf Minuten. Von meinem Schreibtisch aus. Ohne die Hose zu wechseln.

Und zum Angeben auf Social Media ein Selfie in Paris, eins in London, New York – auf dem Mond. Alles kein Problem.

Beeindruckt? Solltet ihr nicht sein. Beunruhigt? Definitiv.

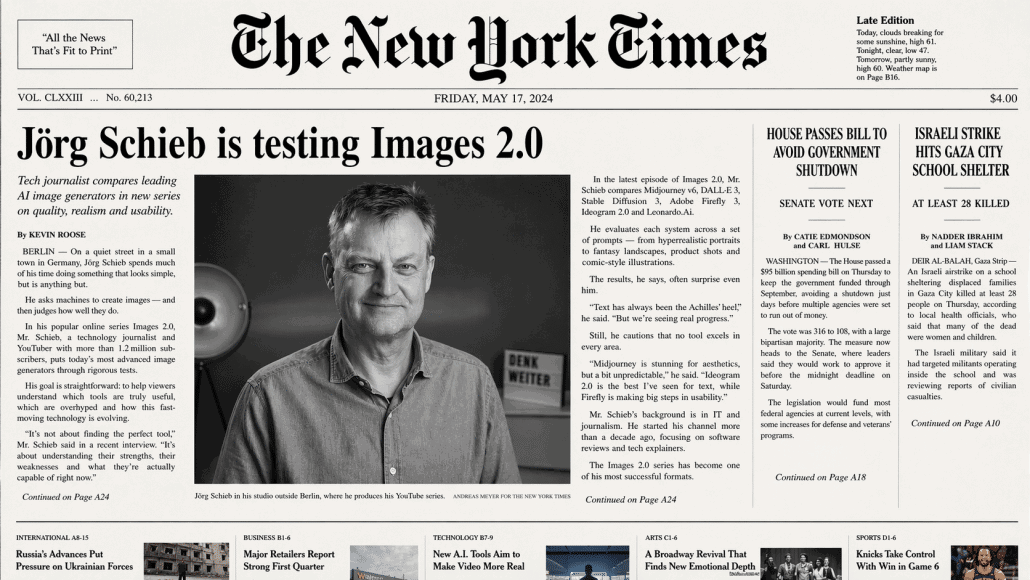

Denn ich war nie mit diesen Menschen im selben Raum. Ich war nicht mal in der selben Zeitzone. Die Bilder sehen trotzdem so echt aus, dass meine Mutter mich angerufen hat, um zu fragen, wann ich denn in Brüssel war. War ich nicht. Aber ChatGPT Images 2.0 und Nano Banana Pro waren offenbar überzeugender als dreißig Jahre mütterliche Menschenkenntnis.

Der Moment, in dem das Selfie stirbt

Es gab mal eine Zeit, da war ein Selfie mit einem Promi eine Währung. Ein Beweis. Ein „Ich war da, ich habe es erlebt, schaut her.“ Leute haben stundenlang vor Hoteleingängen gewartet, Kameras in Hollywood-Gesichter gedrückt, wildfremde Menschen gebeten, das Handy zu halten. Alles für dieses eine Bild, das dann auf Instagram dreihundert Likes bekam und den sozialen Kurs um gefühlt zwei Prozent hob.

Diese Währung ist gerade dabei, den gleichen Weg zu gehen wie die D-Mark. Abgeschafft. Nur dass diesmal nicht die EZB schuld ist, sondern ein paar Rechenzentren in Kalifornien.

Was früher Wochen Planung, eine Pressekonferenz und ein bisschen Glück brauchte, passiert heute in 12 Sekunden. Promptzeile, Enter, fertig. Und das Ergebnis ist nicht mehr dieses halb-komische Frankenstein-Bild von 2023, bei dem Merkel sechs Finger hatte und Musk aussah wie sein eigener Wachsfigur-Bruder. Die neuen Modelle liefern Hautporen, Lichtstimmung, leicht unscharfe Hintergründe, sogar das typisch schiefe Selfie-Lächeln, bei dem ein Mundwinkel höher sitzt als der andere. Ich habe Bilder gesehen, bei denen ich die Falten am richtigen Ort kenne – und sie sind da, wo sie sein müssten.

Die kleine, peinliche Wahrheit

Hier wird es unangenehm: Ein großer Teil unserer digitalen Identität besteht aus Beweisfotos. Urlaub auf Bali. Konzert von Taylor Swift. Dinner mit dem Business-Coach, den keiner kennt, aber bei dem alle so tun. LinkedIn-Foto mit einem halbwegs bekannten CEO, damit der eigene Beitrag auch drei Kommentare mehr bekommt.

Wir haben uns eine Welt gebaut, in der das Bild das Erlebnis ersetzt. In der „Pics or it didn’t happen“ nicht nur ein Scherz war, sondern eine tatsächliche Beweislastregel. Und genau diese Regel funktioniert gerade nicht mehr. Weil „Pics“ jetzt jeder hat. Von allem. Mit jedem.

Der Satz muss neu lauten: Pics? Dann ist es erst recht nicht passiert.

Wer verliert gerade wirklich?

Das betrifft nicht nur Möchtegern-Influencer, die sich jetzt virtuell neben Ronaldo photoshoppen. Das betrifft Journalismus. Das betrifft Gerichte. Das betrifft Versicherungen, Bewerbungen, Polizeiarbeit, Scheidungen. Jedes Feld, in dem ein Foto bisher als das galt, was es eben war: ein relativ stabiles Stück Wirklichkeit.

Stellt euch vor, ihr seid Richter. Angeklagter sagt, er war zur Tatzeit in München. Verteidigung legt ein Selfie vor: Angeklagter vor der Frauenkirche, Zeitstempel passt, Licht passt, Wetter passt. Früher: Fall erledigt. Heute: Was heißt hier Beweis? Ich kann euch in zehn Minuten ein Selfie liefern, auf dem ich mit Napoleon in einem Starbucks in Leipzig sitze. Hochkant. 4K. Mit korrekter Schaumkrone auf dem Latte.

Und das Problem kehrt sich um: Wenn nichts mehr echt sein muss, dann muss auch nichts mehr falsch sein. Der Minister, der auf einem kompromittierenden Foto zu sehen ist? Ach, das war doch KI. Der Polizist, dem Gewalt vorgeworfen wird, obwohl es Videomaterial gibt? KI-Fälschung, klare Sache. Wir kennen diesen Reflex schon aus der Politik, und er wird gerade zum universellen Werkzeug für alle, die Wirklichkeit nicht mehr mögen. Juristen nennen das den Liar’s Dividend – die Dividende des Lügners. Wer ohnehin lügt, profitiert am meisten davon, dass Wahrheit angreifbar geworden ist.

Die Ironie in all dem

Ausgerechnet jetzt, wo wir endlich gelernt hatten, Text-KI halbwegs zu misstrauen – „Ja, ja, ChatGPT halluziniert, man muss das prüfen“ – kommt die Bild-KI um die Ecke und macht den gleichen Trick nochmal. Nur schneller, visueller, emotional durchschlagender.

Ein Text, der sich falsch anfühlt, triggert irgendwann das innere Alarmsystem. Zu glatt. Zu generisch. Zu viele Aufzählungen mit drei Punkten. Ein Bild hingegen umgeht dieses System komplett. Wir sind evolutionär darauf trainiert, dem zu glauben, was wir sehen. Unsere Großeltern konnten sich auf ihre Augen verlassen. Unsere Eltern auch noch. Wir sind die erste Generation, bei der das nicht mehr gilt – und wir haben keine zehntausend Jahre Evolution, um uns daran anzupassen. Wir haben vielleicht noch zehn Monate, bis die nächste Modell-Generation kommt.

Was jetzt?

Ich weiß, an dieser Stelle erwartet ihr die Zeigefinger-Liste: Erkenne KI-Bilder in 5 Schritten! Achte auf Ohren und Hände! Spart’s euch. Die Zeit, in der Hände und Ohren verrieten, was echt ist, ist seit ungefähr acht Monaten vorbei. Ich habe in den Bildern, die ich euch gleich zeige, gezielt gesucht. Nichts. Die Ohren sitzen. Die Hände haben fünf Finger. Das Licht stimmt. Reflexionen in Brillengläsern? Stimmig. Schatten? Richtig.

Was bleibt, ist etwas Unbequemeres: Wir brauchen eine neue Standardannahme. Bisher galt: Ein Bild ist echt, solange nichts dagegen spricht. Ab jetzt gilt das Gegenteil: Ein Bild ist ein Vorschlag, solange seine Herkunft nicht überprüft ist. Herkunft heißt: Wer hat es gemacht? Mit welcher Kamera? Gibt es Metadaten? Gibt es ein zweites, unabhängiges Bild derselben Szene? Gibt es Zeugen?

Das ist anstrengend. Das ist spaßtötend. Das ist das Gegenteil von „einfach drauflos scrollen.“ Aber es ist die einzige intellektuelle Hygiene, die in den nächsten Jahren noch halbwegs funktionieren wird.

Und das Selfie?

Das Selfie mit dem Promi wird nicht verschwinden. Es wird nur wertlos. Wie ein auf dem Schulhof getauschter Panini-Sticker, von dem plötzlich jeder einen Drucker zu Hause hat. Die echte Währung der nächsten Jahre wird nicht mehr das Bild sein, sondern das nachweisbare Erlebnis. Der signierte Eintrag. Der verifizierte Livestream. Das gemeinsame Video mit verifizierbarer Herkunft. Das Zeugenprinzip. Das langweilige, altmodische Ich war wirklich da.

Und vielleicht, ganz vielleicht, lernen wir nebenbei wieder, dass die besten Momente ohnehin die sind, die wir nicht fotografiert haben. Weil wir zu beschäftigt damit waren, sie zu erleben.

Bis dahin: Falls ihr demnächst ein Selfie von mir und dem Papst seht – ich schwöre, ich war’s nicht. Oder doch? Schaut genau hin. Aber keine Sorge, ihr werdet es nicht erkennen.

Das Ende des Beweisfotos: Warum Selfies gerade ihren Wert verlieren

Bei dem Tempo den Überblick zu behalten, ist die eigentliche Kunst.

Den Überblick behalten, ohne jeden Hype mitzumachen – dabei hilft dir Superkraft KI Unlimited.

Jetzt Superkraft KI Unlimited entdecken →