Was einst als Adobe VoCo Schlagzeilen machte, ist heute Realität: KI kann täuschend echt menschliche Stimmen nachahmen. Voice Cloning und Deepfake-Audio sind längst keine Labor-Experimente mehr, sondern alltägliche Tools, die jeden zum Stimmen-Magier machen können.

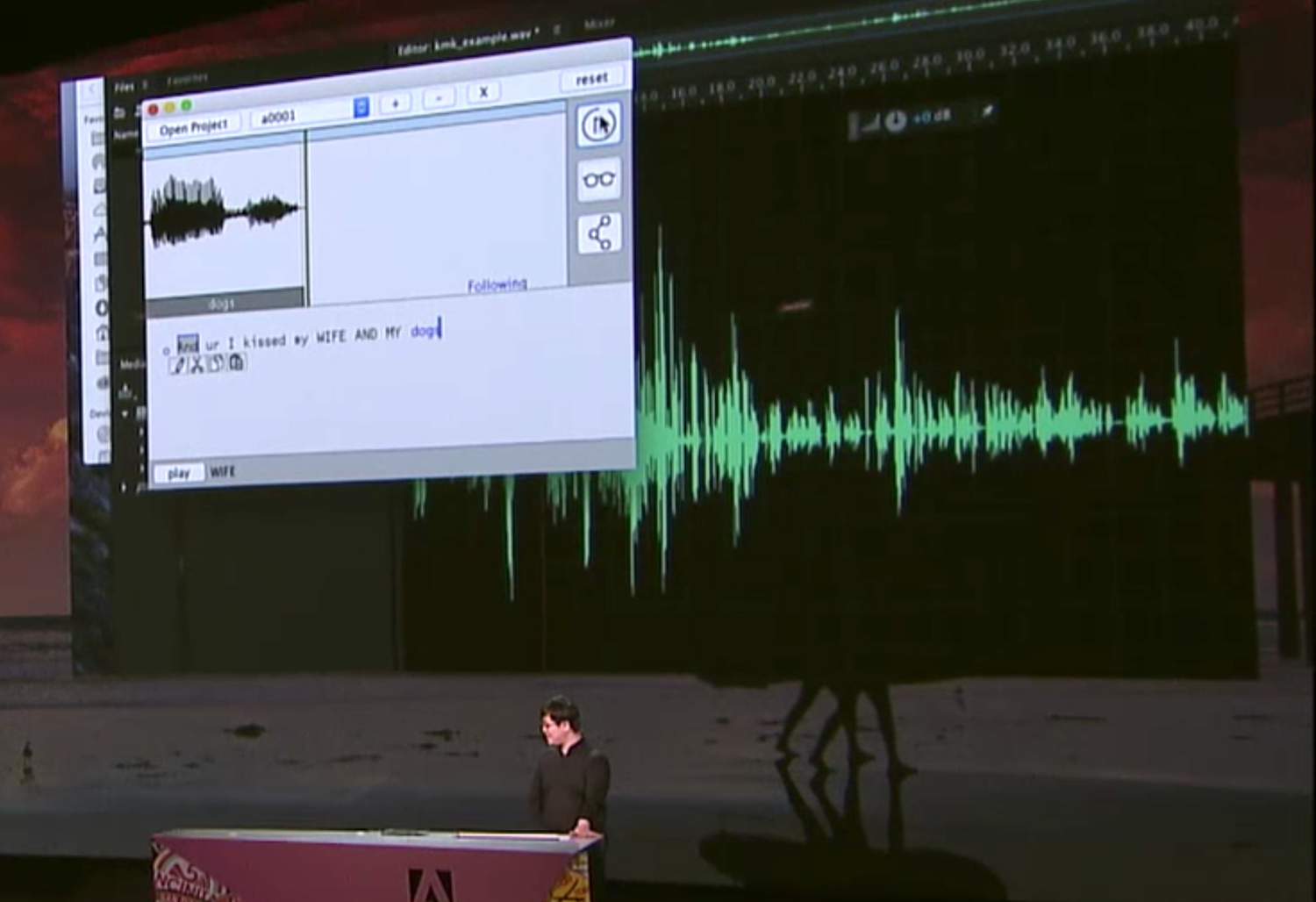

Was 2016 noch als revolutionärer Prototyp auf Adobes Max-Konferenz für Aufsehen sorgte, wirkt heute fast antiquiert. VoCo sollte ein „Photoshop für Audio“ werden – doch die Entwicklung hat das ursprüngliche Konzept längst überholt. Statt einer einzigen Software gibt es heute ein ganzes Ökosystem von Voice-Cloning-Tools, die teilweise kostenlos verfügbar sind.

Vom Prototyp zur Massentechnologie

Während Adobe VoCo nie als eigenständiges Produkt erschien, eroberten andere Anbieter den Markt. ElevenLabs, Murf, Resemble AI oder Speechify bieten heute Voice-Cloning, das VoCo in den Schatten stellt. Was damals 20 Minuten Audio-Material brauchte, schaffen moderne KI-Modelle mit wenigen Sekunden Sprachmaterial.

Die Technologie dahinter: Transformer-Modelle und neurale Netzwerke analysieren nicht nur Phoneme, sondern komplette Sprachmuster, Emotionen und sogar Atemgeräusche. Das Ergebnis sind Stimmen-Klone, die selbst Familienmitglieder täuschen können.

Realtime Voice Cloning wird mainstream

Heute geht es nicht mehr nur um nachträgliche Audio-Bearbeitung. Realtime Voice Conversion ermöglicht Live-Gespräche mit geklonten Stimmen. Streaming-Plattformen wie Twitch sehen bereits erste „VTuber“, die komplett synthetische Stimmen nutzen. Gaming-Communities experimentieren mit Voice-Changers, die nicht nur Tonhöhe verändern, sondern komplette Stimm-Persönlichkeiten erschaffen.

Besonders beeindruckend: Multilinguale Voice-Klone sprechen fließend Sprachen, die die Original-Person nie beherrscht hat. Eine deutsche Stimme kann so perfekt englisch, französisch oder mandarin sprechen – mit allen Nuancen und Akzenten.

Der Deepfake-Audio-Alltag

Was als beängstigende Zukunftsvision galt, ist Alltag geworden. Auf TikTok und YouTube kursieren Videos mit geklonten Promi-Stimmen. Podcaster nutzen KI-Stimmen für mehrsprachige Versionen ihrer Shows. Hörbuch-Verlage experimentieren mit synthetischen Sprechern, die günstiger sind als professionelle Sprecher.

Doch die dunkle Seite zeigt sich in Romance Scams, gefälschten Audio-Nachrichten von Familienmitgliedern oder manipulierten Firmen-Calls. Der „Enkeltrick“ funktioniert heute mit perfekt nachgeahmten Stimmen von Verwandten.

Schutz vor Audio-Deepfakes

Die Abwehr hält mit: Detector-Tools wie Resemble Detect oder Reality Defender erkennen synthetische Stimmen mit über 95%iger Genauigkeit. Blockchain-basierte Audio-Authentifizierung wird Standard für wichtige Aufnahmen. Manche Unternehmen führen „Stimm-Passwörter“ ein – geheime Phrasen, die nur echte Personen kennen.

Apple und Google bauen bereits Deepfake-Detection in ihre Betriebssysteme ein. Anrufe werden automatisch auf KI-generierte Stimmen gescannt und entsprechend markiert.

Kreative Revolution und neue Berufe

Parallel entstehen völlig neue Anwendungsgebiete: Verstorbene Schauspieler „sprechen“ wieder in Dokumentationen, historische Figuren halten Vorträge mit rekonstruierten Stimmen. Voice-Acting demokratisiert sich – jeder kann zum Synchronsprecher werden.

Personalisierte KI-Assistenten nutzen die Stimmen von Angehörigen, um Demenzkranken vertraute Gesprächspartner zu bieten. Sprachtherapie profitiert von perfekten Referenz-Stimmen. Der Markt für „Stimm-Lizenzen“ entsteht – Sprecher verkaufen ihre Stimm-Muster an KI-Unternehmen.

Rechtliche Grauzonen und ethische Fragen

Der Gesetzgeber hinkt hinterher. Während die USA erste Gesetze gegen non-konsensuelles Voice Cloning verabschieden, herrscht in Europa noch Rechtsunsicherheit. Stimm-Rechte werden zum neuen Urheberrechts-Kampffeld.

Besonders brisant: Politische Manipulation erreicht neue Dimensionen. Gefälschte Statements von Politikern können Wahlen beeinflussen, bevor Fact-Checker reagieren. Die Wahrheit wird zur Interpretationssache.

Die Zukunft ist bereits da

Was Adobe VoCo anstieß, ist heute Massentechnologie. Voice Cloning Apps gibt es im App Store, Browser-basierte Tools funktionieren ohne Installation. Die Frage ist nicht mehr ob, sondern wie wir mit einer Welt umgehen, in der jede Stimme kopierbar ist.

Die Lösung liegt nicht im Verhindern, sondern im bewussten Umgang: Kritisches Hinhören wird zur Schlüsselkompetenz, Verifikation zur Routine. Wir lernen, dass auch Gehörtes nicht automatisch wahr ist – genau wie bei manipulierten Bildern.

Die Audio-Revolution hat längst begonnen. Adobe VoCo war nur der erste Schuss.

Zuletzt aktualisiert am 05.04.2026