Was hat uns das Internet an Freiheit gebracht: Jeder kann offen seine Meinung sagen, schreiben und zeigen. Meinungsaustausch mit der ganzen Welt – wunderbar. Funktioniert aber nur dann gut, wenn sich die Menschen gegenseitig respektieren.

Aber die traurige Erkenntnis ist: Der Mensch neigt zum Missbrauch. Im Schutze der Anonymität wird gepöbelt, angefeindet, aufgehetzt, getrollt und gelogen – und das leider immer öfter und immer intensiver. Das Netz vervielfältigt das Gute wie das Schlechte. Fakten und Wahrheiten werden von jedem selbst gemacht – und tatsächlich diskutieren, Argumente austauschen, das kommt immer seltener vor.

KI-Moderation auf allen großen Plattformen

Im Silicon Valley setzt man zum Lösen von Problemen auf Technik – auch bei Problemen, die durch Technik erst entstanden sind. Was vor Jahren noch ein Experiment war, ist heute Standard: Alle großen Plattformen nutzen inzwischen KI-gestützte Moderationssysteme.

X (ehemals Twitter) hat sein Moderationssystem nach der Übernahme durch Elon Musk 2022 komplett umgekrempelt. Statt auf Algorithmen zur Unterdrückung von Hasskommentaren zu setzen, verfolgt die Plattform seit 2024 einen „Community Notes“ Ansatz: Nutzer können problematische Inhalte selbst mit Kontext-Hinweisen versehen. Ein demokratischer Ansatz, der aber auch neue Herausforderungen bringt.

Meta (Facebook, Instagram) setzt hingegen auf eine Kombination aus KI-Moderation und menschlichen Prüfern. Die Systeme werden kontinuierlich mit neuen Hassrede-Mustern trainiert und erkennen inzwischen auch subtilere Formen von Toxizität. TikTok hat sogar Echtzeit-Intervention eingeführt: Während ihr einen Kommentar tippt, warnt die App bereits vor potentiell problematischen Formulierungen.

Googles Perspective API: Vom Experiment zum Standard

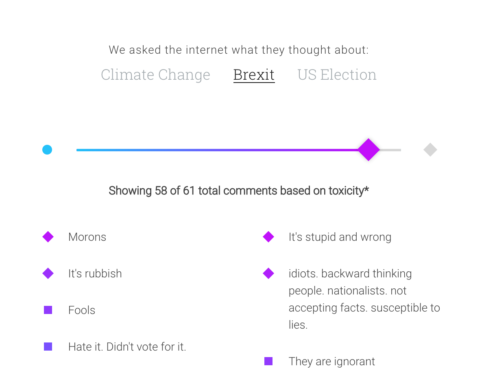

Was 2017 als experimentelle API startete, ist heute ein ausgereiftes Tool, das von tausenden Websites genutzt wird. Google Perspective API analysiert Kommentare in Echtzeit und bewertet deren „Toxizität“ auf einer Skala von 0 bis 100.

Das System wurde massiv weiterentwickelt: Statt nur englische Texte zu verstehen, funktioniert es heute in über 30 Sprachen. Es erkennt verschiedene Arten von problematischen Inhalten – von direkten Beleidigungen über Identitäts-basierte Angriffe bis hin zu Drohungen und Spam.

Besonders clever: Die API lernt aus dem Feedback der Community. Wenn Moderatoren Entscheidungen korrigieren, fließt das in die Verbesserung des Algorithmus ein. Reddit, YouTube und viele News-Websites nutzen das Tool bereits standardmäßig.

Neue Ansätze: Präventive Maßnahmen gewinnen

Statt nur auf Filterung zu setzen, experimentieren Plattformen zunehmend mit präventiven Ansätzen. Instagram fragt seit 2023: „Bist du sicher, dass du das posten möchtest?“ wenn die KI potentiell verletzende Kommentare erkennt. Studien zeigen: Allein diese Pause reduziert toxische Posts um 30%.

LinkedIn geht einen anderen Weg: Die Plattform belohnt konstruktive Diskussionen durch bessere Sichtbarkeit und bestraft Accounts, die häufig gemeldete Inhalte posten, durch reduzierte Reichweite.

Community-getriebene Moderation wird zum Trend

Ein besonders interessanter Ansatz kommt von kleineren Plattformen: Mastodon und andere dezentrale Netzwerke setzen auf Community-Moderation. Jede Instanz kann ihre eigenen Regeln definieren und durchsetzen. Das führt zu homogeneren, aber oft auch zivileren Communities.

Discord hat mit seinem Server-basierten Ansatz ähnliche Erfolge: Einzelne Communities können ihre Moderationsrichtlinien selbst bestimmen und mit Bots automatisieren. Das Resultat: Deutlich weniger toxisches Verhalten in gut moderierten Servern.

Was bringt die Zukunft?

Die nächste Generation von Moderationstools setzt auf multimodale KI: Systeme, die nicht nur Text, sondern auch Bilder, Videos und sogar Tonfall in Sprachnachrichten analysieren können. OpenAI arbeitet bereits an entsprechenden Tools.

Besonders vielversprechend ist der Ansatz des „Positive Reinforcement“: Statt nur negative Inhalte zu bestrafen, werden konstruktive Beiträge aktiv gefördert. YouTube testet bereits Systeme, die besonders hilfreiche oder sachliche Kommentare prominenter anzeigen.

Was könnt ihr selbst tun?

Ihr müsst nicht passiv auf die Lösungen der Tech-Konzerne warten. Als Webseitenbetreiber könnt ihr verschiedene Tools einsetzen: Von Googles Perspective API über Communitiy-Moderation bis hin zu simplen Maßnahmen wie Kommentar-Delays oder dem Requirement, sich zu registrieren.

Als Nutzer könnt ihr durch bewusstes Melden, konstruktive Diskussionen und das Ignorieren von Trollen zur Verbesserung der Diskussionskultur beitragen. Die meisten Trolle suchen Aufmerksamkeit – wer sie ignoriert, nimmt ihnen die Motivation.

Die Lösung des Hasskommentar-Problems wird nicht von einer einzelnen Technologie kommen, sondern aus einer Kombination verschiedener Ansätze. Und am Ende braucht es das wichtigste Element: Menschen, die sich für eine bessere Diskussionskultur einsetzen.

Zuletzt aktualisiert am 03.04.2026