Apple legt normalerweise großen Wert auf Datenschutz und Privatsphäre. Doch was 2021 als CSAM-Detection begann, zeigt heute deutlich: Der Weg zur lokalen Gerätedurchsuchung war ein Dammbruch. Mittlerweile durchsuchen Apple-Geräte routinemäßig Inhalte – und andere Tech-Konzerne sind dem Beispiel gefolgt.

Was vor fünf Jahren als gut gemeinte Initiative begann, hat sich zu einem grundlegenden Wandel in der Tech-Branche entwickelt. Apple hatte 2021 angekündigt, auf iPhones, iPads und Macs aktiv nach CSAM-Material zu suchen (Child Sexual Abuse Material). Damals noch beschränkt auf die USA und mit großem Tamtam um Datenschutz – heute ist die lokale Gerätedurchsuchung Standard geworden.

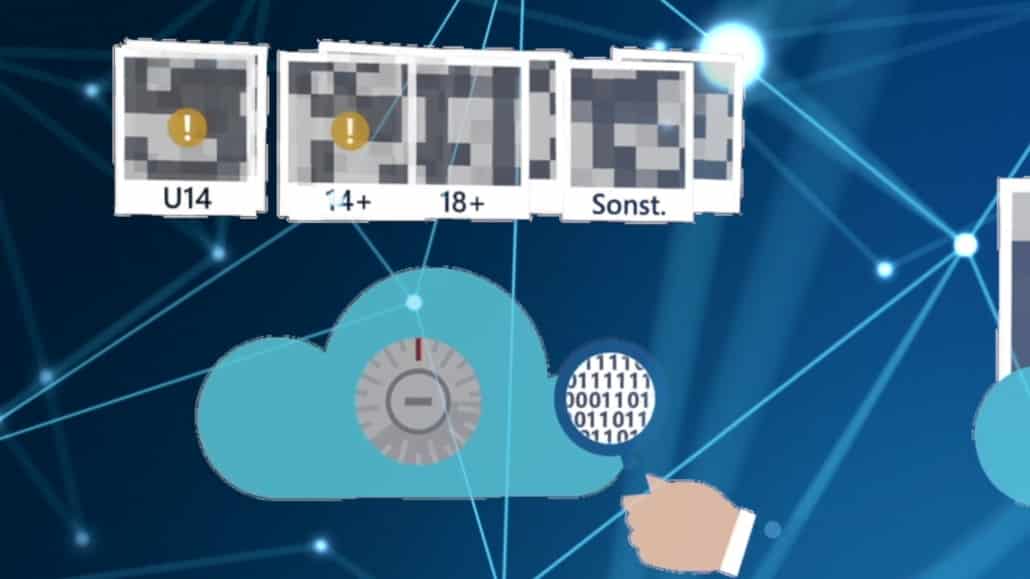

Die ursprünglich von Apple angekündigte Methode schien elegant: Statt alle in der iCloud gespeicherten Fotos zu durchsuchen, sollten die Betriebssysteme direkt auf den Geräten nach bereits bekanntem und in Datenbanken gespeichertem Material suchen. Eine Art präventive Kontrolle vor dem Upload.

Apple verwendet bewährte Mechanismen zum Dateanabgleich

Von CSAM-Detection zur Allzweckwaffe

Was damals als eng begrenztes Tool für einen spezifischen Zweck verkauft wurde, ist heute zu einer universellen Überwachungsinfrastruktur geworden. Die EU-Chatkontrolle nutzt ähnliche Technologien, um private Nachrichten zu scannen. China und andere autoritäre Staaten haben die Methoden übernommen und auf politische Inhalte ausgeweitet.

Apples ursprüngliche Implementierung funktionierte so: Wurden bei der lokalen Prüfung auffällige Fotos entdeckt, erzeugte das Betriebssystem ein Zertifikat. Erst nach dem Upload in die iCloud schauten sich Mitarbeiter das Material an – sofern mehrere solche Aufnahmen entdeckt wurden. Die genaue Schwelle hielt Apple geheim.

Technisch mag das elegant gewirkt haben, aber der Dammbruch war damit vollzogen. Denn einmal etabliert, ließen sich diese Systeme problemlos für andere Zwecke missbrauchen. Genau das ist passiert.

Es weren „nur“ bereits bekannte Bilder entdeckt

Die vorhergesagten Risiken sind eingetreten

2021 warnten Experten vor drei Hauptgefahren: Hacker-Angriffe, Regierungseingriffe und Geheimdienst-Missbrauch. Alle drei sind inzwischen Realität geworden.

Hacker-Angriffe: 2024 gelang es einer Gruppe von Sicherheitsforschern, das System zu täuschen, indem sie harmlose Bilder so manipulierten, dass sie fälschlich als problematisch erkannt wurden. Kriminelle nutzen ähnliche Methoden für Erpressung und Rufschädigung.

Regierungseingriffe: Verschiedene Länder haben Apple und andere Anbieter erfolgreich dazu gedrängt, ihre Scan-Technologie für andere Zwecke einzusetzen. In einigen Staaten werden mittlerweile auch politische Symbole, regierungskritische Memes oder religiöse Inhalte automatisch erkannt und gemeldet.

Geheimdienst-Überwachung: Dokumente aus verschiedenen Leaks belegen, dass westliche Geheimdienste Zugang zu den Scan-Ergebnissen haben. Die ursprünglich nur für Kinderschutz gedachte Infrastruktur dient längst der allgemeinen Überwachung.

Der Dominoeffekt bei anderen Tech-Riesen

Google, Microsoft und Meta haben nachgezogen und eigene Client-Side-Scanning-Systeme entwickelt. Was bei Apple als Ausnahme für einen guten Zweck begann, ist zum Branchenstandard geworden. Heute scannen praktisch alle großen Plattformen Inhalte bereits auf den Endgeräten – nicht erst in der Cloud.

Microsoft geht noch weiter und hat die Technologie in Windows 11 Pro standardmäßig aktiviert. Nutzer können sie zwar deaktivieren, aber die wenigsten wissen davon. Google scannt in Android nicht nur Fotos, sondern auch Textnachrichten in Echtzeit.

KI verschärft das Problem dramatisch

Durch den KI-Boom haben sich die Möglichkeiten vervielfacht. Moderne Systeme erkennen nicht nur bekannte Bilder anhand von Hash-Werten, sondern analysieren Inhalte semantisch. Sie verstehen Kontext, erkennen Gesichter, lesen Text in Bildern und bewerten sogar emotionale Zustände.

Apples Neural Engine und ähnliche KI-Chips in anderen Geräten machen diese Analysen in Echtzeit möglich, ohne dass Daten das Gerät verlassen müssen. Das klingt nach Datenschutz, ist aber das Gegenteil: eine allumfassende lokale Überwachung.

[av_video src=’https://vimeo.com/572075361′ mobile_image=“ attachment=“ attachment_size=“ format=’16-9′ width=’16‘ height=’9′ conditional_play=“ av_uid=’av-82tirt6′]

Microsoft beteiligt sich schon lange an der internationalen Initiative

Was können Nutzer tun?

Die Optionen sind begrenzt, aber nicht inexistent. Alternative Betriebssysteme wie GrapheneOS oder LineageOS verzichten auf solche Scanning-Funktionen. Bei Apple und Google lassen sich zumindest einige Features deaktivieren – meist versteckt in den Datenschutz-Einstellungen.

End-zu-Ende-Verschlüsselung hilft nur bedingt, da das Scanning vor der Verschlüsselung stattfindet. Signal und ähnliche Messenger wehren sich noch gegen Client-Side-Scanning, aber der politische Druck wächst.

Der Kinderschutz war nur der Türöffner. Heute zeigt sich: Es war nie eine gute Idee, diese Büchse der Pandora zu öffnen. Apple und die anderen Tech-Riesen haben ein Problem lösen wollen und Dutzende neue geschaffen. Die lokale Gerätedurchsuchung ist zur neuen Normalität geworden – mit weitreichenden Folgen für unsere Privatsphäre.

Zuletzt aktualisiert am 24.02.2026