Der Begriff „Filterblase“ hat sich fest eingeprägt – und steht für die Vermutung, dass wir in einem Sozialen Netzwerk nur noch Artikel, Posts, Videos und Meinungen zu sehen bekommen, die uns in unserem Weltbild bestätigen. Alles andere bleibe ausgeblendet. So funktionieren die Algorithmen der Netzwerke nun mal… Aber aktuelle Forschungen zeigen: Die Realität ist komplexer als gedacht.

Der Netzaktivist Eli Pariser hat im Jahr 2011 ein Buch geschrieben und darin den Begriff „Filterblase“ eingeführt. Das Argument: Weil uns die (intransparenten) Algorithmen von Google, Meta und Co. ganz bestimmte Informationen präsentieren und andere vorenthalten, leben wir in einer Art Filterblase. Manche sagen auch Echokammer dazu. Meint: Wir hören und lesen nur, was uns bestätigt. Denn die Algorithmen sind so programmiert.

Neue Studien stellen Filterblase-Mythos infrage

Ein für mich völlig schlüssiges Bild. Allerdings sollte man ja auch immer offen für neue Argumente sein. Aktuelle Studien, darunter Forschungsarbeiten von MIT und Stanford aus 2024/2025, kommen zu einem anderen Ergebnis. Einige Wissenschaftler sind der Ansicht, dass es nicht die Algorithmen sind – jedenfalls nicht sie alleine -, die dazu führen, dass wir so häufig bestätigende Aspekte, Artikel und Argumente lesen, sondern wir selbst.

Eine wegweisende Studie der Universität Princeton analysierte 2024 das Nutzerverhalten von über 50.000 Menschen auf verschiedenen Plattformen. Das überraschende Ergebnis: Selbst wenn Algorithmen bewusst diverse Inhalte anzeigten, klickten Nutzer primär auf Artikel, die ihre bestehenden Ansichten stützten. Die menschliche Psychologie, nicht die Technik, erwies sich als treibende Kraft.

Einige Forscher kommen zum Schluss: Wir waren noch nie besser informiert, hatten noch nie so viel Auswahl. Einiges stimmt ja auch: Eine Suchmaschine präsentiert Links zu vielen Angeboten. Da sind garantiert auch immer Quellen darunter, die wir bis dato noch gar nicht gekannt haben. Suchmaschinen sind also ein Segen. Wenn wir das Geschenk annehmen und uns eben auch mal mit anderen Argumenten aus unbekannten Quellen auseinandersetzen.

Neue Tools fördern Meinungsvielfalt aktiv

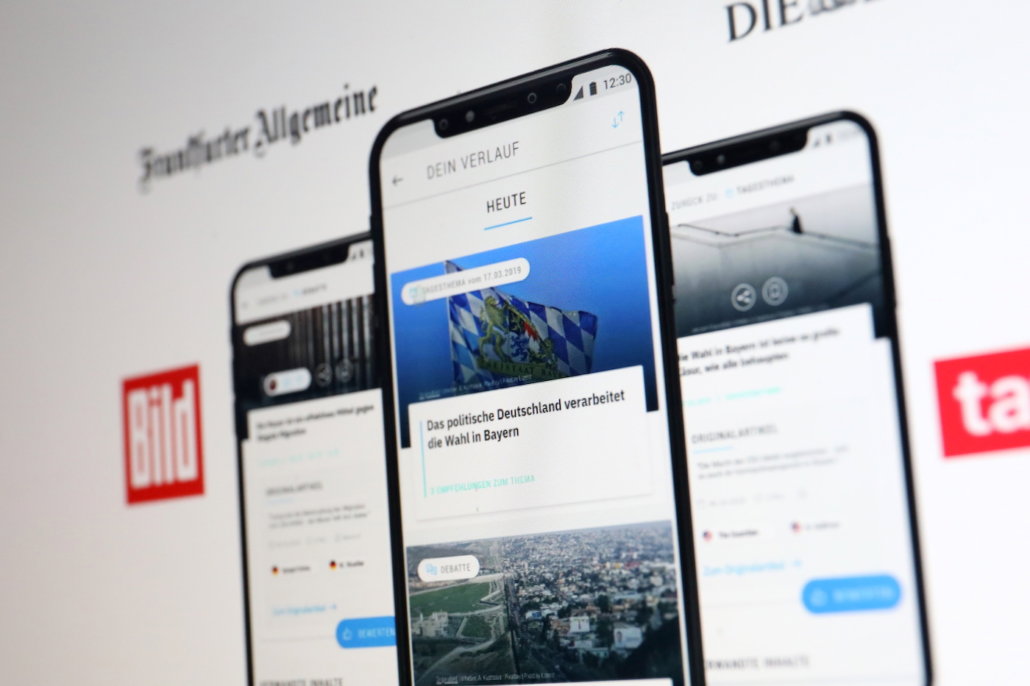

Projekte wie Buzzard haben seit 2020 gezeigt, dass gezieltes Kuratieren unterschiedlicher Perspektiven funktioniert. Die inzwischen etablierte Plattform stellt bewusst und gezielt unterschiedlichste Argumente aus unterschiedlichsten Quellen gegenüber. Dann können sich Leser mit konkreten Argumenten und Gegenargumenten, Sichtweisen und Gegensichtweisen auseinandersetzen.

Neue Player sind hinzugekommen: „AllSides“ kategorisiert Nachrichtenquellen nach politischer Ausrichtung, „Ground News“ zeigt, wie unterschiedlich Medien über dasselbe Ereignis berichten. Auch KI-Tools wie „Perspective“ helfen dabei, blinde Flecken in der eigenen Informationsblase zu identifizieren.

KI als Lösung oder Verstärkung des Problems?

Interessant wird es mit den neuen KI-Systemen: ChatGPT, Claude und Gemini können theoretisch multiple Perspektiven zu jedem Thema liefern. Aber auch hier zeigt sich: Nutzer formulieren ihre Fragen oft so, dass sie die gewünschte Antwort erhalten. „Erkläre mir, warum Elektroautos schlecht sind“ liefert andere Ergebnisse als eine neutrale Anfrage.

Manche KI-Unternehmen reagieren bereits: OpenAI testete 2025 eine „Devil’s Advocate“-Funktion, die automatisch Gegenargumente zu jeder Antwort liefert. Meta experimentiert mit „Perspective Bubbles“ – einer Funktion, die Instagram-Posts mit alternativen Sichtweisen anreichert.

Was können wir konkret tun?

Die Lösung liegt nicht nur in besserer Technologie, sondern auch in unserem Verhalten. Medienkompetenzerziehung wird wichtiger denn je. Schon Jugendliche sollten lernen, bewusst nach abweichenden Meinungen zu suchen und Quellen zu hinterfragen.

Praktische Tipps für den Alltag: Nutzt verschiedene Suchmaschinen (Google, DuckDuckGo, Bing), lest bewusst Medien unterschiedlicher Ausrichtung, folgt auf Social Media auch Personen mit anderen Ansichten – aber nicht den Extremisten, sondern den nachdenklichen Vertretern anderer Positionen.

Natürlich: Ein Klimaaktivist will nicht lesen, dass oder warum jemand den nach fast einhelliger Forschermeinung menschengemachten Klimawandel anzweifelt. Umgekehrt ignoriert der Klimawandelleugner gerne die Erkenntnisse der Wissenschaft. Aber vielleicht kann es auf diese Weise dennoch gelingen, andere Argumente zu verstehen und über Details nachzudenken.

Die Filterblase ist real – aber sie entsteht nicht nur durch Algorithmen, sondern auch durch unsere eigenen Entscheidungen. Das ist eine ernüchternde, aber auch ermutigende Erkenntnis. Denn es bedeutet: Wir haben mehr Kontrolle, als wir dachten.

Zuletzt aktualisiert am 02.03.2026