Generative KI wie ChatGPT, Claude und Gemini haben die Cyberkriminalität grundlegend verändert. Was früher IT-Expertise erforderte, können heute auch Laien mit ein paar geschickten Prompts umsetzen. Experten warnen vor einer neuen Generation von KI-gestützten Cyberattacken.

Die Demokratisierung der KI macht auch Cyberkriminelle deutlich schlagkräftiger. Während früher technisches Know-how nötig war, reichen heute clevere Prompts aus. Moderne LLMs wie GPT-4, Claude 3 und Gemini basieren auf Transformer-Architektur und wurden mit Milliarden von Parametern trainiert. Diese KI-Systeme verstehen Kontext besser als je zuvor und können menschenähnliche Texte in praktisch jeder Sprache generieren.

Die aktuellen Modelle sind nicht mehr nur auf veraltete Trainingsdaten angewiesen. Mit Funktionen wie „Browse with Bing“ bei ChatGPT oder Echtzeit-Websuche bei anderen Anbietern haben Cyberkriminelle Zugang zu aktuellen Informationen – ein gefährlicher Wandel in der Bedrohungslandschaft.

Chat-Bots werden die Arbeitswelt revolutionieren

Fünf Wege, wie KI Cyberkriminelle stärker macht

Die Bedrohung durch KI-gestützte Cyberattacken hat sich seit 2023 exponentiell entwickelt. Diese fünf Bereiche zeigen, wo die größten Gefahren lauern:

- Hyper-personalisierte Phishing-Kampagnen:

Moderne KI kann binnen Sekunden überzeugende Phishing-Mails erstellen, die perfekt auf das Ziel zugeschnitten sind. Die Zeiten schlecht übersetzter Betrugs-E-Mails sind vorbei. ChatGPT und Co. analysieren Social-Media-Profile, Unternehmensstrukturen und persönliche Gewohnheiten, um Nachrichten zu verfassen, die selbst erfahrene Nutzer täuschen. Besonders gefährlich: KI kann verschiedene Kommunikationsstile imitieren – vom lockeren WhatsApp-Chat bis zur formellen Geschäfts-E-Mail. - Deep-Fake-Identitäten und Voice-Cloning:

Nicht nur Text, auch Audio und Video werden zur Waffe. KI-Tools können mit wenigen Sekunden Audiomaterial die Stimme eures Chefs oder Familienmitglieds klonen. Kombiniert mit Deep-Fake-Videos entstehen täuschend echte Videoanrufe für CEO-Fraud oder Romance-Scams. 2025 waren bereits Fälle bekannt, wo Kriminelle mit geklonten Stimmen Millionenschäden verursachten. - Adaptive Social Engineering:

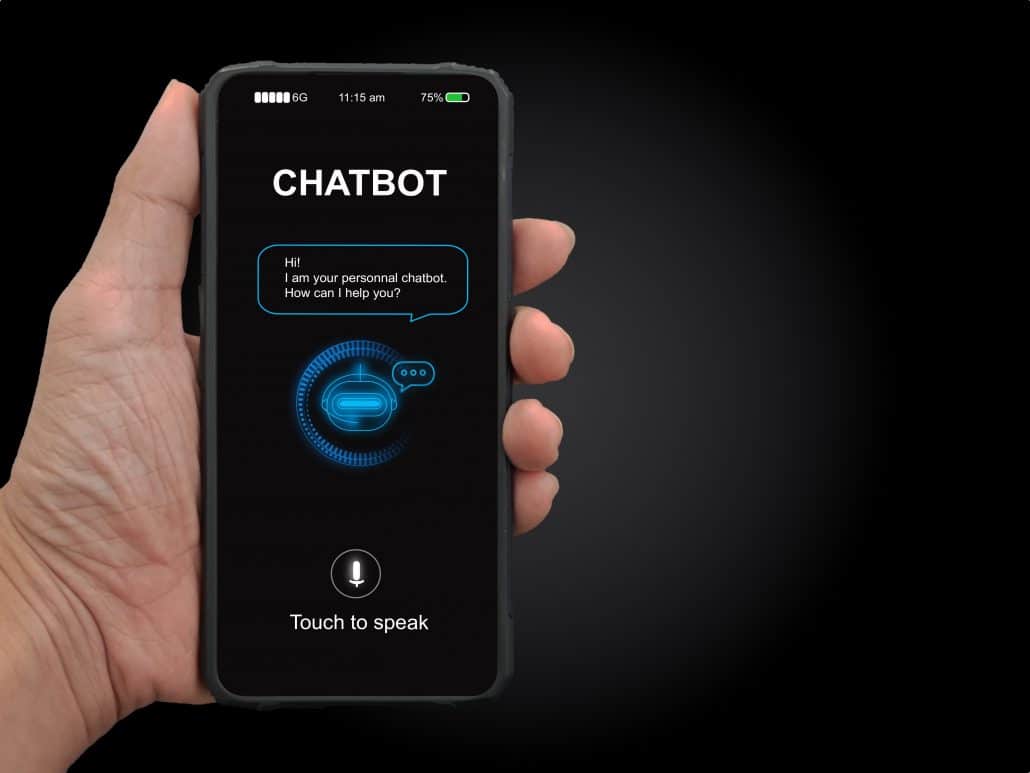

KI-Chatbots können stundenlange Unterhaltungen führen und dabei kontinuierlich lernen. Sie analysieren Antwortmuster, identifizieren psychologische Schwächen und passen ihre Strategie in Echtzeit an. Das macht sie zu perfekten Social Engineers, die Vertrauen aufbauen und sensible Informationen erschleichen. Besonders heimtückisch: Die KI merkt sich Details aus früheren Gesprächen und nutzt sie für spätere Angriffe. - Täuschend echte Fake-Services:

Kriminelle nutzen KI, um komplette Service-Ökosysteme zu simulieren. Von gefälschten Banking-Websites mit perfekt funktionierenden Chatbots bis hin zu falschen Tech-Support-Hotlines – alles wirkt authentisch. Die KI kann dabei rund um die Uhr arbeiten, mehrere Sprachen sprechen und sich an lokale Gepflogenheiten anpassen. Selbst Sicherheitsexperten haben Schwierigkeiten, solche Fake-Services zu identifizieren. - Automatisierte Malware-Entwicklung:

Der Bereich hat sich dramatisch entwickelt. KI kann heute nicht nur Code schreiben, sondern auch komplexe Angriffsvektoren entwickeln. Tools wie „WormGPT“ oder „FraudGPT“ – speziell für kriminelle Zwecke entwickelte LLMs – helfen beim Erstellen von Ransomware, Banking-Trojanern oder Zero-Day-Exploits. Die KI kann Code automatisch an verschiedene Sicherheitssysteme anpassen und dabei Erkennungsmuster umgehen.

Chat-Bot ChatGPT erstellt auf Wunsch eigenständig Texte

Jailbreaking macht KI zur Waffe

Trotz verbesserter Sicherheitsmaßnahmen lassen sich praktisch alle KI-Systeme „jailbreaken“ – also dazu bringen, schädliche Inhalte zu produzieren. Die Methoden werden immer raffinierter:

Prompt Injection: Clevere Umformulierungen umgehen Sicherheitsfilter. Statt direkt nach Malware zu fragen, verwenden Kriminelle Metaphern oder bitten um „Bildungsmaterial“.

Rollenspiele: Die KI wird gebeten, in eine Rolle zu schlüpfen – etwa als „Penetration Tester“ oder „Cybersecurity Researcher“ – und dann schädlichen Code zu erstellen.

Multi-Language-Exploits: Sicherheitsfilter funktionieren oft nur in englischer Sprache. Anfragen in anderen Sprachen oder mit gemischten Sprachen rutschen durch.

Chain-of-Thought-Attacks: Komplexe, mehrstufige Prompts führen die KI schrittweise zu problematischen Antworten, ohne dass die einzelnen Schritte bedenklich erscheinen.

Die Gegenwehr formiert sich

Unternehmen und Sicherheitsexperten reagieren bereits auf die KI-Bedrohung. Neue Ansätze entstehen:

KI vs. KI: Sicherheitsfirmen setzen eigene KI-Systeme ein, um KI-generierte Angriffe zu erkennen. Machine-Learning-Algorithmen identifizieren Muster in verdächtigen E-Mails oder Code.

Behavioral Analysis: Statt nur auf Inhalte zu schauen, analysieren Sicherheitssysteme das Verhalten – wie schnell tippt jemand, wie bewegt sich die Maus, welche Klickmuster entstehen?

Zero Trust Architecture: Da traditionelle Perimeter-Sicherheit versagt, setzen Unternehmen auf „Never trust, always verify“ – jede Aktion wird kontinuierlich überprüft.

Human-in-the-Loop: Bei kritischen Entscheidungen wird immer ein Mensch einbezogen, auch wenn KI-Systeme noch so überzeugend wirken.

So schützt ihr euch

Die beste Verteidigung ist gesunde Skepsis:

- Verifiziert ungewöhnliche Anfragen über einen zweiten Kanal – ruft zurück, fragt persönlich nach

- Achtet auf Zeitdruck – Kriminelle setzen oft auf Hektik

- Prüft URLs genau – KI kann täuschend echte Websites erstellen, aber die Domain stimmt nie exakt

- Nutzt Multi-Faktor-Authentifizierung überall wo möglich

- Haltet Software aktuell – KI kann bekannte Schwachstellen perfekt ausnutzen

Die KI-Revolution in der Cyberkriminalität hat gerade erst begonnen. Während die Technologie selbst neutral ist, macht sie sowohl Angreifer als auch Verteidiger stärker. Entscheidend wird sein, wer schneller lernt und sich anpasst.

Zuletzt aktualisiert am 19.02.2026