WhatsApp wird Social Network: Das ändert sich für euch

Benutzernamen, Musik im Status, KI-Tools: WhatsApp wird zur Social-Media-Plattform. Was das für eure Privatsphäre bedeutet.

Benutzernamen, Musik im Status, KI-Tools: WhatsApp wird zur Social-Media-Plattform. Was das für eure Privatsphäre bedeutet.

Meta hat angekündigt, seine KI-gestützte Altersprüfung massiv auszubauen. Das Ziel: Kinder unter 13 Jahren konsequenter von Instagram und Facebook entfernen, und Jugendliche zwischen 13 und 17 zuverlässiger in die geschützten Teen Accounts zu verschieben

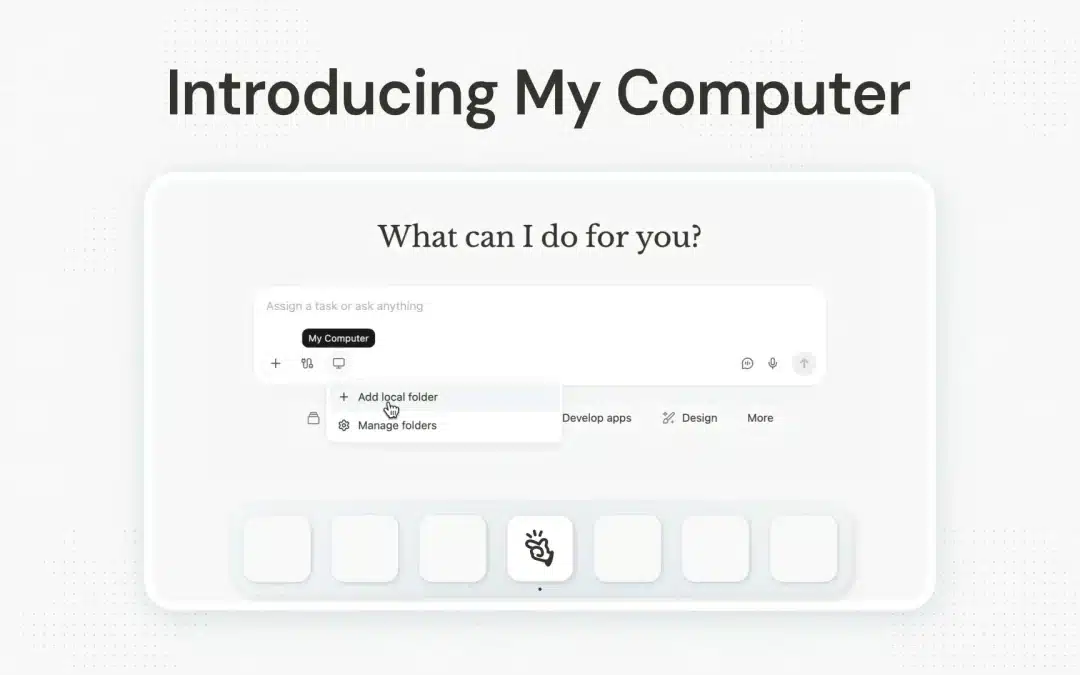

KI-Chatbots kennt mittlerweile fast jeder. Du tippst eine Frage ein, bekommst eine Antwort – fertig. Doch seit Anfang 2026 passiert etwas Neues: KI-Agenten verlassen die Chatfenster und ziehen direkt auf unsere Computer. Allen voran Manus mit seinem neuen Feature „My Computer“. Was steckt dahinter, was kann das – und was sollte man wissen, bevor man einem KI-Agenten die Tür zum eigenen Rechner öffnet?

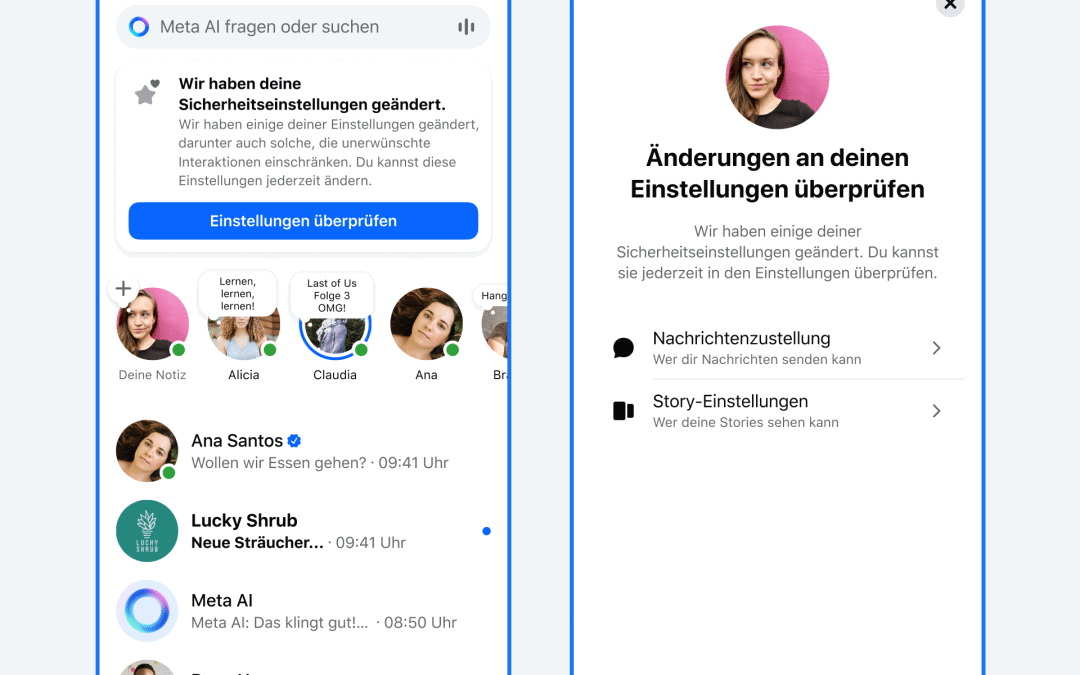

Meta dreht wieder an den Stellschrauben und plant große Änderungen für Facebook, Instagram und WhatsApp. KI-Integration, Shopping-Features und Creator-Tools stehen im Fokus.

Meta startet Muse Spark KI-Modell für Facebook, Instagram und WhatsApp. Neue Features für bessere Social Media-Erfahrung – was das für euch bedeutet.

US-Gericht verurteilt Meta und Google wegen Sucht-Design: Instagram und YouTube machen absichtlich süchtig. Was das Urteil für alle Social-Media-Nutzer bedeutet.

US-Jury verurteilt Google und Meta wegen süchtig machender Algorithmen. Was das historische Urteil für deutsche Nutzer bedeutet.

Meta testet Werbeanzeigen direkt in WhatsApp-Chats. Was das für eure Privatsphäre bedeutet und wie ihr euch schützen könnt.