Nicht ChatGPT war der erste Chatbot, der die Menschen fasziniert hat, sondern ein Programm namens Eliza: Ein extrem simpel gestricktes Programm, weit davon entfernt, moderne KI zu sein. Entwickelt von einem in die USA emigrierten deutschen Professor – und Wegbereiter für heutige KI-Giganten wie GPT-4, Claude und Gemini.

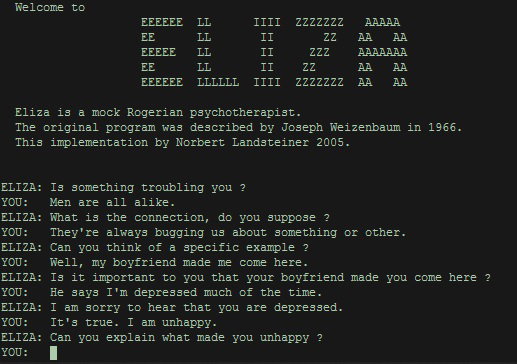

Wenn wir an Chatbots denken, kommen uns heute wahrscheinlich ChatGPT, Claude oder Copilot in den Sinn. Doch der erste Chatbot seiner Art namens Eliza wurde bereits 1966 programmiert – fast 60 Jahre vor dem KI-Boom von 2024.

Prof. Joseph Weizenbaum, ein Computerwissenschaftler mit deutschen Wurzeln, hat Eliza damals als Experiment am MIT entwickelt. Weizenbaum wollte demonstrieren, wie leicht Menschen dazu neigen, mit einem Computer zu interagieren, der sich wie ein menschlicher Psychotherapeut verhält – und wie schnell sie ihm menschliche Eigenschaften zuschreiben.

Diese bahnbrechende Arbeit hat nicht nur die Entwicklung der künstlichen Intelligenz vorangetrieben, sondern wirft auch heute noch relevante Fragen über unser Verhältnis zu KI-Systemen auf. Während wir 2026 mit Large Language Models wie GPT-5 oder Gemini Ultra interagieren, bleiben Weizenbaums Erkenntnisse über die menschliche Neigung zur Anthropomorphisierung von Maschinen hochaktuell.

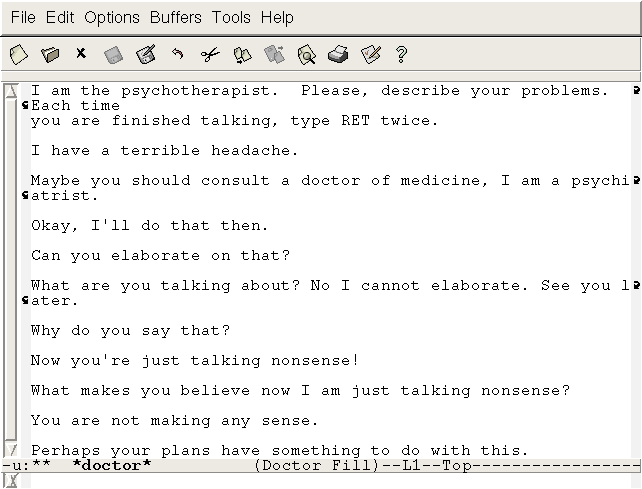

Eliza hat versucht, einen Psychotherapeuten nachzuahmen

Wie ein 60 Jahre altes Experiment die KI-Revolution vorwegnahm

Eliza funktionierte nach einem verblüffend einfachen Prinzip: Pattern Matching. Das Programm erkannte Schlüsselwörter in den Eingaben der Nutzer und antwortete mit vordefinierten Phrasen. Schrieb jemand „Meine Mutter“, antwortete Eliza mit „Erzählen Sie mir mehr über Ihre Familie“. Trotz dieser primitiven Technik waren viele Nutzer überzeugt, mit einem verständnisvollen Therapeuten zu sprechen.

Das Faszinierende: Dieses Phänomen erleben wir heute wieder. Obwohl moderne KI-Systeme wie ChatGPT oder Claude auf neuronalen Netzen und Transformer-Architekturen basieren, neigen Menschen immer noch dazu, diesen Systemen Bewusstsein und Emotionen zuzuschreiben. Weizenbaums Warnung vor der „ELIZA-Illusion“ ist heute relevanter denn je.

2025 haben Studien gezeigt, dass Menschen bei Gesprächen mit fortgeschrittenen KI-Systemen ähnliche emotionale Bindungen entwickeln wie damals bei Eliza – nur verstärkt durch die deutlich überzeugendere Sprachfähigkeit moderner Large Language Models.

Von Mustererkennung zu neuronalen Netzen: Der technologische Sprung

Während Eliza auf starren Regeln basierte, arbeiten heutige KI-Chatbots mit Deep Learning und Transformer-Modellen. GPT-4 Turbo, Claude 3.5 Sonnet oder Googles Gemini 1.5 Pro verstehen Kontext über hunderte von Seiten hinweg und können in über 100 Sprachen kommunizieren.

Doch die Grundidee bleibt dieselbe: Computer sollen natürliche Sprache verstehen und menschenähnlich antworten. Was Weizenbaum 1966 mit wenigen hundert Zeilen Code begann, erfordert heute Milliarden von Parametern und Rechenleistung im Petaflop-Bereich.

Interessant ist auch: Elizas therapeutischer Ansatz lebt in modernen KI-Anwendungen weiter. Therapeutische Chatbots wie Woebot oder Wysa verwenden heute fortgeschrittene KI, um psychische Gesundheit zu unterstützen – genau das, was Weizenbaum ursprünglich simulieren wollte, nur diesmal mit echter Intelligenz dahinter.

Man kann Nachahmungen von Eliza noch immer im Netz finden

Weizenbaums Warnung: Warum sie heute wichtiger ist denn je

Joseph Weizenbaum war entsetzt über die Reaktionen auf Eliza. Menschen vertrauten dem simplen Programm intime Details an und glaubten an dessen Verständnis. Diese Erfahrung machte ihn zu einem der schärfsten Kritiker der KI-Entwicklung.

Seine Warnungen aus den 1970ern klingen heute prophetisch: Er befürchtete, dass Menschen wichtige Entscheidungen an Computer delegieren würden, ohne deren Grenzen zu verstehen. 2026 sehen wir genau das: KI-Systeme treffen Entscheidungen in der Medizin, im Rechtswesen und in der Bildung.

Weizenbaum warnte auch vor der Gefahr, dass KI menschliche Beziehungen ersetzen könnte. Mit Companion-KIs wie Replika oder Character.AI, die 2025/2026 Millionen von Nutzern emotionale Unterstützung bieten, wird diese Sorge zur Realität.

Von Siri zu multimodalen KI-Assistenten

Apples Siri, 2011 eingeführt, war lange der bekannteste KI-Assistent. Doch 2026 hat sich das Feld drastisch erweitert. Während Siri immer noch auf iPhones läuft, dominieren heute multimodale KI-Systeme wie GPT-4 Vision, Claude 3 mit Bildverarbeitung oder Googles Gemini Ultra mit Video-Verständnis.

Diese neuen Assistenten können nicht nur sprechen und hören, sondern auch sehen, Videos analysieren und sogar Code generieren. Sie sind zu echten digitalen Mitarbeitern geworden, die komplexe Aufgaben in Büros, Schulen und Forschungseinrichtungen übernehmen.

Mark Zuckerberg setzt auf KI-Chatbots, die sich als Promis ausgeben

Die KI-Landschaft 2026: Elizas Erbe überall

Tatsächlich ist Elizas Einfluss heute überall spürbar. Customer Service Bots auf Webseiten, Sprachassistenten in Autos, therapeutische Apps, Lern-Tutoren – sie alle folgen Weizenbaums ursprünglicher Vision einer Mensch-Computer-Konversation.

2026 nutzen über 4 Milliarden Menschen täglich KI-Chatbots. OpenAIs ChatGPT hat über 200 Millionen wöchentliche Nutzer, Anthropics Claude wird in Unternehmen weltweit eingesetzt, und Googles Gemini ist in alle Android-Geräte integriert.

Doch mit dieser Verbreitung kommen auch Weizenbaums Befürchtungen zum Tragen: Deepfakes in politischen Kampagnen, KI-generierte Desinformation und die wachsende Schwierigkeit, zwischen menschlichen und maschinellen Inhalten zu unterscheiden.

Ausblick: Was Weizenbaum heute sagen würde

Weizenbaum starb 2008, bevor er den aktuellen KI-Boom erleben konnte. Seine Schriften legen nahe, dass er sowohl fasziniert als auch besorgt gewesen wäre. Die technischen Fortschritte hätten ihn beeindruckt, die gesellschaftlichen Auswirkungen wahrscheinlich erschreckt.

Chat-Bots werden die Arbeitswelt revolutionieren

60 Jahre nach Eliza stehen wir vor ähnlichen Fragen wie Weizenbaum damals: Wie weit sollen wir Maschinen vertrauen? Wann wird aus nützlicher Unterstützung gefährliche Abhängigkeit? Sein Experiment bleibt ein Mahnmal dafür, dass technischer Fortschritt immer mit ethischer Reflexion einhergehen muss.

Eliza mag primitiv gewesen sein, aber sie lehrte uns etwas Fundamentales über uns selbst: Unsere Bereitschaft, in Maschinen menschliche Eigenschaften zu sehen. Diese Lektion ist heute wichtiger denn je, während KI immer menschenähnlicher wird und gleichzeitig unsere Welt grundlegend verändert.

Zuletzt aktualisiert am 17.02.2026