Content-Moderation bei sozialen Medien ist ein ständiger Balanceakt zwischen freier Meinungsäußerung und Nutzer-Sicherheit. Immer wieder zeigen Vorfälle, wie schnell sich problematische Inhalte verbreiten können – besonders über GIFs, Memes und andere virale Formate.

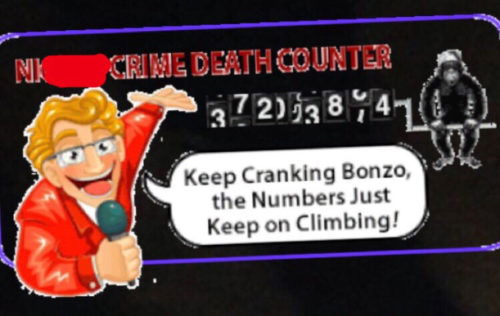

Bereits 2018 mussten Instagram und Snapchat ihre GIF-Integration vorübergehend deaktivieren, nachdem rassistische Inhalte über Giphy in die Apps gelangten. Dieser Vorfall zeigt exemplarisch die Herausforderungen der Content-Moderation, die heute relevanter sind denn je.

GIF-Bilder haben in den letzten Jahren massiv an Beliebtheit gewonnen. Fast jede Plattform bietet mittlerweile Funktionen, um animierte GIFs in Posts, Stories oder Nachrichten einzufügen. TikTok, Instagram, WhatsApp, Twitter/X – überall sind die bewegten Bildchen zum Standard geworden.

Wie funktioniert die GIF-Integration?

Die meisten Social-Media-Plattformen erstellen ihre GIFs nicht selbst, sondern greifen auf externe Datenbanken zurück. Giphy ist dabei nach wie vor der größte Anbieter und liefert GIFs für unzählige Apps und Websites. 2020 kaufte Meta (damals Facebook) Giphy für 400 Millionen Dollar, musste das Unternehmen aber 2022 auf Druck der britischen Kartellbehörde wieder verkaufen – an Shutterstock für 53 Millionen Dollar.

Jeder kann theoretisch eigene GIFs bei Giphy hochladen und sie dadurch in verschiedenen Apps verfügbar machen. Diese offene Struktur macht die Plattform einerseits vielfältig und kreativ, andererseits schwer kontrollierbar.

Content-Moderation wird immer wichtiger

Der damalige Vorfall mit rassistischen Inhalten führte zu verstärkten Kontrollen bei Giphy. Das Unternehmen entwickelte seitdem verschiedene Moderations-Tools:

- KI-basierte Vorfilterung: Algorithmen scannen hochgeladene Inhalte automatisch auf problematische Elemente

- Community-Meldungen: Nutzer können unangemessene GIFs direkt melden

- Menschliche Moderatoren: Bei zweifelhaften Fällen entscheiden echte Menschen

- Präventive Sperrlisten: Bekannte problematische Begriffe und Bilder werden automatisch blockiert

Trotzdem bleiben Herausforderungen. Die schiere Menge an täglich hochgeladenen GIFs macht eine lückenlose Kontrolle schwierig. Hinzu kommen kulturelle Unterschiede bei der Bewertung von Inhalten und sich ständig wandelnde Internet-Trends.

Aktuelle Entwicklungen in der GIF-Welt

Seit 2018 hat sich viel getan. Instagram und Snapchat haben ihre GIF-Features längst wieder aktiviert – mit verschärften Moderations-Standards. Neue Plattformen wie TikTok setzen verstärkt auf eigene animierte Sticker und Effekte, um unabhängiger von externen Anbietern zu werden.

Interessant ist auch der Trend zu personalisierten GIFs. Apps wie Bitmoji (gehört zu Snap) oder Facebooks Avatar-System lassen Nutzer eigene animierte Figuren erstellen. Das reduziert die Abhängigkeit von Giphy und gibt Plattformen mehr Kontrolle über die Inhalte.

Parallel entstehen neue Herausforderungen: Deepfake-GIFs, die mit KI erstellt werden, sind schwerer zu erkennen. Auch politische Desinformation verbreitet sich zunehmend über scheinbar harmlose Memes und Animationen.

Was bedeutet das für Nutzer?

Für euch als User bedeuten die verschärften Moderations-Standards meist eine sicherere, aber manchmal auch sterilere Erfahrung. Harmlose GIFs können versehentlich gesperrt werden, während problematische Inhalte durchrutschen.

Tipp: Meldet unangemessene Inhalte direkt über die jeweilige App. Die meisten Plattformen reagieren schnell auf Community-Feedback. Und seid vorsichtig beim Teilen von GIFs in beruflichen Kontexten – was lustig gemeint ist, kann missverstanden werden.

Die GIF-Integration in Social Media wird weiter wachsen, aber unter strengerer Aufsicht. Plattformen investieren Millionen in bessere Moderations-Tools, weil sie wissen: Ein einziger Shitstorm kann mehr kosten als jahrelange Präventionsmaßnahmen.

Zuletzt aktualisiert am 10.03.2026