Die Herkunft eines Menschen – ob Land, Ort oder sogar nur Stadtteil – beeinflusst maßgeblich seine Sicht auf die Welt. In vielen Ländern beschäftigen sich Ethikräte mit unterschiedlichsten Fragestellungen, seien sie rechtlich, naturwissenschaftlich, religiös oder medizinisch.

Gibt es auf einem Themengebiet neue Möglichkeiten, Erfindungen oder Durchbrüche, so ist es die Aufgabe des Ethikrates zu klären, ob und in welcher Form eine Nutzung dieser Dinge ethisch korrekt und überhaupt möglich ist. In der Medizin zum Beispiel ist das bei Studien zwingend vorgeschrieben.

Mit der Entwicklung der KI (künstlichen Intelligenz) ist ein solcher Fall eingetreten. Im Jahre 2004 fand in Sanremo (Italien) das erste internationale Symposion zur Roboterethik statt. Heute, über zwanzig Jahre später, sind diese Fragen brennender denn je. Zu klären sind in diesem Zusammenhang etliche Fragen. Wo genau endet z.B. die programmierte KI und wo beginnt ein Bewusstsein? Sollten Roboter eigene Rechte erhalten? Je nachdem, wie weit die Entwicklung voranschreitet, sollte man hier aus unterschiedlichen Perspektiven herangehen.

Von Science Fiction zur Realität: Aktuelle KI-Dilemmata

Was 2018 noch Science Fiction war, ist heute Realität geworden. Große Sprachmodelle wie ChatGPT, Claude oder Gemini treffen täglich Milliarden von Entscheidungen. Sie bewerten, sortieren, empfehlen – und beeinflussen damit unser Leben. In der Medizin unterstützen KI-Systeme bereits bei Diagnosen, in der Rechtsprechung analysieren sie Fälle, und in sozialen Medien bestimmen Algorithmen, welche Inhalte wir zu sehen bekommen.

Doch auch die Frage, wie weit die rein programmierte Technik gehen darf und wie Entscheidungen zu fällen sind, muss unbedingt geklärt werden. Im Film „I, Robot“ hat es Will Smith mit einem fühlenden Roboter zu tun. Dieser wurde darauf programmiert, die drei Asimov’schen Robotergesetze einzuhalten:

- Ein Roboter darf kein menschliches Wesen (wissentlich) verletzen oder durch Untätigkeit (wissentlich) zulassen, dass einem menschlichen Wesen Schaden zugefügt wird.

- Ein Roboter muss den ihm von einem Menschen gegebenen Befehlen gehorchen – es sei denn, ein solcher Befehl würde mit der ersten Regel kollidieren.

- Ein Roboter muss seine Existenz beschützen, solange dieser Schutz nicht mit der ersten oder zweiten Regel kollidiert.

Diese Gesetze wurden vom Schriftsteller Isaac Asimov in seiner Kurzgeschichte Runaround zum ersten Mal erwähnt und sind heute relevanter denn je.

Im Film ist nun angeblich ein Wissenschaftler in den Freitod gesprungen, einziger Zeuge: Sonny, ein Roboter mit künstlicher Intelligenz. Anders als die anderen Roboter verfügt Sonny über einen freien Willen und wird nicht vom Hauptcomputer V.I.K.I. gesteuert. V.I.K.I. hat die Menschen analysiert und für sich entschieden, dass die Menschen und ihre Handlungsweisen den Mitmenschen und der Erde schaden.

Autonome Systeme: Das Tesla-Dilemma und mehr

Sie beschließt daher, die Roboter zu nutzen, um die Menschen zu lenken. Am Ende stellt sich heraus: Der Wissenschaftler hatte Sonny gebeten, ihn durch ein Fenster zu stoßen, um so die Polizei zu verständigen. Er kannte Detective Spooner (von Will Smith gespielt), den ermittelnden Polizisten, und sein Misstrauen Computern gegenüber.

Was hier tatsächlich reine Science Fiction war, ist heute bereits Realität. Tesla’s Full Self-Driving, Waymo’s autonome Taxis und andere selbstfahrende Systeme stehen täglich vor ethischen Entscheidungen. 2026 fahren bereits Millionen von Fahrzeugen mit fortschrittlichen Assistenzsystemen auf den Straßen.

Die Moral Machine: Wenn Algorithmen über Leben entscheiden

Und hier stellt sich eine ethische Grundfrage: Was passiert, wenn ein solches Fahrzeug im Notfall selbst entscheiden muss? Sollten in jedem Fall die Insassen geschützt werden? Oder lieber Außenstehende? Das MIT (Massachusetts Institute of Technology) hat mit seiner „Moral Machine“ über 40 Millionen Entscheidungen von Menschen aus 233 Ländern gesammelt. Die Ergebnisse zeigen: Kulturelle Unterschiede sind enorm.

Während in westlichen Kulturen oft utilitaristische Ansätze bevorzugt werden (möglichst viele Leben retten), legen andere Kulturen mehr Wert auf den Schutz bestimmter Gruppen wie Kinder oder Autoritätspersonen. In Deutschland ist die Rechtslage eindeutig: Leben dürfen nicht gegeneinander aufgewogen werden.

Mysticsartdesign / Pixabay

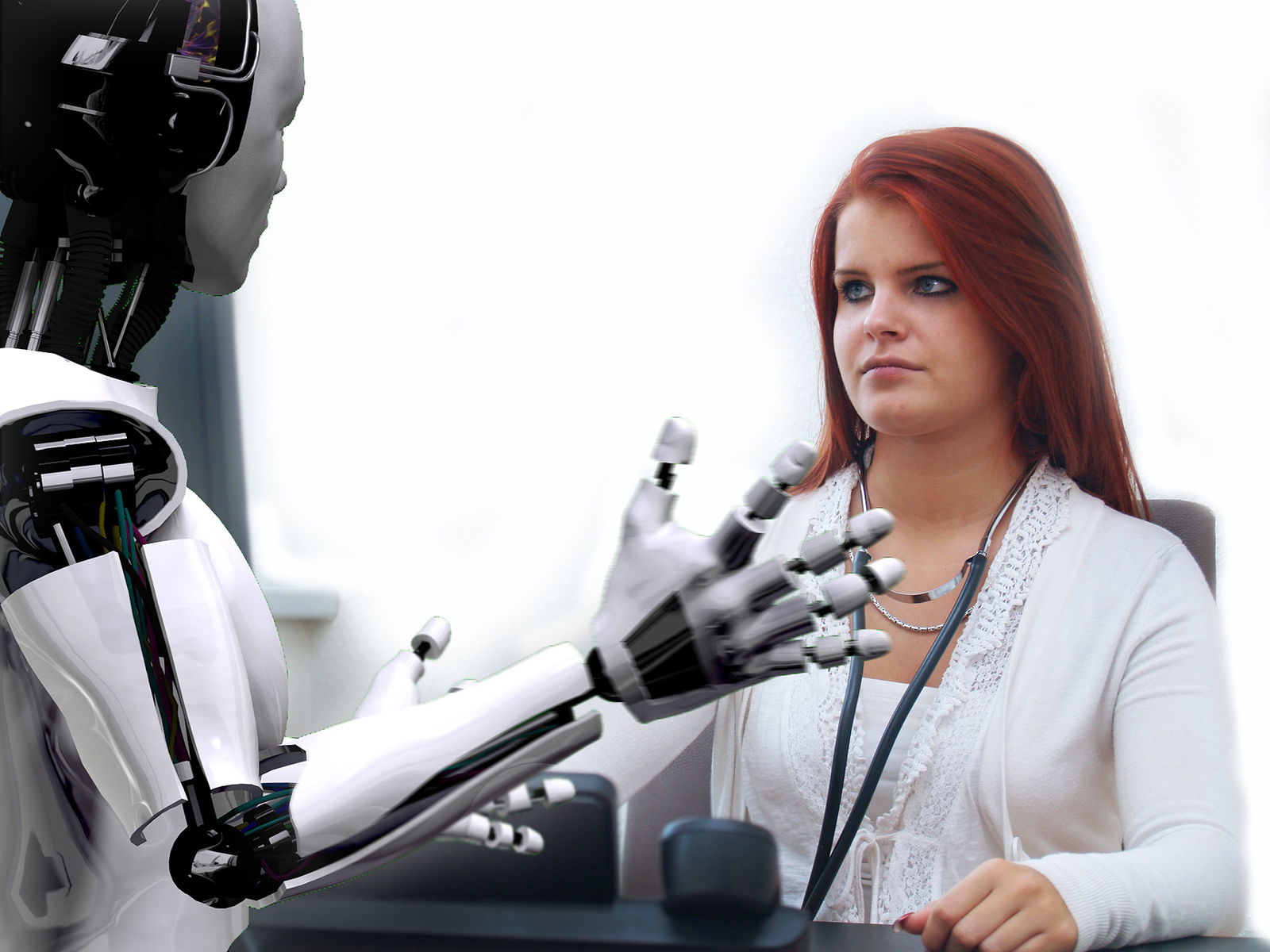

KI in der Medizin: Algorithmic Bias und Fairness

Ein besonders brisantes Feld ist die Medizin. KI-Systeme analysieren Röntgenbilder, empfehlen Therapien und prognostizieren Krankheitsverläufe. Doch was passiert, wenn diese Systeme „Bias“ haben – also bestimmte Gruppen benachteiligen? Studien zeigen: Viele medizinische KI-Systeme funktionieren bei weißen Männern besser als bei Frauen oder People of Color, weil sie hauptsächlich mit Daten dieser Gruppe trainiert wurden.

Die Zukunft der Roboterethik: Regulierung und Standards

Die EU hat 2024 mit dem AI Act einen ersten Rahmen geschaffen, doch viele Fragen bleiben offen. Wie kontrollieren wir KI-Systeme, die sich selbst weiterentwickeln? Was passiert, wenn eine KI Entscheidungen trifft, die niemand mehr nachvollziehen kann? Diese „Black Box“-Problematik beschäftigt Ethiker weltweit.

Menschen würden sicherlich häufig die falsche Entscheidung treffen, wenn es wirklich darauf ankommt. Teilweise sicherlich auch, weil die Chancen und Wahrscheinlichkeiten falsch eingeschätzt würden. Ist hier also ein Computer möglicherweise der menschlichen Ethik und Moral überlegen? Sollte die Vorgehensweise rein rechnerisch festgelegt werden?

Während im englischen Sprachraum die Ansicht vorherrscht, dass immer die Lösung bevorzugt werden sollte, die mehr Leben rettet, ist es in Deutschland beispielsweise verboten, Leben gegeneinander aufzuwiegen. Jedes Leben ist gleich viel wert. So dürfte ein Flugzeug, das in ein Hochhaus fliegt, nicht abgeschossen werden, um damit viele Leben zu retten, denn die wenigen Leben in der Maschine wären genauso viel wert.

Wo also sollten Computer eingreifen dürfen und wo nicht? Sicherlich muss irgendwann eine Entscheidung getroffen werden, die Frage ist nur, ob diese Entscheidung einzig bei den Tech-Konzernen und ihren Programmierern liegen sollte oder ob nicht die Gesellschaft als solche diese schwere Entscheidung zu treffen hat. Die Zeit drängt – denn KI-Systeme treffen bereits heute folgenreiche Entscheidungen, oft ohne dass wir es merken.

Zuletzt aktualisiert am 07.03.2026