Soziale Plattformen aktivieren bei Krisen automatisch spezielle Modi: Facebook bietet einen „Safety Check“, bei dem Menschen Angehörigen mitteilen können, dass sie sicher sind. Doch diese gut gemeinte Funktion wird oft zum Problem. Bei Attentaten und Terroranschlägen landen in Krisenforen regelmäßig verstörende Aufnahmen und Falschinformationen. Höchste Zeit für klare Regeln im Umgang mit Krisensituationen.

Wenn irgendwo auf der Welt Schüsse fallen, Bomben explodieren oder Naturkatastrophen wüten, dauert es nur wenige Minuten, bis die ersten Meldungen auf X (ehemals Twitter), Instagram, TikTok und Meta-Plattformen auftauchen. Hashtags wie #Terror, #Attentat oder #Krise verbreiten sich viral. Die Algorithmen der Plattformen sind darauf programmiert, solche Ereignisse automatisch zu erkennen und entsprechende Krisenmodi zu aktivieren.

Meta’s Krisenmodus wird zum Einfallstor für Gewaltvideos

Bei Meta (Facebook, Instagram) ist es der „Safety Check“, der ursprünglich einen wichtigen Zweck erfüllen sollte: Menschen in Krisenregionen können Freunden und Familie schnell mitteilen, dass sie in Sicherheit sind. Parallel dazu richtet die Plattform automatisch Krisenforen ein, in denen sich Betroffene informieren und Hilfe organisieren können.

Doch die Realität sieht anders aus. Diese Krisenbereiche werden regelmäßig mit extremem Content geflutet: Gewaltvideos, verstörende Bilder von Opfern und Tätern, oft ohne jede Moderation. Besonders problematisch: Die Videos starten häufig automatisch, ohne dass Nutzer sie bewusst anklicken müssen. Was als Hilfstool gedacht war, wird zur Verbreitungsplattform für traumatisierende Inhalte.

TikTok und X verschärfen das Problem

TikToks Algorithmus verstärkt das Problem zusätzlich. Schockierende Inhalte generieren hohe Engagement-Raten und werden daher bevorzugt ausgespielt. Auch wenn die Plattform mittlerweile „Sensitive Content Warnings“ eingeführt hat, gelangen verstörende Aufnahmen regelmäßig ungefiltert in die For You Pages.

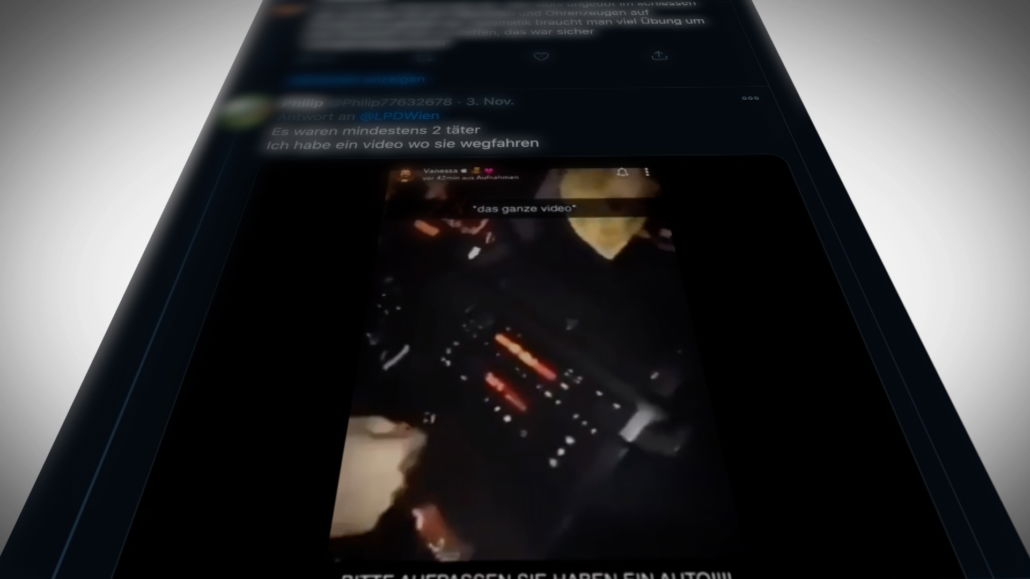

Bei X (Twitter) sorgt die Abschaffung vieler Moderationsrichtlinien unter Elon Musk für zusätzliche Probleme. Krisensituationen werden oft von koordinierten Desinformationskampagnen begleitet. Bots verbreiten gezielt Falschinformationen über Täteranzahl, Motivlagen oder erfundene Geiselnahmen.

Künstliche Intelligenz als Teil des Problems

Paradoxerweise verstärken KI-gesteuerte Empfehlungsalgorithmen das Chaos. Sie erkennen zwar Krisensituationen, können aber nicht zwischen hilfreichen Informationen und schädlichem Content unterscheiden. Im Gegenteil: Je emotionaler und schockierender der Inhalt, desto höher die Verbreitung.

Mittlerweile kommen sogar KI-generierte Fake-Videos und manipulierte Audiodateien dazu, die in Echtzeit während Krisen erstellt und verbreitet werden. Deepfakes von Politikern oder gefälschte Polizeimeldungen erschweren die Lage zusätzlich.

Polizei und Rettungskräfte werden behindert

Für Polizei und Rettungskräfte bedeuten diese ungefilterten Informationsströme einen Alptraum. Sebastian Fiedler vom Bund Deutscher Kriminalbeamter erklärt: Einsatzkräfte müssen wertvolle Zeit damit verschwenden, Falschmeldungen zu überprüfen und zu widerlegen. Ressourcen werden an falsche Orte geschickt, während echte Notfälle möglicherweise nicht die nötige Aufmerksamkeit bekommen.

Besonders problematisch: Live-Streams von Tatorten können Täter über Polizeipositionen informieren oder weitere Anschläge inspirieren. Mehrere Terroranschläge der letzten Jahre wurden bewusst für maximale Social-Media-Aufmerksamkeit inszeniert.

Medien als Verstärker der Problematik

Auch traditionelle Medien tragen Verantwortung. Viele Redaktionen übernehmen ungeprüft Material aus sozialen Netzwerken, zeigen Täter unverpixelt oder nennen deren Namen. Medienexperten warnen seit Jahren: Solche Darstellungen können zur Nachahmung anstiften und Täter zu „Helden“ stilisieren.

Einige Medienunternehmen haben inzwischen Richtlinien entwickelt: Keine Namen von Attentätern, keine heroischen Posen, keine ungefilterte Übernahme von Social-Media-Content. Doch längst nicht alle befolgen diese Regeln konsequent.

[av_video src=’https://vimeo.com/476274405′ mobile_image=“ attachment=“ attachment_size=“ format=’16-9′ width=’16‘ height=’9′ conditional_play=“ av_uid=’av-8fuo9oc‘]

Sebastian Fiedler über Fotos und Videos im Netz nach einem Attentat

Lösungsansätze: Mehr als nur Content-Moderation

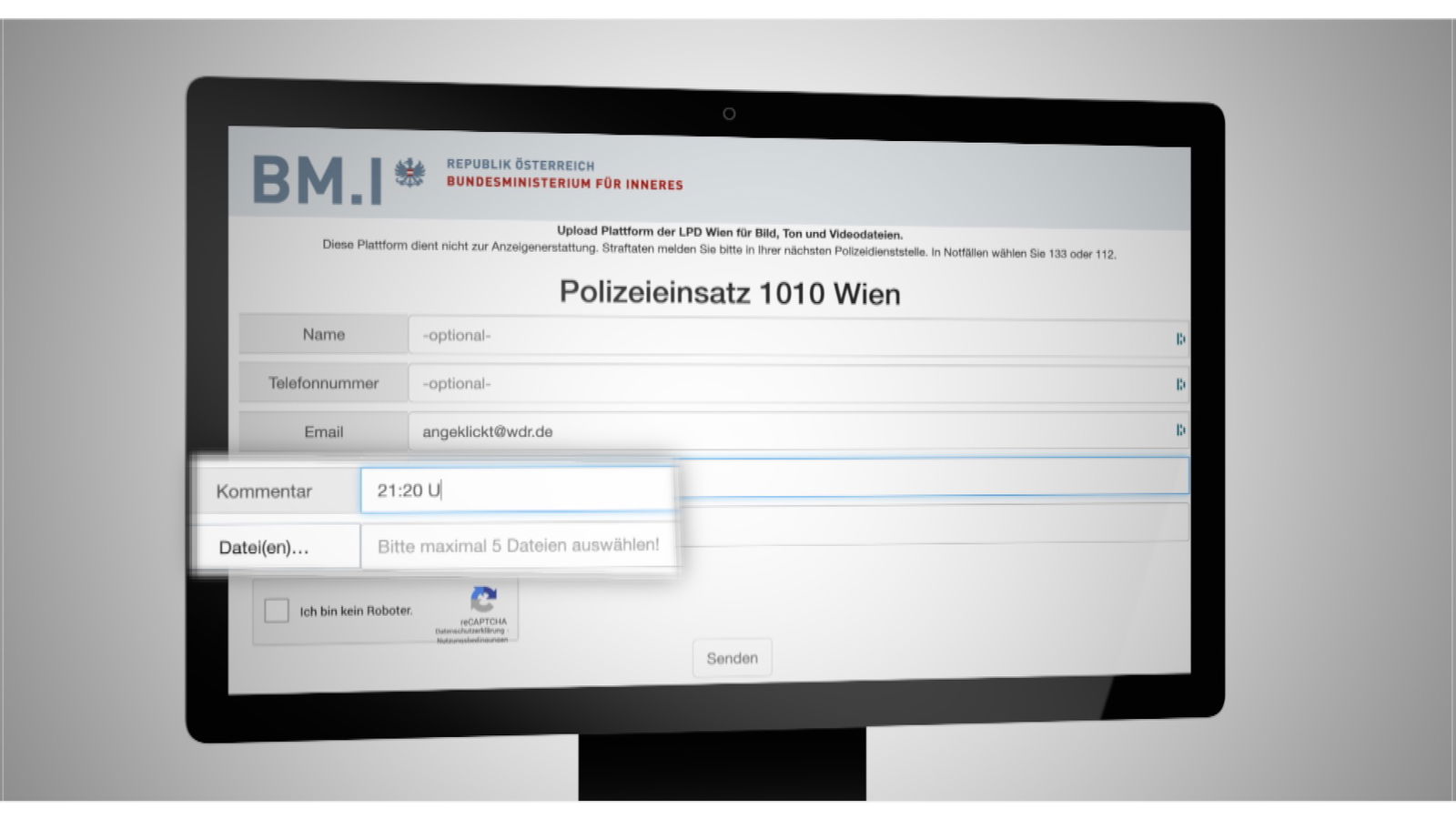

Experten fordern umfassende Reformen. In Krisensituationen sollten Plattformen bevorzugt verifizierte Quellen wie Polizei, Feuerwehr oder offizielle Behördenaccounts ausspielen. Algorithmen müssten so programmiert werden, dass sie in solchen Phasen auf maximale Verifikation statt auf Engagement setzen.

Einige Plattformen testen bereits „Crisis Mode“ Features, die automatisch strengere Moderationsregeln aktivieren. LinkedIn pausiert beispielsweise bei bestimmten Ereignissen das Ausspielen von Content aus betroffenen Regionen komplett.

Die EU arbeitet mit dem Digital Services Act (DSA) an rechtlichen Verpflichtungen für Plattformen. Diese müssen künftig nachweisen, wie sie in Krisensituationen Desinformation bekämpfen und verstörende Inhalte moderieren.

Nutzerverantwortung nicht vergessen

Auch Nutzer tragen Verantwortung. Wer in Krisensituationen ungeprüft weiterleitet, Videos aus Sensationslust teilt oder Gerüchte verbreitet, wird Teil des Problems. Digital Literacy – die Fähigkeit, Informationen kritisch zu bewerten – wird zur Bürgerpflicht.

Krisenkommunikation im digitalen Zeitalter braucht neue Regeln, technische Lösungen und vor allem: das Bewusstsein aller Beteiligten für ihre Verantwortung. Denn in Ausnahmesituationen können wenige Minuten über Leben und Tod entscheiden.

Zuletzt aktualisiert am 27.02.2026