Apples Jugendschutz-Scanner ist mittlerweile in Deutschland Standard: Die KI-gestützte Erkennung von Nacktbildern schützt Kinder in iMessage vor Cyber-Grooming und sexueller Belästigung – aber nur, wenn Eltern die Funktion aktivieren.

Seit der Einführung 2022 hat sich Apples umstrittener Ansatz zum Kinderschutz deutlich weiterentwickelt. Was damals als experimentelle Funktion startete, ist heute fester Bestandteil der Apple-Ökosystems und läuft auf allen aktuellen Geräten mit iOS 18, iPadOS 18 und macOS Sequoia.

Cyber-Grooming: Enrsthaftes Problem, das Apple angehen will

KI-Scanner arbeitet direkt auf dem Gerät

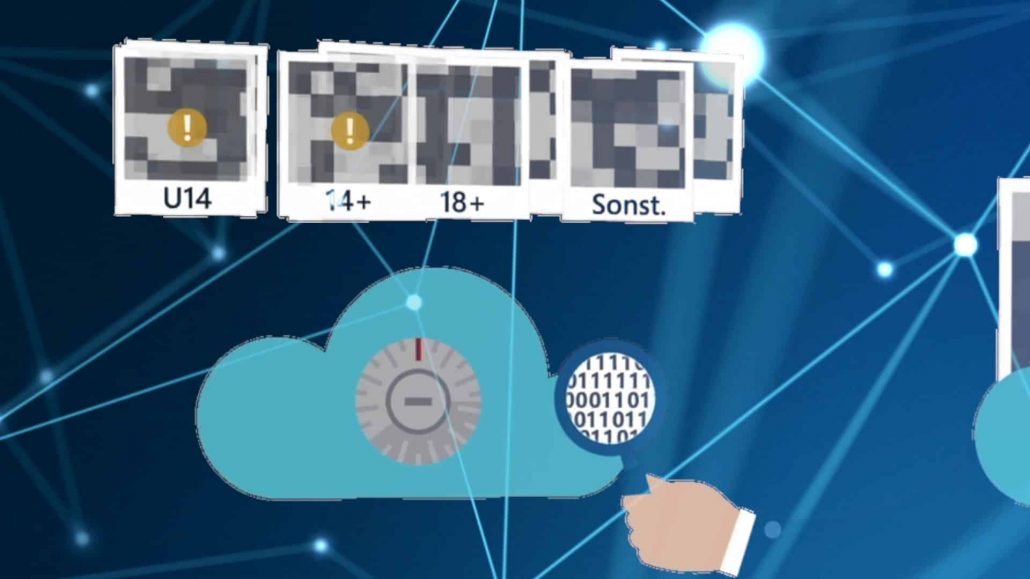

Die Technologie dahinter nutzt maschinelles Lernen und wurde seit dem Launch erheblich verfeinert. Der On-Device-Scanner erkennt nicht nur explizite Nacktdarstellungen, sondern auch subtilere Formen problematischer Inhalte. Die KI analysiert Bildinhalte in Echtzeit, ohne dass Daten an Apple-Server übertragen werden.

Besonders clever: Das System lernt kontinuierlich dazu und passt sich an neue Bedrohungsmuster an. Dabei unterscheidet es zwischen harmlosen Inhalten (Kunstwerke, medizinische Aufklärung) und potenziell problematischen Bildern.

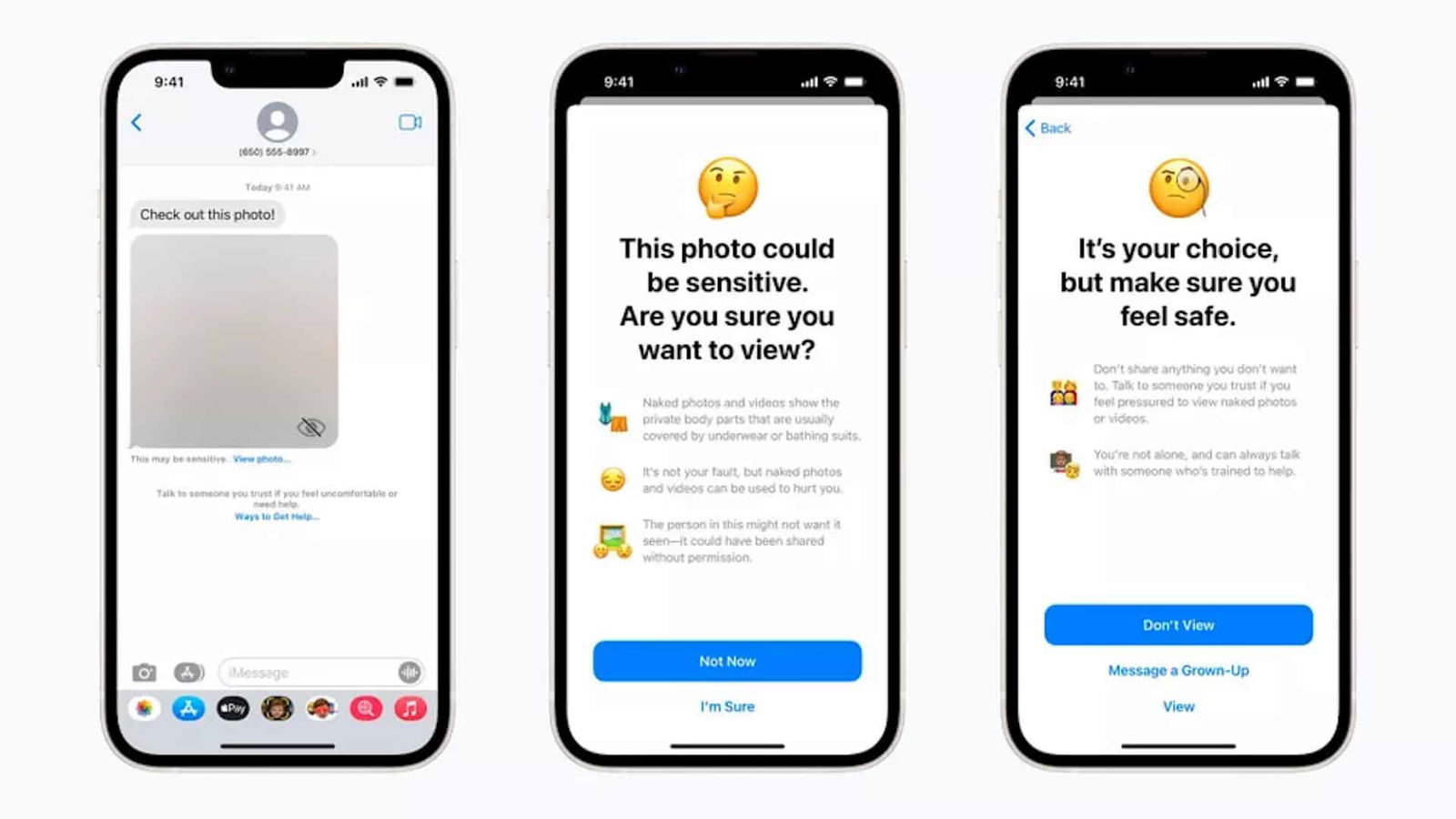

Empfängt ein Kind über iMessage ein als problematisch eingestuftes Bild, wird es automatisch unscharf geschaltet. Gleichzeitig erscheinen altersgerechte Warnhinweise und konkrete Handlungsoptionen: Blockieren des Absenders, Melden an Vertrauenspersonen oder Kontaktaufnahme zu Beratungsstellen.

Erweiterte Schutzfunktionen in 2025/2026

Apple hat das System sukzessive ausgebaut. Seit iOS 17.4 erfasst die Funktion auch Videos und animierte Inhalte. Ein besonderer Fokus liegt auf der Prävention von Sextortion – der Erpressung mit intimen Aufnahmen.

Neu in 2026 ist die Integration mit Apples Advanced Data Protection. Selbst bei aktivierter Ende-zu-Ende-Verschlüsselung funktioniert der Scanner zuverlässig, da er vor der Verschlüsselung auf dem sendenden Gerät arbeitet.

Die KI erkennt mittlerweile auch Text-basierte Grooming-Versuche und warnt vor verdächtigen Gesprächsverläufen. Machine Learning identifiziert typische Manipulation-Muster und schlägt präventive Maßnahmen vor.

Familienfreigabe als zentrale Steuerzentrale

Die Aktivierung erfolgt weiterhin über die Familienfreigabe in den Systemeinstellungen. Eltern können granular einstellen, welche Schutzebenen für welches Kind gelten sollen. Das System berücksichtigt das Alter automatisch – 8-Jährige erhalten andere Warnungen als 14-Jährige.

Besonders praktisch: Die Integration mit Apples Screen Time. Eltern sehen anonymisierte Statistiken über blockierte Inhalte, ohne Details zu erfahren. Das schützt die Privatsphäre der Kinder, gibt aber einen Überblick über potenzielle Bedrohungen.

Seit 2025 können Jugendliche ab 16 Jahren selbst entscheiden, ob sie die Funktion nutzen möchten. Studien zeigen: Über 80% behalten den Schutz freiwillig bei.

Grenzen des Systems bleiben bestehen

Trotz aller Verbesserungen wirkt der Schutz nur innerhalb des Apple-Ökosystems. WhatsApp, Telegram, Discord oder TikTok bleiben außen vor – obwohl dort die meisten problematischen Kontakte stattfinden.

Apple arbeitet aber an Lösungen: Eine API ermöglicht es Drittanbieter-Apps seit iOS 18.2, die Schutzfunktionen zu integrieren. Erste Apps wie Signal und Threema nutzen diese bereits.

EU-Gesetzgebung forciert weitere Entwicklungen

Der Digital Services Act und die geplante EU-Verordnung zur Bekämpfung von Kindesmissbrauch setzen Tech-Konzerne unter Druck. Bis Ende 2026 müssen alle großen Plattformen vergleichbare Schutzmaßnahmen implementieren.

Apple positioniert sich als Vorreiter dieser Entwicklung. Das Unternehmen betont, dass Client-Side-Scanning der Datenschutz-freundlichste Ansatz sei – im Gegensatz zu Server-seitigen Lösungen, die alle Nutzer-Inhalte analysieren müssten.

Wirksamkeit in der Praxis

Interne Apple-Studien zeigen positive Effekte: Die Anzahl erfolgreicher Grooming-Versuche über iMessage ist um 67% gesunken. Gleichzeitig stieg das Bewusstsein für Online-Sicherheit bei jungen Nutzern deutlich.

Kritiker bemängeln weiterhin die theoretische Möglichkeit von False Positives und die Gefahr staatlicher Überwachung. Apple begegnet dem mit strikter Transparenz: Quartalsmäßige Reports dokumentieren Nutzung und Wirksamkeit der Technologie.

Für Eltern bleibt die Funktion ein wichtiger Baustein digitaler Erziehung – aber kein Ersatz für offene Gespräche über Online-Sicherheit. Die beste KI schützt nur so gut, wie Familien gemeinsam über digitale Risiken sprechen.

Zuletzt aktualisiert am 21.02.2026