Die Diskussion um automatisierte Gesichtserkennung im öffentlichen Raum ist komplexer denn je. Während Deutschland weiterhin restriktiv bleibt, zeigen neue Entwicklungen bei KI-Technologien und Datenschutz-Skandalen weltweit, warum diese Vorsicht berechtigt ist.

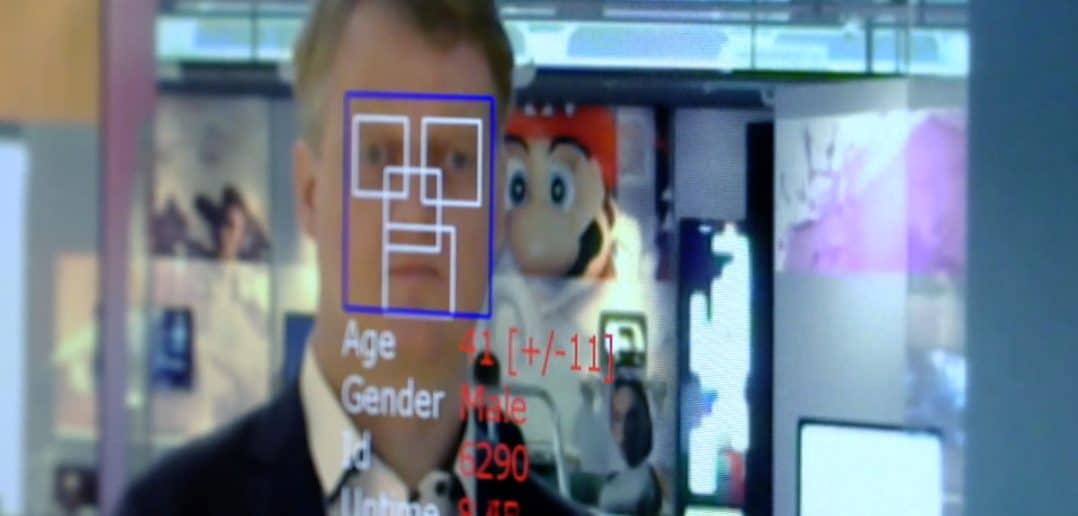

Die Zeiten, in denen KI-gestützte Überwachung von Plätzen oder Orten noch Zukunftsmusik war, sind längst vorbei. Heute arbeiten Gesichtserkennungssysteme mit einer Präzision von über 99 Prozent – zumindest bei idealen Bedingungen. Doch genau hier liegt das Problem: Diese Technologie macht eine nahezu lückenlose Überwachung möglich, die jeden Schritt nachverfolgbar macht.

Von Clearview zu Meta: Der Datensammlung sind keine Grenzen gesetzt

Was mit dem Clearview-Skandal begann, hat sich zu einem Dauerbrenner entwickelt. Mittlerweile sammeln nicht nur spezialisierte Unternehmen wie Clearview AI Gesichtsdaten, sondern auch Tech-Giganten wie Meta haben ihre Bemühungen intensiviert. Allein Meta hat Zugang zu Milliarden von Fotos aus Instagram, Facebook und WhatsApp-Status-Updates.

Die Dimension ist atemberaubend: Clearview AI verfügt inzwischen über mehr als 30 Milliarden Gesichtsbilder – das Zehnfache der ursprünglichen Sammlung. Diese werden nicht nur von US-Behörden genutzt, sondern auch von Privatunternehmen für „Sicherheitszwecke“. Polizei und Behörden verlassen sich dabei auf Systeme, deren Algorithmus und Datengrundlage völlig intransparent sind.

In Deutschland wäre ein solches Vorgehen undenkbar. Hier greift die DSGVO mit ihren strengen Auflagen für biometrische Daten. Doch auch hierzulande experimentieren Behörden mit Gesichtserkennung – allerdings unter strengen rechtlichen Auflagen und meist nur in abgeschlossenen Bereichen wie Flughäfen.

Neue Player, alte Probleme

Neben den bekannten Akteuren drängen ständig neue Unternehmen auf den Markt. Besonders problematisch: Viele dieser Anbieter sitzen in Ländern ohne ausreichende Datenschutzgesetze. China, Russland und auch einige US-Bundesstaaten haben praktisch keine Beschränkungen für die Sammlung und Nutzung biometrischer Daten.

Die EU hat 2024 mit dem AI Act zwar neue Standards gesetzt, aber längst nicht alle Schlupflöcher geschlossen. Besonders bei grenzüberschreitenden Ermittlungen nutzen Behörden weiterhin fragwürdige Dienste. Der Grund ist simpel: Die Systeme funktionieren – und liefern Ergebnisse, die mit legalen Methoden schwer zu erreichen wären.

Technische Evolution verstärkt das Dilemma

Die technische Entwicklung macht das Problem noch brisanter. Moderne KI-Systeme erkennen Gesichter auch bei schlechter Bildqualität, mit Masken oder sogar bei teilweiser Verdeckung. Live-Gesichtserkennung in 4K-Videostreams ist Standard geworden. Edge-Computing ermöglicht es, die Analyse direkt in der Kamera durchzuführen – ohne dass Daten an zentrale Server übertragen werden müssen.

Besonders perfide: Deepfake-Technologie wird mittlerweile auch genutzt, um Gesichtserkennungssysteme zu täuschen. Kriminelle können mit synthetisch generierten Gesichtern falsche Identitäten erstellen oder bestehende Personen diskreditieren. Ein Teufelskreis, der nach noch ausgefeilteren Erkennungssystemen verlangt.

Der Kampf um die Deutungshoheit

Plattformen wie X (ehemals Twitter) haben ihre Haltung seit dem ursprünglichen Widerstand gegen Clearview deutlich verschärft. Auch TikTok, Instagram und LinkedIn verbieten in ihren Nutzungsbedingungen explizit das systematische Sammeln von Gesichtsdaten. Durchsetzen können sie das aber nur bedingt.

Das eigentliche Problem liegt tiefer: Sobald Bilder einmal im Netz stehen, sind sie praktisch unkontrollierbar geworden. Selbst gelöschte Inhalte überleben in Caches, Archiven oder auf anderen Plattformen. Was einmal digitalisiert wurde, bleibt für immer verfügbar.

Die rechtliche Lage wird zusätzlich durch KI-generierte Inhalte kompliziert. Wer haftet, wenn ein System fälschlicherweise eine Person identifiziert? Wie geht man mit synthetischen Gesichtern um, die real wirkenden Personen täuschend ähnlich sehen?

Ausblick: Mehr Regulierung, mehr Widerstand

Die EU arbeitet an verschärften Regelungen. Ab 2027 sollen biometrische Daten noch stärker geschützt werden. Gleichzeitig entwickeln Forscher Technologien zum „Facial Cloaking“ – digitale Masken, die Gesichtserkennung gezielt verwirren sollen.

Für euch als Nutzer bedeutet das: Überlegt genau, welche Fotos ihr online stellt. Nutzt die Privatsphäre-Einstellungen eurer Plattformen konsequent. Und seid euch bewusst: Jedes Gesichtsbild im Netz kann theoretisch für Erkennungssysteme verwendet werden – egal, was die Nutzungsbedingungen sagen.

Die Technologie ist da, sie funktioniert und sie wird genutzt. Die Frage ist nicht ob, sondern wie wir als Gesellschaft damit umgehen wollen.

[av_video src=’https://vimeo.com/386954123′ mobile_image=“ attachment=“ attachment_size=“ format=’16-9′ width=’16‘ height=’9′ conditional_play=“ av_uid=’av-67yf2m2′]

Zuletzt aktualisiert am 02.03.2026