KI-generierte Bilder sind heute kaum noch von echten Fotos zu unterscheiden. Google hat mit SynthID eine clevere Lösung entwickelt: Ein unsichtbares Wasserzeichen, das KI-Bilder dauerhaft kennzeichnet – selbst wenn sie bearbeitet werden.

Die Zeiten, in denen ihr KI-generierte Bilder noch leicht erkennen konntet, sind längst vorbei. Tools wie Midjourney, DALL-E 3, Adobe Firefly oder Googles Imagen 3 produzieren mittlerweile fotorealistische Ergebnisse, die selbst Experten täuschen. Das Problem: Ohne klare Kennzeichnung ist es praktisch unmöglich zu unterscheiden, ob ein Bild von einer KI oder einem Menschen stammt.

SynthID: Googles unsichtbare Lösung

Google hat bereits 2023 eine vielversprechende Technologie namens SynthID vorgestellt und kontinuierlich weiterentwickelt. Das System funktioniert elegant: Während eine KI ein Bild generiert, werden gleichzeitig winzige, für das menschliche Auge unsichtbare Markierungen ins Bild eingebettet. Diese digitale „DNA“ verrät später zweifelsfrei die KI-Herkunft.

Besonders clever: Anders als klassische Wasserzeichen, die sichtbar sind und das Bild stören, arbeitet SynthID komplett im Verborgenen. Ihr seht nichts, aber spezialisierte Software kann die Markierung jederzeit auslesen und das Bild als KI-generiert identifizieren.

Mittlerweile nutzt Google SynthID nicht nur für Bilder, sondern auch für KI-generierten Text und sogar Audioinhalte. Die Technologie ist in Googles eigene KI-Tools wie Bard und Imagen integriert und wird über das „AI Test Kitchen“ kontinuierlich verbessert.

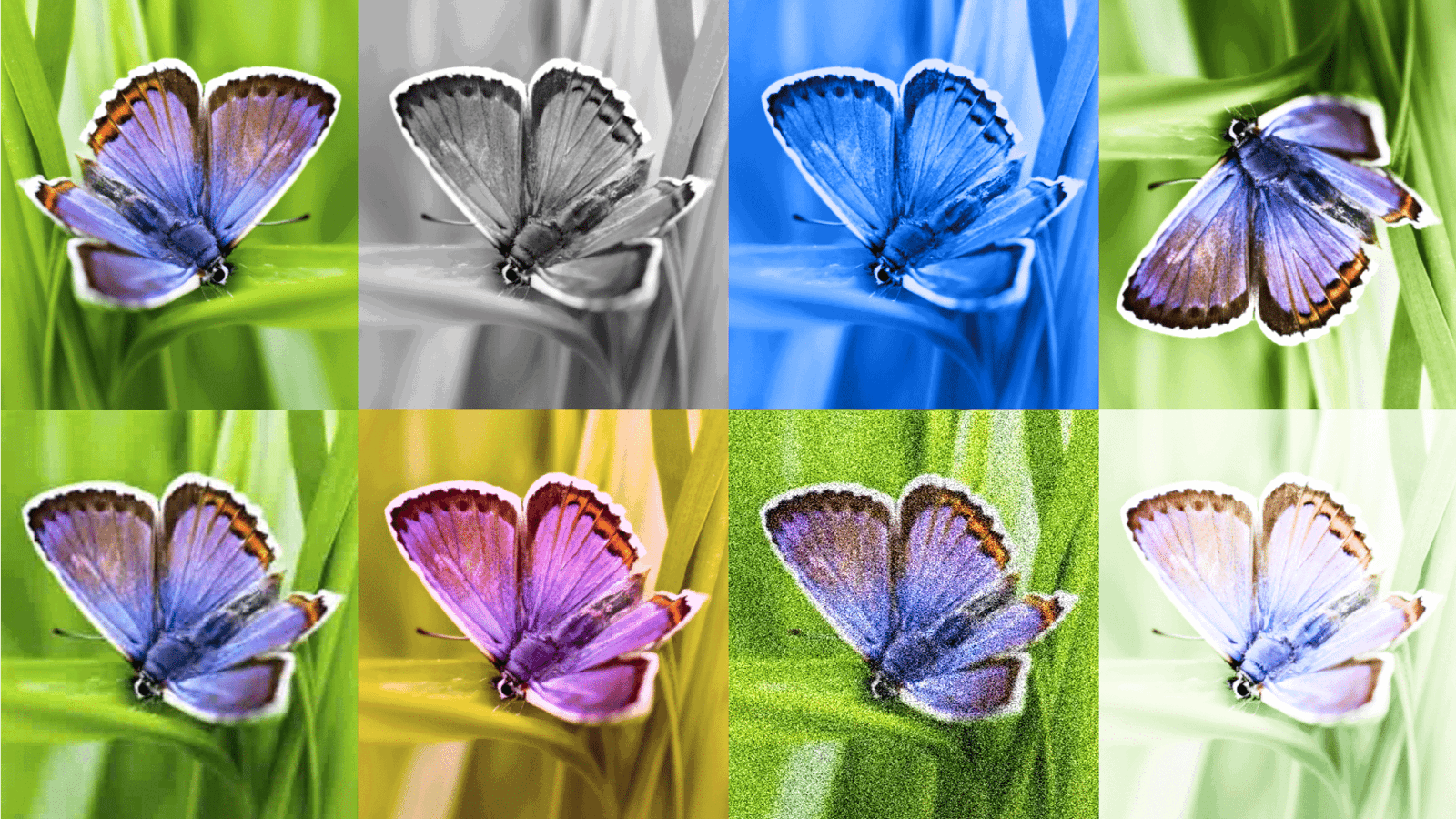

Robuste Technologie übersteht Bildbearbeitung

Das Geniale an SynthID: Das Wasserzeichen übersteht praktisch alle gängigen Bildmanipulationen. Ob ihr das Bild beschneidet, die Farben anpasst, Filter anwendet oder es komprimiert – die Markierung bleibt erhalten. Selbst bei einer Änderung der Auflösung oder beim Konvertieren in andere Dateiformate verschwindet sie nicht.

Diese Robustheit ist entscheidend, denn frühere Wasserzeichen-Systeme ließen sich oft durch simple Bearbeitungen entfernen. Google hat aus diesen Schwächen gelernt und SynthID entsprechend widerstandsfähig entwickelt.

Die Technologie funktioniert, indem sie die Pixel-Informationen auf eine mathematisch ausgeklügelte Weise verändert. Diese Änderungen sind so minimal, dass sie die visuelle Qualität nicht beeinträchtigen, aber dennoch stark genug, um verschiedene Bearbeitungsschritte zu überstehen.

Branchenweite Adoption noch nicht erreicht

Trotz der technischen Eleganz gibt es einen Haken: Bislang nutzt hauptsächlich Google selbst SynthID in seinen Produkten. Andere große KI-Anbieter wie OpenAI, Anthropic oder Stability AI haben eigene Ansätze entwickelt oder setzen auf alternative Kennzeichnungsmethoden.

OpenAI experimentiert beispielsweise mit C2PA-Metadaten (Coalition for Content Provenance and Authenticity), während Adobe auf Content Credentials setzt. Diese Standards speichern Herkunftsinformationen in den Metadaten der Dateien – allerdings lassen sich diese leichter entfernen als SynthIDs eingebettete Markierungen.

Meta (Facebook) arbeitet an ähnlichen Lösungen für seine KI-Tools, während Microsoft eine Kombination verschiedener Ansätze verfolgt. Die Fragmentierung der Branche erschwert eine einheitliche Lösung.

Rechtliche Entwicklungen verstärken den Druck

Der politische und rechtliche Druck auf KI-Anbieter wächst kontinuierlich. Die EU-KI-Verordnung, die 2024 in Kraft getreten ist, fordert explizit die Kennzeichnung KI-generierter Inhalte. Auch in den USA diskutiert der Kongress entsprechende Regelungen.

Viele Plattformen haben bereits reagiert: YouTube kennzeichnet KI-generierte Videos, während Instagram und Facebook entsprechende Labels für Bilder testen. TikTok experimentiert mit automatischer Erkennung von KI-Inhalten.

Diese Entwicklungen könnten die Adoption von Technologien wie SynthID beschleunigen, da Unternehmen rechtliche Compliance sicherstellen müssen.

Grenzen und Herausforderungen

Selbst SynthID ist nicht perfekt. Sehr aggressive Bildbearbeitung kann die Wasserzeichen schwächen oder unlesbar machen. Zudem funktioniert das System nur, wenn KI-Anbieter es tatsächlich implementieren – was bei Open-Source-Modellen oder weniger kooperativen Anbietern nicht garantiert ist.

Ein weiteres Problem: Die Technologie kann nur neu generierte Bilder kennzeichnen. Bereits existierende KI-Bilder ohne Wasserzeichen bleiben unerkannt. Auch die Entwicklung von „Adversarial Attacks“ – speziellen Methoden zum Entfernen von Wasserzeichen – stellt eine Herausforderung dar.

Ausblick: Standardisierung als Schlüssel

Die Zukunft der KI-Bildkennzeichnung hängt von der Bereitschaft der Branche ab, gemeinsame Standards zu entwickeln. Initiativen wie die Partnership on AI oder das Project Origin arbeiten an branchenweiten Lösungen.

Google hat angekündigt, SynthID als Open-Source-Lösung verfügbar zu machen, was die Adoption fördern könnte. Gleichzeitig entwickelt das Unternehmen die Technologie weiter, um sie noch robuster gegen Manipulationsversuche zu machen.

Für euch als Nutzer bedeutet das: In naher Zukunft werdet ihr wahrscheinlich immer häufiger automatische Kennzeichnungen von KI-Inhalten sehen. Das ist ein wichtiger Schritt für mehr Transparenz in einer Welt, in der die Grenzen zwischen künstlich und echt zunehmend verschwimmen.

Zuletzt aktualisiert am 18.02.2026