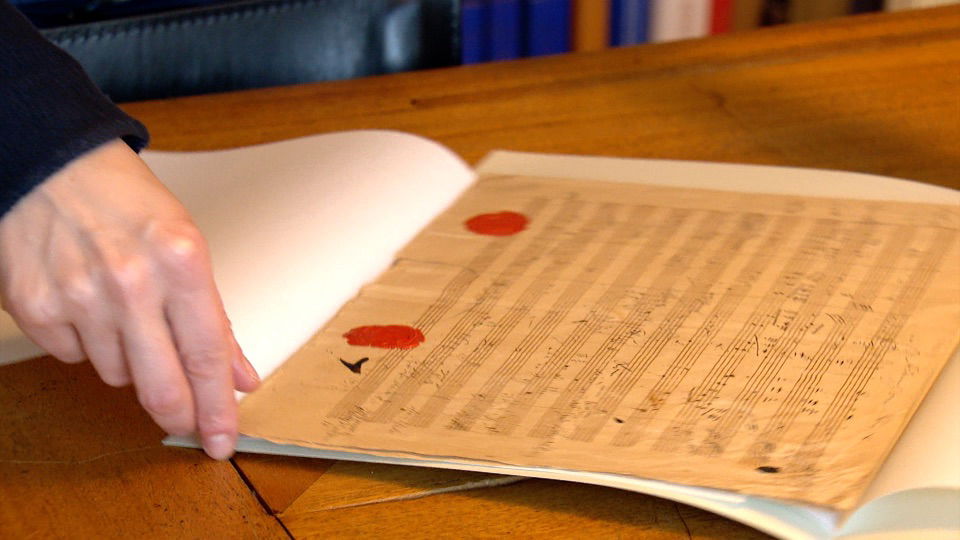

Künstliche Intelligenz komponiert heute nicht nur Ambient-Sounds für Streaming-Dienste, sondern wagt sich an die ganz großen Klassiker heran. Nachdem bereits 2020 Beethovens 10. Symphonie durch KI vollendet wurde, haben sich AI-Systeme zu echten Komponisten-Assistenten entwickelt. Was damals als Experiment begann, ist heute Realität: KI erschafft vollständige Orchesterstücke, die selbst Musikwissenschaftler verblüffen.

Das Beethoven-Projekt der Telekom war nur der Anfang. Inzwischen nutzen Komponisten weltweit AI-Tools wie MuseNet, AIVA oder das neue Anthropic Composer, um ihre kreativen Prozesse zu erweitern. Diese Systeme analysieren nicht mehr nur historische Partituren, sondern verstehen komplexe harmonische Strukturen, emotionale Bögen und sogar kulturelle Kontexte.

Von Beethoven zu Bach: KI als Komponisten-Partner

Die Technologie hat sich dramatisch weiterentwickelt. Während 2020 noch monatelange Trainingszeiten nötig waren, generieren heutige AI-Systeme in Echtzeit komplette Orchestersätze. Sony AI hat 2024 eine unvollendete Bach-Kantate rekonstruiert, und Warner Music arbeitet mit KI-generierten Soundtracks für Blockbuster-Filme.

Der Durchbruch kam mit Transformer-basierten Modellen, die musikalische Patterns über längere Zeiträume verstehen. Diese „Large Music Models“ wurden mit Millionen von Stunden klassischer, romantischer und moderner Musik trainiert. Sie erkennen nicht nur Melodien und Harmonien, sondern auch subtile stilistische Eigenarten einzelner Komponisten.

Besonders faszinierend: Die KI kann verschiedene Epochen miteinander verschmelzen. So entstehen Neo-Klassik-Stücke, die Beethovens Dramatik mit modernen Harmonien verbinden, oder Jazz-Variationen barocker Themen. YouTube Music und Spotify setzen bereits solche AI-Kompositionen in ihren „Focus“-Playlists ein.

Wie funktioniert die Musik-KI heute?

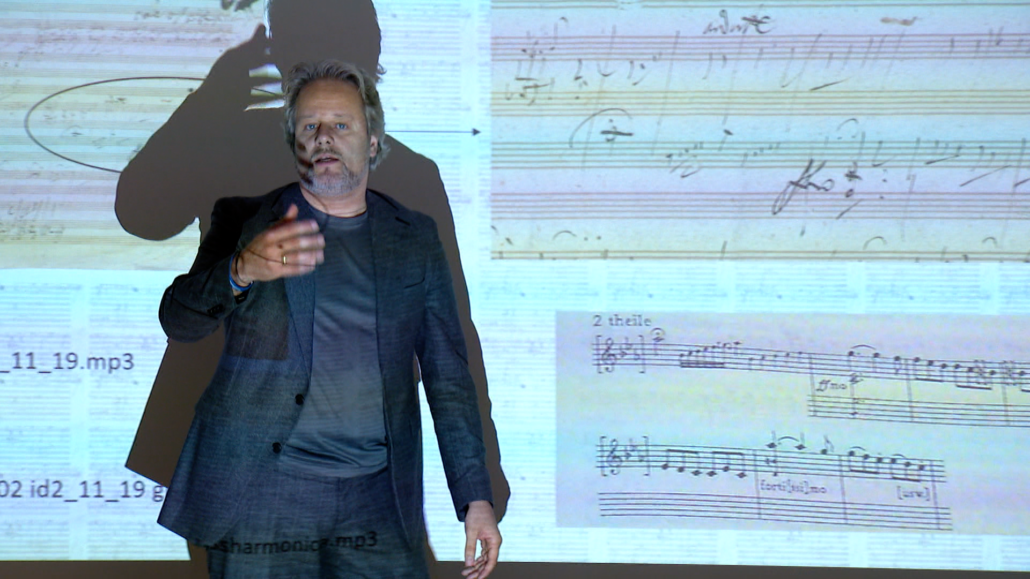

Moderne Musik-AI arbeitet in mehreren Schichten. Zuerst analysiert sie die musikalische DNA eines Komponisten: Welche Intervalle bevorzugte er? Wie baute er Spannungsbögen auf? Welche Instrumentierungen nutzte er für emotionale Höhepunkte?

Dann generiert die KI nicht einfach zufällige Noten, sondern entwickelt musikalische Gedanken weiter. Sie „denkt“ in Phrasen, Themen und Variationen – genau wie ein menschlicher Komponist. Dabei berücksichtigt sie auch praktische Aspekte: Ist eine Passage für Violinen spielbar? Klingt die Harmonik in der gewählten Tonart optimal?

Die besten Ergebnisse entstehen durch Mensch-Maschine-Kollaboration. Komponisten skizzieren grobe Ideen, die KI entwickelt Variationen und Ausarbeitungen. Der Mensch wählt aus, verwirft, verfeinert. So entstehen Werke, die weder rein menschlich noch rein maschinell sind, sondern etwas völlig Neues.

Kreativität oder Simulation? Die große Debatte

Die philosophische Frage bleibt spannend: Kann eine Maschine wirklich kreativ sein? Aktuelle KI-Systeme überraschen selbst ihre Programmierer mit unerwarteten musikalischen Wendungen. Sie entwickeln eigene „Vorlieben“ für bestimmte Harmonien und entdecken Verbindungen zwischen scheinbar unverwandten Musikstilen.

Doch echte Kreativität entsteht aus Lebenserfahrung, Emotionen, kulturellem Kontext. Eine KI kann Beethovens Stil perfekt imitieren, aber sie hat nie die Verzweiflung seiner Taubheit gespürt oder die Euphorie einer erfolgreichen Uraufführung erlebt. Sie komponiert technisch brillant, aber ohne die menschliche Seele, die große Kunst ausmacht.

Trotzdem: Die Ergebnisse sind oft verblüffend. Blinde Hörtests zeigen, dass Musikliebhaber KI-Kompositionen nicht zuverlässig von menschlichen Werken unterscheiden können. Vielleicht ist das auch gar nicht der Punkt.

Die Zukunft der AI-Musik

Musik-KI wird nicht menschliche Komponisten ersetzen, sondern neue kreative Möglichkeiten eröffnen. Schon heute nutzen Filmkomponisten AI-Tools für erste Entwürfe, die sie dann ausarbeiten. Indie-Musiker lassen sich von KI-generierten Melodien inspirieren. Musikschulen setzen AI ein, um Schülern Harmonielehre zu vermitteln.

Die nächste Generation wird multimodal: KI komponiert passend zu Bildern, Texten oder sogar Emotionen in Echtzeit. Stellt euch vor, euer Smartphone komponiert spontan den Soundtrack zu eurem Spaziergang, abgestimmt auf Wetter, Stimmung und Tageszeit.

Auch die Demokratisierung schreitet voran. Was früher ein Orchester und Monate Arbeit erforderte, schafft heute jeder mit einem Laptop. Plattformen wie Amper Music oder Boomy ermöglichen es jedem, in Minuten professionell klingende Musik zu erstellen.

Das Beethoven-Projekt war erst der Anfang einer Revolution, die unser Verständnis von Musik, Kreativität und künstlicher Intelligenz fundamental verändert. Die Frage ist nicht mehr, ob KI komponieren kann – sondern wie wir diese neue kreative Partnerschaft nutzen werden.

Interview mit Projektleiter Dr. Matthias Röder

Zuletzt aktualisiert am 02.03.2026