Jedes Mal, wenn ihr ChatGPT eine Frage stellt oder ein KI-Bild generiert, laufen im Hintergrund riesige Rechenzentren auf Hochtouren. Was die meisten nicht wissen: Eine einzige ChatGPT-Anfrage verbraucht etwa zehnmal so viel Energie wie eine Google-Suche. Und während Google täglich Milliarden Suchanfragen verarbeitet, explodiert parallel die Nutzung von KI-Diensten.

Die Folge: Energieversorger und Datenzentren stehen vor einem massiven Problem. Die vorhandene Infrastruktur kommt an ihre Grenzen. Hersteller wetteifern jetzt um innovative Transformatoren der nächsten Generation, die den explodierenden Strombedarf bewältigen können. Das klingt nach einem technischen Detail – hat aber direkte Auswirkungen auf eure Stromrechnung und die Klimabilanz.

In diesem Artikel schauen wir uns an, warum KI so hungrig nach Energie ist, welche Lösungen die Industrie entwickelt und was das konkret für euch bedeutet.

Warum verbraucht KI so viel Strom?

Der Stromhunger von KI hat zwei Hauptursachen: das Training der Modelle und der laufende Betrieb. Beim Training werden Milliarden von Parametern optimiert – ein Prozess, der Wochen oder Monate dauern kann und Tausende spezialisierte Grafikprozessoren (GPUs) beschäftigt. Eine einzige Trainingsrunde für ein großes Sprachmodell kann so viel Energie verbrauchen wie hundert Haushalte in einem ganzen Jahr.

Aber auch im Alltag ist der Betrieb energieintensiv. Jede Anfrage an ChatGPT, Claude oder andere KI-Systeme muss durch komplexe neuronale Netze mit Milliarden Parametern laufen. Die Server müssen dabei permanent auf Betriebstemperatur gehalten werden – und das bedeutet nicht nur Rechenleistung, sondern auch massive Kühlsysteme, die zusätzlich Strom verbrauchen.

Experten schätzen, dass ein durchschnittliches Datenzentrum für KI-Anwendungen etwa 30 bis 40 Prozent seiner Energie allein für die Kühlung benötigt. Der Rest geht in die Rechenleistung. Und während klassische Webserver relativ genügsam sind, ziehen KI-Server ein Vielfaches an Leistung.

Die Internationale Energieagentur warnt: Bis 2026 könnte der Stromverbrauch von Datenzentren weltweit um über 70 Prozent steigen – hauptsächlich getrieben durch KI-Anwendungen. Das entspricht ungefähr dem gesamten Stromverbrauch von Deutschland.

Datenzentren Energie: Wenn die Stromnetze überlasten

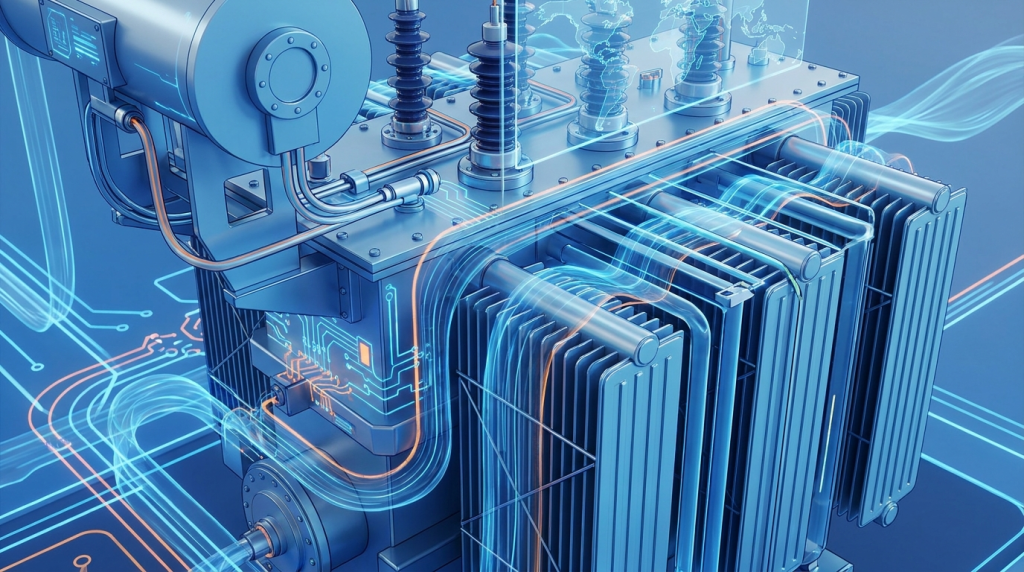

Hier kommen die Transformatoren ins Spiel. Diese unscheinbaren Kästen wandeln Hochspannung aus dem Stromnetz in die für Datenzentren nutzbare Form um. Klingt simpel, ist aber eine der größten Herausforderungen beim Ausbau der KI-Infrastruktur.

Das Problem: Herkömmliche Trafos sind nicht für die extremen Lastspitzen ausgelegt, die KI-Rechenzentren erzeugen. Wenn Tausende GPUs gleichzeitig hochfahren, entstehen massive Stromschwankungen. Klassische Transformatoren können überhitzen oder im schlimmsten Fall ausfallen.

Deshalb entwickeln Hersteller jetzt spezialisierte Hochleistungs-Trafos mit verbesserter Kühlung, höherer Effizienz und intelligenter Lastverteilung. Diese Geräte sind nicht nur leistungsfähiger, sondern auch effizienter – sie verschwenden weniger Energie als Abwärme.

Ein weiterer Aspekt: Die Lieferzeiten. Während ein Standard-Trafo in wenigen Wochen verfügbar ist, müssen Datenzentren-Betreiber für Spezialanfertigungen teilweise über ein Jahr warten. Das bremst den Ausbau der KI-Infrastruktur und treibt die Preise nach oben.

Steigen eure Energiekosten durch KI?

Jetzt wird es konkret: Der massive Strombedarf von KI-Datenzentren hat direkte Auswirkungen auf die Energiepreise. Wenn in eurer Region große Rechenzentren entstehen, steigt die Nachfrage im lokalen Stromnetz. Das kann besonders in Zeiten hoher Auslastung zu Preisspitzen führen.

In den USA gibt es bereits Regionen, in denen Energieversorger die Netzentgelte erhöhen mussten, weil Datenzentren die Infrastruktur überlasten. In Deutschland ist die Situation noch entspannter, aber auch hier warnen Netzbetreiber vor steigenden Kosten durch den Ausbau der digitalen Infrastruktur.

Hinzu kommt: Die Kosten für die neuen Hochleistungs-Transformatoren und den Netzausbau zahlen letztlich die Verbraucher über Netzentgelte und Strompreise. Branchenexperten rechnen damit, dass der KI-Boom die Energiekosten mittelfristig um einige Prozentpunkte erhöhen könnte.

Aber es gibt auch eine positive Seite: Die Entwicklung effizienterer Trafos und Kühlsysteme könnte langfristig dazu beitragen, den Energieverbrauch pro Rechenoperation zu senken. Wenn die Technologie ausgereift ist, könnte KI sogar energieeffizienter werden als heute.

KI Umweltauswirkungen: Der CO2-Fußabdruck erklärt

Während wir uns über praktische KI-Tools freuen, sollten wir den ökologischen Preis nicht ignorieren. Eine Studie der Universität Massachusetts hat berechnet, dass das Training eines einzigen großen KI-Modells so viel CO₂ verursachen kann wie fünf Autos über ihre gesamte Lebensdauer – inklusive Produktion.

Besonders problematisch: Viele Datenzentren laufen noch mit Strom aus fossilen Energiequellen. In Regionen mit hohem Kohle- oder Gasanteil im Strommix verschärft der KI-Boom die Klimakrise direkt. Tech-Konzerne versprechen zwar, auf erneuerbare Energien umzusteigen, aber die Realität hinkt den Ankündigungen oft hinterher.

Ein weiteres Problem ist der Wasserverbrauch für die Kühlung. Moderne Datenzentren verbrauchen Millionen Liter Wasser pro Tag. In trockenen Regionen konkurrieren sie damit um eine knappe Ressource – ein Konflikt, der sich verschärfen wird.

Es gibt aber auch Lichtblicke: Einige Betreiber experimentieren mit innovativen Kühlmethoden wie Tauchkühlung in speziellen Flüssigkeiten oder nutzen die Abwärme zum Heizen von Wohngebäuden. Solche Ansätze könnten die Umweltbilanz deutlich verbessern.

Wie könnt ihr den KI-Stromverbrauch reduzieren?

Ihr müsst nicht auf KI verzichten, könnt aber bewusster damit umgehen. Hier ein paar praktische Tipps, wie ihr den Energieverbrauch im Blick behaltet:

- Fragt gezielt: Statt mehrere vage Anfragen zu stellen, formuliert eure Frage präzise. Das spart Server-Rechenzeit.

- Nutzt lokale KI: Für einfache Aufgaben gibt es mittlerweile KI-Tools, die auf eurem Gerät laufen – ohne Cloud-Verbindung.

- Wählt bewusst: Einige Anbieter setzen stärker auf erneuerbare Energien. Informiert euch über die Nachhaltigkeitsberichte der Dienste, die ihr nutzt.

- Vermeidet Overkill: Für einfache Textkorrekturen braucht ihr kein GPT-4. Kleinere Modelle reichen oft aus und verbrauchen weniger Energie.

Auch bei der Bildgenerierung könnt ihr Energie sparen: Statt zehn Varianten eines Bildes zu generieren, überlegt vorher genauer, was ihr wollt. Jede Generation kostet Rechenleistung und damit Strom.

Achtet außerdem auf Open-Source-Alternativen. Viele dieser Projekte laufen auf effizienteren, kleineren Modellen und können lokal auf eurem Rechner ausgeführt werden. Das schont nicht nur die Umwelt, sondern schützt auch eure Daten.

Was muss sich beim KI-Stromverbrauch ändern?

Der KI-Boom ist nicht aufzuhalten – aber er muss nachhaltiger werden. Die Entwicklung effizienterer Transformatoren ist ein wichtiger Schritt, reicht aber nicht aus. Wir brauchen strengere Transparenzpflichten für Tech-Konzerne: Wie viel Energie verbrauchen ihre Modelle wirklich? Woher kommt der Strom?

Gleichzeitig müssen Regierungen den Ausbau erneuerbarer Energien beschleunigen. Wenn Datenzentren weiter wachsen, aber mit Kohlestrom laufen, verschlimmern wir die Klimakrise. Die gute Nachricht: Viele Betreiber haben erkannt, dass Nachhaltigkeit nicht nur ein PR-Thema ist, sondern auch wirtschaftlich sinnvoll – steigende Energiekosten machen Effizienz zum Wettbewerbsvorteil.

Für euch als Nutzer bedeutet das: Bleibt kritisch. Hinterfragt den Energieverbrauch der Dienste, die ihr nutzt. Und unterstützt Anbieter, die Transparenz zeigen und in nachhaltige Infrastruktur investieren. Der versteckte Preis der KI-Revolution sollte nicht auf Kosten künftiger Generationen gehen.