KI-generierte Fake-Interviews und manipulierte Inhalte erreichen 2026 eine neue Dimension. Was mit dem skandalösen Schumacher-Interview der „Aktuellen“ begann, ist heute Alltag – und fordert uns alle heraus, zwischen Wahrheit und KI-Fiction zu unterscheiden.

Ein Interview mit Michael Schumacher – das wäre auch heute noch der Coup jeder Redaktion. Seit seinem Skiunfall 2013 ist der Formel1-Pilot nicht mehr öffentlich aufgetreten. Seine Familie schützt konsequent seine Privatsphäre.

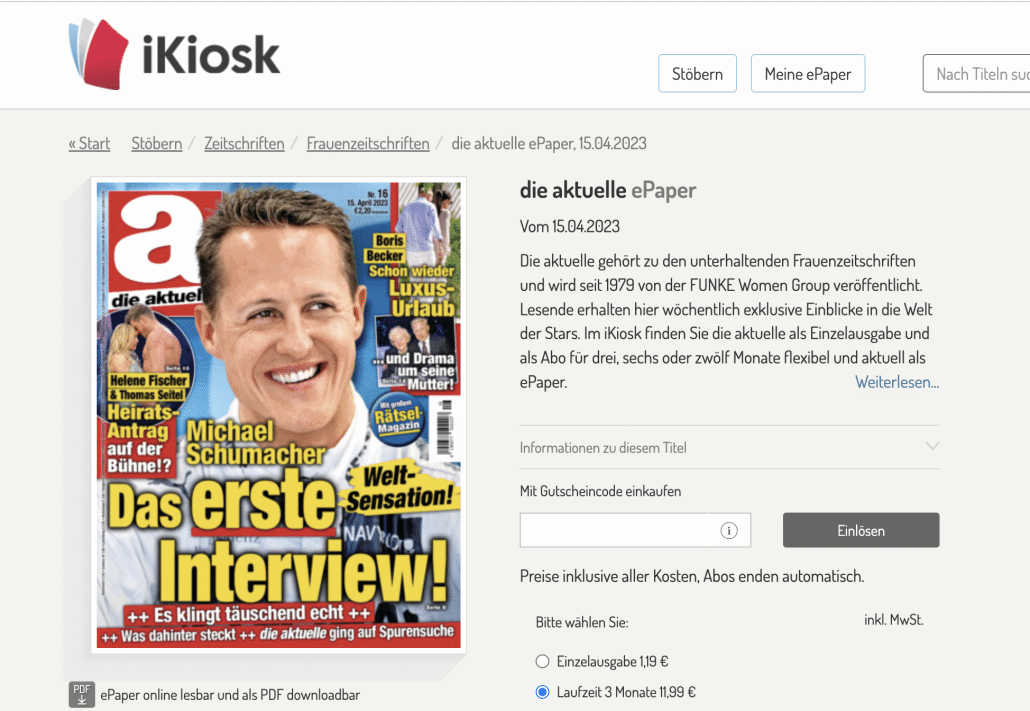

Doch 2023 versprach „die Aktuelle“ genau das: „Das erste Interview“ prangte fett auf der Titelseite neben Schumis Gesicht. Das Problem: Dieses Interview existierte nie. Eine KI musste herhalten – ein Skandal, der zum Wendepunkt wurde.

Der Schumacher-Skandal als Warnsignal

Rückblick: „Weltsensation“ verkündete das Blatt damals. Erst im Kleingedruckten fanden sich Hinweise wie „Es klingt täuschend echt!“ – Warnungen, die kein Fan mehr wahrnahm. Im Innenteil dann ein mehrseitiges Fake-Interview, geführt mit einer KI auf character.ai, einer Plattform für Prominenten-Chats.

Die Familie Schumacher ging rechtlich dagegen vor. Zu Recht. Doch dieser Fall war nur der Anfang einer Entwicklung, die 2026 längst Normalität geworden ist.

Die Aktuelle hat ein Fake-Interview auf die Titelseite gehoben

KI-Inhalte 2026: Perfektion macht alles komplizierter

Drei Jahre später sind KI-generierte Inhalte kaum noch von echten zu unterscheiden. GPT-5 und Claude 4 erstellen Texte, die stilistisch perfekt sind. Deepfake-Videos erreichen Kinoqualität. Audio-Klone klingen täuschend echt.

Das Problem: Während die Technologie exponentiell besser wurde, blieben die Lösungen für Kennzeichnung und Erkennung weit zurück. Watermarks lassen sich entfernen, Erkennungstools werden überlistet, KI-Detektoren versagen regelmäßig.

Besonders problematisch sind die neuen „Conversation-AI-Tools“: Plattformen wie Character.AI oder Replika haben sich zu High-End-Services entwickelt, die Persönlichkeiten so präzise nachahmen, dass selbst Experten ins Grübeln kommen.

Der Markt für Fake-Content boomt

Was 2023 noch Einzelfall war, ist 2026 Geschäftsmodell geworden. „Exclusive Interviews“ mit verstorbenen Prominenten füllen YouTube-Kanäle. Fake-Memoiren berühmter Persönlichkeiten erobern Bestseller-Listen. Social-Media-Accounts „toter“ Celebrities posten täglich neue „Gedanken“.

Die Monetarisierung ist perfektioniert: Abonnement-Services bieten Gespräche mit „Einstein“, „Mozart“ oder „Steve Jobs“. Dating-Apps werben mit KI-Klonen von Influencern. Podcast-Netzwerke produzieren „posthume“ Serien mit verstorbenen Entertainern.

Juristisch bewegen sich viele Anbieter in Grauzonen. Solange sie irgendwo „KI-generiert“ erwähnen – oft versteckt in ellenlangen AGBs – fühlen sie sich rechtlich abgesichert.

Authentifizierung: Der Kampf um die Wahrheit

Die Medienwelt reagiert mit neuen Authentifizierungs-Standards. Das „C2PA-Protokoll“ (Coalition for Content Provenance and Authenticity) etabliert sich 2026 als Standard für vertrauenswürdige Inhalte. Große Nachrichtenagenturen wie Reuters, AP und dpa nutzen Blockchain-basierte Zertifikate.

Tech-Konzerne entwickeln „Human-Made“-Badges weiter. Adobes „Content Credentials“ werden zur Norm in professionellen Medien. Canon und Nikon integrieren Hardware-Signaturen in ihre Kameras, die manipulation nachweisbar machen.

Doch das System funktioniert nur bei kooperierenden Akteuren. Betrüger ignorieren diese Standards weiterhin.

EU-Regulierung zeigt erste Wirkung

Der EU AI Act von 2024 zeigt 2026 erste konkrete Auswirkungen. Anbieter von KI-Tools müssen Inhalte standardmäßig kennzeichnen. Verstöße werden mit empfindlichen Strafen geahndet.

Deutschland verschärfte zusätzlich das Kunsturhebergesetz: KI-Inhalte, die ohne Einverständnis Persönlichkeitsrechte verletzen, sind strafbar. Die ersten Verurteilungen setzen Präzedenzfälle.

Doch die globale Natur des Internets macht Durchsetzung schwierig. Anbieter weichen in andere Jurisdiktionen aus.

Medienkompetenz wird überlebenswichtig

Die wichtigste Entwicklung: Menschen werden skeptischer und informierter. Schulen integrieren KI-Erkennung in den Lehrplan. Medienhäuser bieten Aufklärungs-Kampagnen.

Einfache Faustregeln etablieren sich:

– Misstraut sensationellen „Exklusiv“-Inhalten

– Prüft die Quelle und deren Reputation

– Sucht nach offiziellen Bestätigungen

– Achtet auf fehlende Metadaten

– Fragt euch: Ist das plausibel?

Die Zukunft: Leben mit der Unsicherheit

2026 wird klar: Eine Welt ohne KI-Inhalte gibt es nicht mehr zurück. Stattdessen entwickelt sich ein neues Ökosystem aus Vertrauen und Verifikation.

Seriöse Medien investieren massiv in Authentifizierungs-Technologien. Leser lernen, zwischen verschiedenen Vertrauensebenen zu unterscheiden. „Verified Human Content“ wird zum Qualitätsmerkmal.

Der Schumacher-Skandal von 2023 war nur der Anfang. Heute kämpfen wir täglich um die Unterscheidung zwischen Realität und KI-Fiction. Die gute Nachricht: Wir werden besser darin, die schlechte: Die KI auch.

Entscheidend bleibt: Kritisches Denken lässt sich nicht durch Algorithmen ersetzen. Noch nicht.

Zuletzt aktualisiert am 19.02.2026