Die EU zieht die Reißleine. Künftig sollen KI-Anwendungen, die sexualisierte Deepfakes erstellen, in der gesamten Union verboten sein. Und das ist auch gut so!

Die zyprische Ratspräsidentschaft hat in der Nacht eine Einigung zwischen Mitgliedstaaten und Europäischem Parlament verkündet. Was das konkret bedeutet, wer betroffen ist und warum das Datum 2. Dezember 2026 für jeden KI-Anbieter zur roten Linie wird, klären wir hier.

Worauf sich Brüssel geeinigt hat

In den vergangenen Monaten hat eine Debatte Deutschland aufgewühlt, die in vielen Wohnzimmern eingeschlagen ist: Ende März ging Collien Fernandes mit Vorwürfen gegen ihren Ex-Mann Christian Ulmen an die Öffentlichkeit. Tausende demonstrierten gegen digitale und sexualisierte Gewalt. Auch wenn es im konkreten Fall nicht um Deepfakes ging, verschob sich der politische Diskurs spürbar. Die EU hat reagiert.

Der Kern der Einigung: Wer KI-Tools anbietet, mit denen sich sexualisierte Deepfakes erzeugen lassen, darf das in Europa nicht mehr. Auch das Erstellen von Inhalten, die sexuellen Kindesmissbrauch darstellen, fällt explizit unter dieses Verbot. Geht die Reform durch, würde das Verbot ab 2. Dezember 2026 federführend vom KI-Amt der EU durchgesetzt werden, das vor zwei Jahren geschaffen wurde.

Damit verschiebt sich die Logik der Strafverfolgung grundsätzlich: Bisher wurde die Tat geahndet — also wer ein Deepfake erstellt oder verbreitet. Jetzt rückt das Werkzeug selbst in den Fokus. Das neue Verbot in der KI-Verordnung auf EU-Ebene würde die Perspektive von der Bestrafung der Tat hin zum Verbot des Werkzeugs wechseln, also der KI-Anwendung an sich. Anbieter wie OpenAI, Anthropic, Google oder xAI müssen also dafür sorgen, dass ihre Modelle solche Inhalte gar nicht erst produzieren.

Wo die Grenzen verlaufen

Eine zentrale Frage haben die Verhandler zumindest grob abgesteckt: Was genau zählt als „sexualisiert“? Im Gesetz soll das ausdrücklich definiert werden, damit normale Bildbearbeitung nicht mit kriminalisiert wird. Verhandlungsteilnehmer betonen, dass das Verbot nicht dazu führen soll, die Erstellung oder Manipulation von Bildern übermäßig stark einzuschränken. Praktisch bedeutet das: Nicht-einvernehmliche Bikini-Bilder, wie sie etwa von Grok auf X kursierten, könnten weiter erlaubt bleiben.

Eine politische Gratwanderung. Aus Sicht von Opferschutzverbänden ist die Lücke groß genug, um einen LKW hindurchzufahren. Aus Sicht der Industrie ist sie gerade breit genug, damit kreative und legitime Anwendungen nicht im Kollateralschaden untergehen.

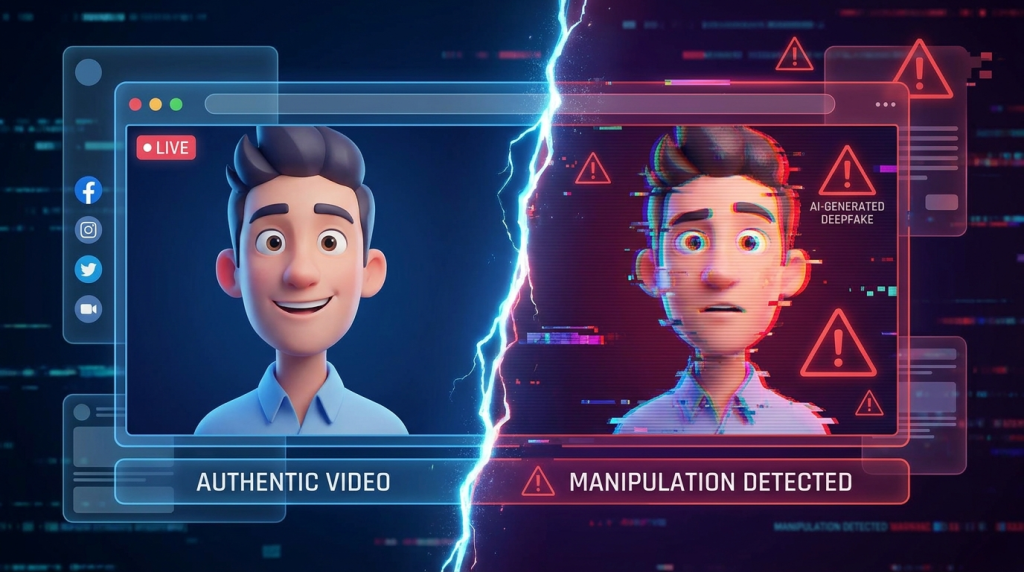

Wasserzeichen für KI-Inhalte: erst später Pflicht

Parallel zum Deepfake-Verbot rückt die EU einen anderen Termin nach hinten. Ursprünglich sollte das KI-Amt schon ab August 2026 strenge Kennzeichnungspflichten durchsetzen. Daraus wird jetzt Dezember 2026. Die Firmen hinter ChatGPT, Claude und Co. müssen jetzt erst ab Dezember 2026 KI-Inhalte deutlich als solche kennzeichnen — generierte Bilder und Videos müssten sie also mit Wasserzeichen markieren. Andere Regeln soll das KI-Amt erst ab Dezember 2027 durchsetzen.

Vier Monate Aufschub klingen wenig. Für die technische Umsetzung in globalen Modellen sind sie eine Ewigkeit. Wasserzeichen lassen sich nicht einfach „einschalten“. Jeder Anbieter muss eigene kryptografische Verfahren bauen, in die Bild- und Videogeneratoren einbetten und sicherstellen, dass die Markierungen auch nach Komprimierung, Screenshot oder Zuschnitt erhalten bleiben. C2PA und ähnliche Standards sind ein Anfang, aber kein fertiger Schalter.

Für dich als Nutzer heißt das: Bis Ende 2026 wirst du KI-generierte Inhalte nicht zuverlässig an einem Wasserzeichen erkennen. Die Verantwortung, Bilder und Videos kritisch zu prüfen, bleibt vorerst bei dir.

Warum 35 Millionen Euro im Raum stehen

Was passiert, wenn ein Anbieter sich nicht an die neuen Regeln hält? Der EU AI Act hat dafür ein dreistufiges Bußgeldsystem. Bei Verstößen gegen das Verbot bestimmter KI-Praktiken drohen 35 Millionen Euro oder 7 Prozent des weltweiten Jahresumsatzes — je nachdem, was höher ausfällt. Bei Verstößen gegen Pflichten für Hochrisiko-Systeme sind es bis zu 15 Millionen Euro oder 3 Prozent. Selbst falsche Angaben gegenüber Behörden können 7,5 Millionen Euro kosten.

Zur Einordnung: 7 Prozent vom Jahresumsatz. Microsoft hat im letzten Geschäftsjahr rund 245 Milliarden Dollar umgesetzt. Das wären rechnerisch über 17 Milliarden Dollar Strafe — pro Verstoß. Selbst wenn die Behörden nie das Maximum ausschöpfen würden, ist das Drohpotenzial brutal. Die EU will damit signalisieren: KI-Compliance ist Chefsache, nicht Aufgabe einer Nebenabteilung.

Was hat die EU davon — und was die Industrie?

Brüssel verfolgt ein Doppelziel. Auf der einen Seite: harter Schutz vor sexualisierten Deepfakes, gerade gegen Frauen und Kinder. Auf der anderen Seite: Vereinfachung anderer KI-Regeln, weil aus der Industrie und auch aus der deutschen Politik Druck kommt. Bundeskanzler Friedrich Merz hat sich ausdrücklich für eine Entschlackung der europäischen KI-Regulierung ausgesprochen. Die Befürchtung: Wenn der Maschinenbau drei verschiedene EU-Verordnungen gleichzeitig erfüllen muss, leidet die Wettbewerbsfähigkeit.

Genau hier liegt die Crux. Für den CDU-Europaabgeordneten Axel Voss gehen diese Änderungen nicht weit genug — er warnt vor einem Flickenteppich aus Sonderregeln. Andere kritisieren, dass die Industrie bei den Wasserzeichen nun doch wieder Aufschub bekommt, während Opfer von digitaler Gewalt weiter warten.

Deutschland hängt hinterher

Ein bitterer Punkt: Auf nationaler Ebene gibt es bereits eine EU-Richtlinie, die manipulierte sexualisierte Darstellungen ohne Zustimmung unter Strafe stellen müsste. Sie ist seit Mai 2024 in Kraft. Deutschland hat sie bisher nicht in nationales Recht umgesetzt. Die Bundesrepublik hat noch bis Sommer 2026 Zeit. Justizministerin Stefanie Hubig hat Verschärfungen im Strafrecht angekündigt — wir warten.

Was du jetzt mitnehmen solltest

Drei Dinge bleiben hängen. Erstens: Die EU verschiebt die Verantwortung weg von den Tätern hin zu den Anbietern der Werkzeuge. Wer ein Modell baut, muss verhindern, dass damit Missbrauchsmaterial entsteht. Zweitens: Wasserzeichen kommen, aber später als geplant. Bis Ende 2026 musst du selbst entscheiden, was echt ist und was generiert. Drittens: Die angedrohten Strafen sind nicht symbolisch. 7 Prozent Weltumsatz zwingen jeden CEO, KI-Sicherheit ernst zu nehmen.

Was dabei auf der Strecke zu bleiben droht, ist die kleine, agile europäische KI-Szene. Während OpenAI eine ganze Compliance-Abteilung aufbauen kann, wird ein Berliner Start-up mit zehn Mitarbeitern jede Regel als existenzielle Frage erleben. Die Balance zu finden zwischen Schutz vor Missbrauch und Raum für Innovation — das wird die Aufgabe der nächsten zwölf Monate. Und die Uhr läuft.