Ein komplett erfundenes Interview mit Michael Schumacher zeigt 2026 eindrucksvoll: KI-generierte Fake-Inhalte sind längst in der Regenbogenpresse angekommen. Die Funke-Mediengruppe überschritt mit „Die Aktuelle“ alle Grenzen des Anstands.

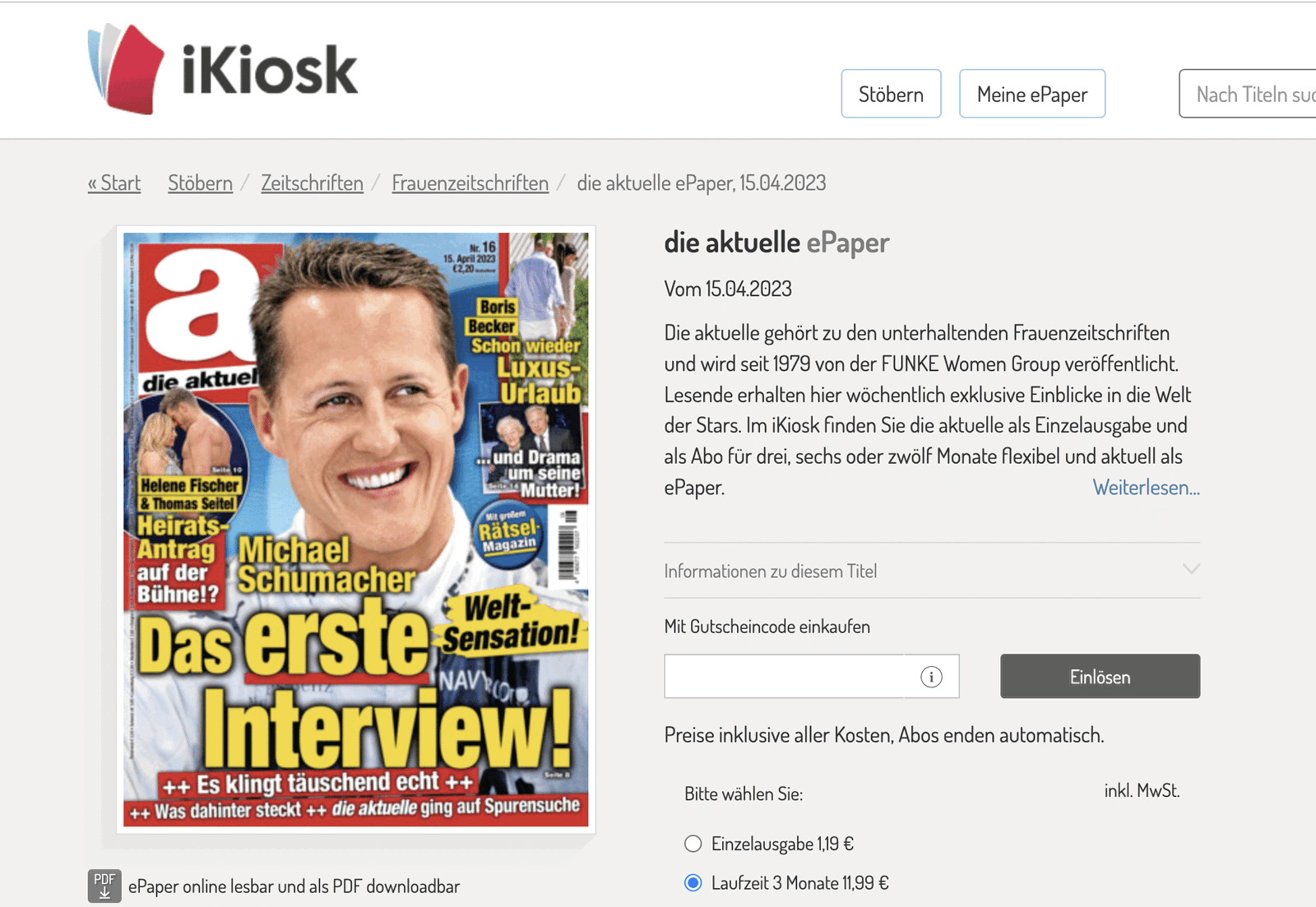

Erfundene Interviews, Clickbait und Sensationsgier gehören zum digitalen Alltag – doch wenn es um die Würde schwerkranker Menschen geht, sollten klare Grenzen existieren. Diese hat das Magazin „Die Aktuelle“ bereits 2023 spektakulär überschritten, als ein mittels KI künstlich erzeugtes Interview mit Formel-1-Legende Michael Schumacher veröffentlicht wurde. Drei Jahre später zeigen sich die weitreichenden Folgen dieses Skandals.

Das damals mit der Plattform character.ai erzeugte Fake-Interview war nur der Anfang einer problematischen Entwicklung. Seitdem haben sich KI-generierte Falschinhalte in der Medienlandschaft etabliert – mit verheerenden Konsequenzen für Betroffene und Medienkredibilität.

KI-Missbrauch in der Presse nimmt dramatisch zu

Seit 2024 beobachten Medienexperten eine explosive Zunahme KI-generierter Fake-Inhalte in traditionellen Medien. Moderne Tools wie GPT-4o, Claude 3.5 oder Gemini Ultra machen es erschreckend einfach, täuschend echte Interviews zu fabrizieren. Character.ai wurde mittlerweile von zahlreichen noch raffinierteren Plattformen abgelöst, die sogar Stimm- und Videoimitation beherrschen.

Als ehemaliger Weltmeister der Formel 1 dominierte Schumacher jahrelang die Motorsportwelt. Sein Skiunfall 2013 und die gesundheitlichen Folgen bleiben ein sensibles Thema. Die Familie kämpft seit über einem Jahrzehnt um Privatsphäre und Würde – ein Kampf, der durch KI-Technologie massiv erschwert wird.

Trotz zahlreicher Bitten um Diskretion nutzen skrupellose Akteure weiterhin modernste Technologie, um aus der Situation Profit zu schlagen. Das „Aktuelle“-Interview war nur der spektakulärste Fall einer ganzen Welle gefälschter Schumacher-Inhalte, die seitdem das Netz überschwemmen.

Wir müssen uns fragen: Was für ein perverses Spiel wird hier gespielt? Die Antwort bleibt dieselbe wie 2023: Sensationsgier und das unstillbare Verlangen nach Klicks und Auflage. Nur sind die Werkzeuge heute noch mächtiger und die Fälschungen noch überzeugender geworden.

Rechtliche Konsequenzen und neue Gesetze

Der Schumacher-Skandal hatte durchaus Konsequenzen: Die Familie erwirkte nicht nur erfolgreich Unterlassungsklagen, sondern auch Schadensersatz in Millionenhöhe. 2025 trat zudem das verschärfte „Digitale-Inhalte-Authentizitäts-Gesetz“ in Kraft, das KI-generierte Inhalte ohne deutliche Kennzeichnung unter Strafe stellt.

Dennoch reicht es nicht, sich nur über solche Machenschaften zu empören. Wir als Mediekonsumenten müssen aktiv werden. Das bedeutet: Verdächtige Inhalte nicht anklicken, nicht teilen, nicht kommentieren. Denn Aufmerksamkeit ist die Währung, mit der solche Fake-Fabriken bezahlt werden.

Auch Tech-Blogs und seriöse Medien müssen Verantwortung übernehmen. Statt dem nächsten Sensationsstück nachzujagen, sollten wir uns auf qualitativ hochwertige, verifizierte Inhalte konzentrieren. Der Kampf gegen Desinformation beginnt bei jedem einzelnen Redakteur.

Neue Technologien, alte Probleme

Die Technologie hinter solchen Fälschungen hat sich dramatisch weiterentwickelt. Was 2023 noch mit simplen Chatbots wie character.ai begann, funktioniert heute mit hochentwickelten „Deepfake-Personality-Engines“. Diese können nicht nur Texte, sondern auch Audioinhalte und Videos in Echtzeit generieren.

Plattformen wie „PersonaForge“ oder „VoiceClone Pro“ (beide fiktive Namen, aber repräsentativ für real existierende Tools) ermöglichen es praktisch jedem, überzeugende Fake-Interviews zu erstellen. Die Qualität ist so hoch, dass selbst Experten Schwierigkeiten haben, Fälschungen zu identifizieren.

Besonders perfide: Viele dieser Tools werben offen damit, „authentische Promi-Interviews“ zu generieren. Die Warnung „Everything is made up“ verschwindet dabei oft im Kleingedruckten oder wird ganz weggelassen.

Schutzmaßnahmen und Erkennungstools

Immmerhin: Parallel zur Fälschungstechnologie entwickeln sich auch Schutzmaßnahmen. Neue KI-Detektoren wie „TruthGuard“ oder „FakeSpotter“ können mit über 95%iger Genauigkeit künstlich generierte Inhalte identifizieren. Viele Browser integrieren solche Tools bereits automatisch.

Seriöse Medienunternehmen setzen mittlerweile auf „Content Verification Blockchain“ – eine Technologie, die jeden Artikel von der Recherche bis zur Veröffentlichung lückenlos dokumentiert. Echte Interviews werden mit kryptographischen Signaturen versehen, die eine nachträgliche Manipulation unmöglich machen.

Der Kampf um Medienkompetenz

Die Schumacher-Affäre war ein Wendepunkt: Sie führte zu verstärkten Bemühungen um Medienkompetenz in Schulen und Erwachsenenbildung. Programme wie „Digital Literacy 2025“ lehren, wie man Fake-Inhalte erkennt und verantwortungsvoll mit Informationen umgeht.

Wichtige Erkennungsmerkmale für KI-generierte Interviews sind heute:

– Übermäßig glatte, fehlerfreie Sprache

– Widersprüche zu bekannten Fakten

– Fehlende konkrete, überprüfbare Details

– Emotionale Sprache, die auf Sensationslust abzielt

– Fehlendes Impressum oder unklare Quellenlage

Die Zeit ist gekommen, dass wir uns als Gesellschaft gegen solche Praktiken stellen. Michael Schumachers Fall war ein mahnendes Beispiel – aber bei weitem nicht der letzte. Nur durch konsequente Aufklärung, rechtliche Verfolgung und bewussten Medienkonsum können wir diese Entwicklung stoppen.

Der Erkenntnisgewinn aus dem „Aktuelle“-Skandal: Nicht nur das Internet, auch traditionelle Medien sind anfällig für den Missbrauch neuer Technologien. Umso wichtiger ist es, wachsam zu bleiben und Qualitätsjournalismus zu unterstützen.

Zuletzt aktualisiert am 19.02.2026