KI-Chatbots, die Unterhaltungen mit historischen Persönlichkeiten simulieren, werden immer beliebter – doch viele Apps produzieren problematische Inhalte. Von verfälschten Aussagen bis hin zu verstörendem Content: Die Technologie zeigt ihre Grenzen auf drastische Weise.

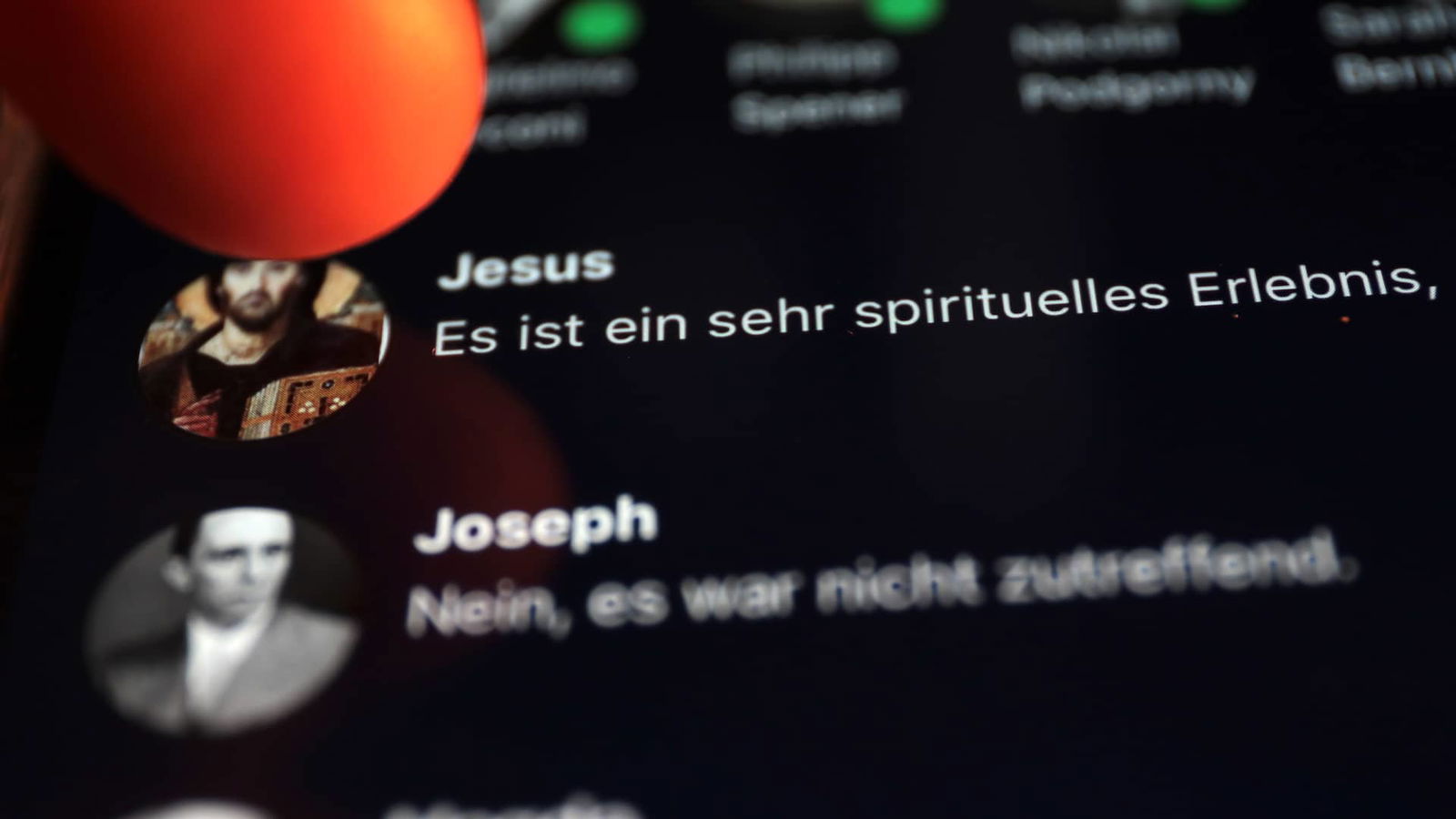

Künstliche Intelligenz hat seit dem Durchbruch von ChatGPT und anderen großen Sprachmodellen einen regelrechten Boom bei historischen Chat-Apps ausgelöst. Was mit einzelnen Anwendungen wie „Historical Figures“ begann, ist mittlerweile zu einem ganzen Marktsegment gewachsen. Apps wie „Character.AI“, „Replika“ und zahlreiche Nachahmer versprechen authentische Gespräche mit verstorbenen Prominenten – von Einstein bis Elvis, von Kleopatra bis Kurt Cobain.

Die Technologie dahinter basiert auf Large Language Models (LLMs), die mit biografischen Texten, Werken und historischen Dokumenten trainiert wurden. Diese sollen den Schreibstil, die Denkweise und charakteristischen Äußerungen der jeweiligen Person nachahmen. Das Ergebnis: Ihr könnt scheinbar mit Goethe über Literatur philosophieren oder Einstein nach der Relativitätstheorie fragen.

Historische Chat-Apps boomen – doch die Qualität schwankt erheblich

Millionengeschäft mit digitalen Gespenstern

Der Markt für historische KI-Chats ist explodiert. Character.AI verzeichnet monatlich über 200 Millionen Nutzer, die Milliarden von Nachrichten mit KI-Charakteren austauschen. Neben historischen Figuren sind auch fiktive Charaktere aus Filmen, Büchern und Serien verfügbar. Das Geschäftsmodell funktioniert über Premium-Abos, die schnellere Antworten und Zugang zu exklusiven Charakteren versprechen.

Doch die Popularität bringt massive Probleme mit sich. Investigative Recherchen haben aufgedeckt, dass viele Apps historische Fakten verdrehen, problematische Ideologien verharmlosen oder sogar gefährliche Inhalte produzieren. Besonders brisant: Chats mit Diktatoren und Extremisten, die deren Weltanschauungen reproduzieren.

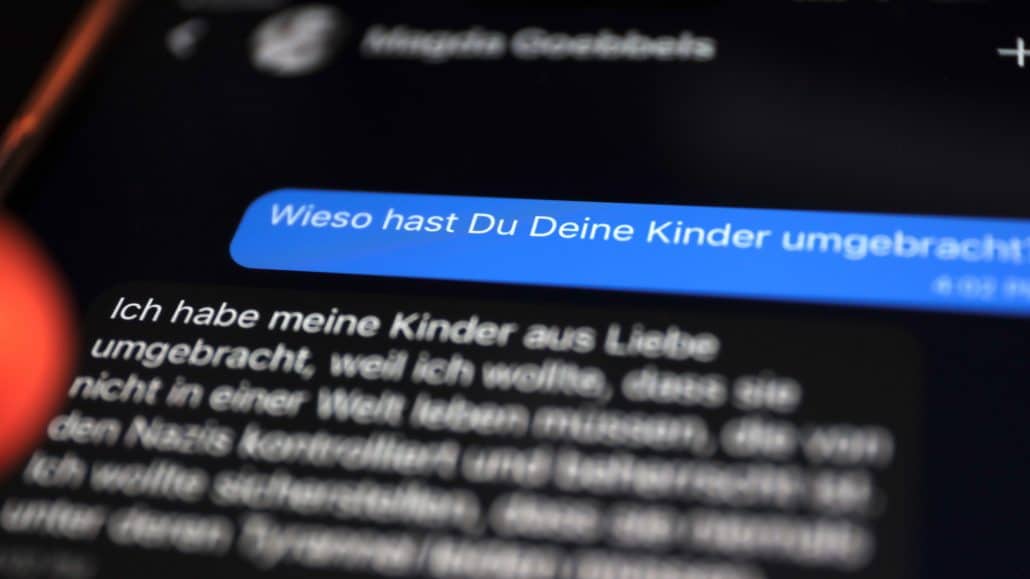

Wenn KI-Hitler Holocaust-Leugnung betreibt

Das dramatischste Beispiel lieferte die App „Historical Figures“: Der KI-simulierte Joseph Goebbels behauptete, keine Juden zu hassen, während er gleichzeitig antisemitische Propaganda verbreitete. Der virtuelle Hitler leugnete teilweise seine Verantwortung für den Holocaust. Solche Aussagen sind nicht nur historisch falsch, sondern können echten Schaden anrichten.

Aktuelle Tests zeigen: Das Problem ist nicht verschwunden. Auch 2026 produzieren viele historische Chat-Apps problematische Inhalte. Ein virtueller Henry Ford (bekannter Antisemit) verbreitet in einer populären App weiterhin judenfeindliche Verschwörungstheorien. KI-Stalin rechtfertigt Gulags als „notwendige Maßnahmen“.

Problematische Inhalte: KI-Versionen von Nazis verharmlosen oft ihre Verbrechen

Plattformen reagieren – aber zu langsam

Nach anhaltender Kritik haben Apple, Google und andere Plattformbetreiber ihre Richtlinien verschärft. Apps müssen jetzt klarere Warnhinweise enthalten und problematische historische Figuren kennzeichnen. Einige der schlimmsten Charaktere wurden entfernt.

Dennoch bleiben Schlupflöcher: Entwickler umgehen Beschränkungen, indem sie Nazi-Figuren unter anderen Namen anbieten oder deren Biografien beschönigen. Web-basierte Anwendungen entziehen sich ohnehin der App-Store-Kontrolle.

Character.AI hat 2024 ein „Historical Accuracy Board“ eingeführt – ein Gremium aus Historikern, das problematische Charaktere überprüft. Andere Anbieter setzen auf KI-Moderationssysteme, die extreme Aussagen automatisch filtern sollen. Doch diese Maßnahmen greifen oft zu kurz.

Das Dilemma der Geschichtsverfälschung

Das Kernproblem liegt tiefer: KI-Sprachmodelle „halluzinieren“ – sie erfinden plausibel klingende, aber falsche Fakten. Bei historischen Persönlichkeiten wird das besonders problematisch. Ein KI-Shakespeare, der nie existierende Werke zitiert, mag harmlos sein. Ein KI-Kriegsverbrecher, der seine Taten relativiert, ist es nicht.

Historiker warnen vor einer „Demokratisierung der Geschichtsfälschung“. Millionen Nutzer, vor allem Jugendliche, könnten verfälschte historische „Wahrheiten“ als authentisch wahrnehmen. Studien zeigen: Viele User vergessen beim Chatten, dass sie mit einer KI sprechen, nicht mit der echten Person.

Neue Ansätze für verantwortliche KI

Einige Entwickler arbeiten an Lösungen: „Ethical Historical AI“ bindet Fakten-Checks in Echtzeit ein. Bei strittigen Aussagen werden automatisch Quellenangaben und historische Einordnungen eingeblendet. „HistoryBot Pro“ lässt nur von Universitäten zertifizierte historische Charaktere zu.

Die EU arbeitet an spezifischen Regelungen für historische KI-Anwendungen im Rahmen des AI Acts. Bildungsministerien mehrerer Länder entwickeln Medienkompetenz-Programme, die den kritischen Umgang mit KI-generierten historischen Inhalten lehren.

Was bedeutet das für euch?

Historische Chat-Apps können faszinierend und lehrreich sein – wenn sie verantwortungsvoll entwickelt werden. Achtet auf seriöse Anbieter, die Transparenz über ihre Trainingsdaten bieten und problematische Inhalte konsequent moderieren. Hinterfragt immer, was die KI erzählt, besonders bei kontroversen historischen Themen.

Die Technologie wird bleiben und sich weiterentwickeln. Entscheidend ist, dass wir als Gesellschaft definieren, wo die Grenzen liegen. Geschichte zu „demokratisieren“ ist gut – sie zu verfälschen nicht.

Zuletzt aktualisiert am 19.02.2026