Nach welchen Regeln sollen Meta/Facebook und andere Plattformen Inhalte blockieren und löschen? Manchmal wird zu wenig moderiert, manchmal zu viel. Einfach ist die Aufgabe ganz sicher nicht – was daran liegt, dass soziale Netzwerke Plattform und Medium zugleich sind. Metas „Oversight Board“ sollte für mehr Transparenz sorgen. Funktioniert das nach fünf Jahren?

Man kann Facebook überflüssig finden, genial, banal, schädlich – aber eins steht fest: Einfach ist es nicht, eine globale Social-Media-Plattform zu betreiben. Vor allem wenn es darum geht, schädliche von nützlichen, echte von falschen oder legitime von illegalen Inhalten zu unterscheiden. Denn überall in der Welt herrschen andere Regeln und Gesetze. Milliarden Nutzer können täglich alles hochladen.

Ganz zu schweigen davon, dass sich mit KI-generierten Deepfakes heute noch schwerer klären lässt, was manipuliert wurde – oder ob ein Foto oder Video echt ist.

Meta ist ein Medium – und trägt Verantwortung

Doch auch wenn es schwierig ist: Das entlässt Meta nicht aus der Verantwortung. Immer wieder betont das Unternehmen, nur eine Plattform zu sein. Was Unsinn ist: Natürlich ist Facebook – auch! – ein Medium. Laut Definition ist ein Medium „eine Einrichtung, organisatorischer und technischer Apparat für die Vermittlung von Meinungen, Informationen, Kulturgütern“. Das trifft auf Meta-Plattformen ohne Abstriche zu.

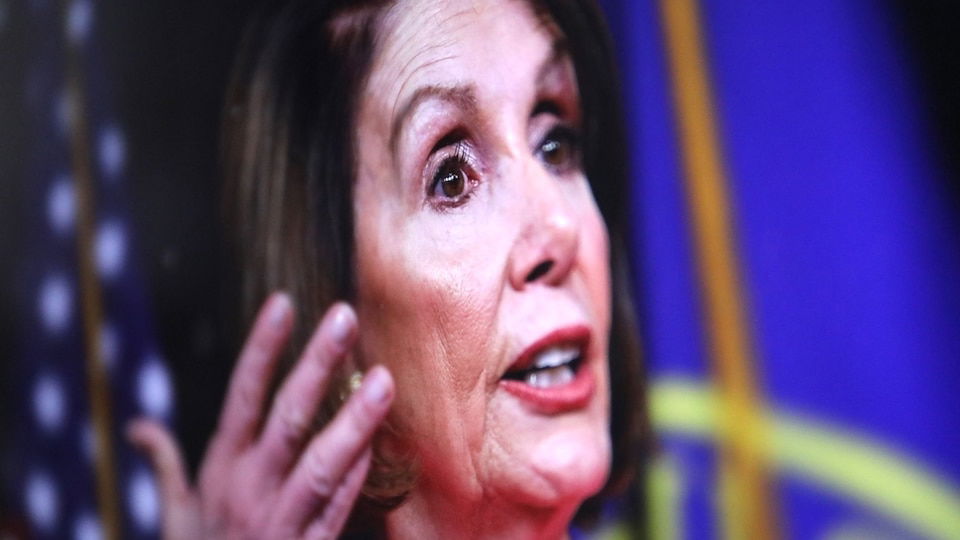

Die Herausforderungen sind dabei in den letzten Jahren massiv gestiegen: Während 2019 noch hauptsächlich manipulierte Videos wie das berüchtigte Nancy-Pelosi-Video für Aufsehen sorgten, kämpfen Plattformen heute gegen hochrealistische KI-generierte Inhalte, koordinierte Desinformationskampagnen und die rasante Verbreitung von Fake News durch Algorithmen.

Das „Oberste Gericht“ für die Meta-Welt: Fünf Jahre später

Seit 2020 gibt es das „Oversight Board“ – eine Art „Oberstes Gericht“ für das Meta-Imperium. Die Moderatoren haben etwas gelöscht, was sie nicht löschen sollen? Oder fragwürdige Inhalte wurden nicht schnell genug entfernt? Betroffene können das Oversight Board anrufen.

Mittlerweile arbeiten rund 20 internationale Experten in dem Gremium – Juristen, Menschenrechtsaktivisten, Journalisten und Akademiker aus verschiedenen Kontinenten. Keine mit Meta-Vergangenheit und keine aktiven Politiker. Das Gremium kann bindende Entscheidungen für einzelne Inhalte fällen und Empfehlungen für Richtlinienänderungen aussprechen.

Erfolge und Grenzen des Oversight Boards

Die Bilanz nach fünf Jahren ist gemischt: Einerseits hat das Board wichtige Präzedenzfälle geschaffen – etwa bei der Behandlung von politischen Äußerungen, religiösen Inhalten oder der Moderation in Krisenzeiten. Die Entscheidung zur Suspendierung von Donald Trumps Accounts nach dem 6. Januar 2021 sorgte weltweit für Aufmerksamkeit.

Andererseits sind die Kapazitäten begrenzt: Von Millionen von Beschwerden werden nur wenige hundert Fälle pro Jahr behandelt. Die meisten Moderationsentscheidungen fallen weiterhin automatisiert durch KI-Systeme oder schlecht bezahlte Moderatoren in Drittländern.

KI verändert das Spiel

Generative KI hat die Content-Moderation revolutioniert – in beide Richtungen. Einerseits können KI-Tools heute besser Hassrede, Spam oder manipulierte Inhalte erkennen. Andererseits wird es durch Tools wie ChatGPT, Midjourney oder Sora immer einfacher, täuschend echte Fake-Inhalte zu erstellen.

Meta setzt daher verstärkt auf KI-basierte Erkennungssysteme und arbeitet an einer Art „Wasserzeichen“ für KI-generierte Inhalte. Doch das Wettrüsten zwischen Erstellung und Erkennung von Fake-Content geht weiter.

Der Weg nach vorn

Das Oversight Board war ein wichtiger erster Schritt, kann aber nicht die Lösung aller Probleme sein. Inzwischen haben auch andere Plattformen wie YouTube, TikTok oder X (ehemals Twitter) eigene Moderationsgremien oder externe Beratungsstrukturen eingeführt.

Wichtiger ist jedoch: Die Politik muss endlich handeln. Der Digital Services Act der EU ist ein Anfang, aber längst nicht ausreichend. Es braucht klare, global abgestimmte Regeln für Plattform-Verantwortung, Transparenz bei Algorithmen und den Umgang mit KI-generierten Inhalten.

Das darf nicht allein privaten „Obersten Gerichten“ überlassen werden – so gut gemeint sie auch sein mögen. Am Ende geht es um demokratische Meinungsbildung und Informationsfreiheit. Das ist zu wichtig, um es Konzernen zu überlassen.

Die Herausforderungen der Content-Moderation werden durch KI noch komplexer

Zuletzt aktualisiert am 04.03.2026