Wir kennen das alle: Eine Frage, schnell gegoogelt – und schon steht die Antwort da. Nicht mehr als Liste von blauen Links, sondern als fertige Zusammenfassung, generiert von künstlicher Intelligenz. Google nennt das Feature „KI-Zusammenfassungen“ und rollt es gerade weltweit aus. Klingt praktisch. Ist es auch. Aber genau diese Bequemlichkeit könnte unser Informationssystem ins Mark treffen.

Die Organisation AlgorithmWatch schlägt jetzt Alarm. Sie hat bei der Bundesnetzagentur Beschwerde gegen Google eingereicht. Der Vorwurf: Die KI-Zusammenfassungen sind ein „Traffic Killer“ für unabhängige Medien und gefährden die Meinungsfreiheit. Was dramatisch klingt, hat einen sehr realen Hintergrund.

Wie funktionieren die KI-Zusammenfassungen?

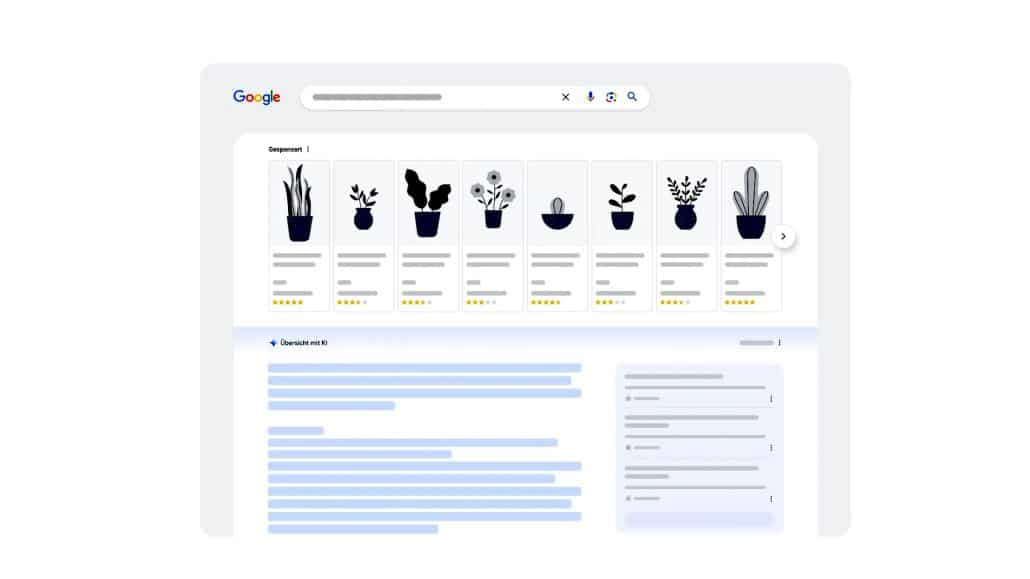

Das Prinzip ist einfach: Ihr sucht nach etwas – sagen wir „Wie funktioniert Photosynthese?“ – und bekommt sofort eine KI-generierte Antwort präsentiert. Die künstliche Intelligenz durchforstet verschiedene Quellen, fasst die Informationen zusammen und serviert euch das Ergebnis auf dem Silbertablett. Erst darunter erscheinen die klassischen Suchergebnisse mit Links zu Websites.

Für uns Nutzer bedeutet das: Weniger Klicks, weniger Leseaufwand, schneller zur Information. Google verkauft das als Service, als nächsten logischen Schritt der Suchmaschine. Doch hinter diesem Service steckt ein fundamentales Problem.

Der Traffic bricht ein

Zeitungen, Magazine, Blogs und andere Medien leben von Besuchern. Sie investieren Zeit und Geld in Recherche, schreiben Artikel, pflegen ihre Websites – und finanzieren das über Werbung oder Abos. Aber was passiert, wenn niemand mehr ihre Seiten besucht, weil Google die Informationen schon direkt in der Suche präsentiert?

Genau das beobachten wir gerade. Unabhängige Berichte zeigen: Der Traffic zu vielen Websites sinkt erheblich. Manche Medien sprechen von zweistelligen Prozentverlusten bei den Besucherzahlen. Und das ist erst der Anfang – die KI-Zusammenfassungen werden gerade erst flächendeckend eingeführt.

Das Problem: Google hält sich mit konkreten Zahlen bedeckt. Das Unternehmen behauptet zwar, die Risiken untersucht zu haben, wie es der Digital Services Act der EU vorschreibt. Aber Details gibt es nicht. Keine Transparenz darüber, wie viele Menschen nach einer KI-Zusammenfassung noch auf die Originalquellen klicken.

AlgorithmWatch fordert Transparenz

Genau hier setzt AlgorithmWatch an. Die NGO fordert von Google interne Daten: Wie viele Nutzer klicken noch auf Websites, nachdem sie eine KI-Zusammenfassung gesehen haben? Wie stark sinkt der Traffic tatsächlich? Welche Websites sind besonders betroffen?

Dr. Oliver Marsh, Head of Tech Research bei AlgorithmWatch, formuliert die Kernfrage sehr deutlich: „Was wird Journalismus und verlässliche Informationen ersetzen? Ein fehleranfälliges, intransparentes KI-Tool?“ Denn die KI-Zusammenfassungen sind alles andere als perfekt. Sie machen Fehler, halluzinieren manchmal, ziehen falsche Schlüsse aus ihren Quellen.

Neue Waffe: EU-Datenzugangsregeln

Das Besondere an dieser Beschwerde: AlgorithmWatch nutzt brandneue EU-Regelungen, die gerade erst in Kraft getreten sind. Seit dem 30. Oktober 2025 können akkreditierte Forschungsorganisationen bei nationalen Regulierungsbehörden Zugang zu internen Daten großer Tech-Plattformen beantragen.

Das ist ein echter Durchbruch. Bisher konnten Forscher nur öffentlich zugängliche Daten nutzen. Die Unternehmen sagten dann gerne: „Vertraut uns doch, wir haben alles im Griff.“ Jetzt können unabhängige Organisationen erstmals selbst in die Systeme schauen – natürlich unter strengen Auflagen.

Die Bedingung: Es muss um sogenannte systemische Risiken gehen. Also Gefahren für die Meinungsfreiheit, die Informationslandschaft, Wahlprozesse oder andere im Digital Services Act definierte Risiken. Der Fall Google AI Overviews erfüllt diese Bedingungen perfekt.

Wenn Google die Daten verweigert – etwa mit Verweis auf Geschäftsgeheimnisse – kann die Bundesnetzagentur vermitteln und eine Lösung finden. Das ist ein echter Machtzuwachs für die Forschung.

Ein systemisches Risiko für die Demokratie

Warum ist das alles so wichtig? Weil es um weit mehr geht als um ein paar Prozentpunkte Traffic. Es geht um die Grundlagen unserer Informationsgesellschaft.

Stellt euch vor: Zeitungen und Online-Medien verlieren massiv Leser. Ihre Einnahmen brechen weg. Sie können nicht mehr in aufwendige Recherchen investieren, nicht mehr kritisch berichten, nicht mehr investigativ arbeiten. Was bleibt? Oberflächliche Berichterstattung, weniger Vielfalt, weniger Kontrolle der Mächtigen.

Gleichzeitig machen wir uns abhängig von einem einzigen KI-System, das uns die Welt erklärt. Ein System, das intransparent arbeitet, dessen Fehlerquellen wir nicht kennen, das wir nicht kontrollieren können. Ein System, das entscheidet, welche Informationen es für relevant hält und welche nicht.

Das ist demokratiepolitisch hochproblematisch. Unsere Demokratie lebt von einer vielfältigen, unabhängigen Medienlandschaft. Von verschiedenen Perspektiven, von kritischem Journalismus, von Faktencheck und Einordnung. All das gefährden wir, wenn wir uns auf KI-Zusammenfassungen einer einzelnen Firma verlassen.

Was jetzt passieren muss

Die Lösung ist nicht einfach. Niemand will zurück in die Steinzeit des Internets. KI-Tools können nützlich sein, können uns helfen, Informationen besser zu verstehen und zu verarbeiten.

Aber wir brauchen Regeln und Transparenz. Erstens müssen wir wissen, welchen Einfluss diese KI-Zusammenfassungen wirklich haben. Deshalb ist die Datenanfrage von AlgorithmWatch so wichtig. Zweitens brauchen wir faire Vergütungsmodelle. Wenn Google Inhalte von Medien nutzt, müssen diese dafür entlohnt werden – ähnlich wie beim Leistungsschutzrecht.

Drittens brauchen wir klare Kennzeichnungen. Nutzer müssen verstehen, dass sie eine KI-Zusammenfassung lesen – mit all ihren Fehlermöglichkeiten. Und sie müssen einfachen Zugang zu den Originalquellen haben.

Der Fall zeigt aber auch: Die neuen EU-Regeln zum Datenzugang funktionieren. Das ist eine Premiere. Forscher können endlich hinter die Kulissen der Tech-Giganten schauen. Das ist ein wichtiger Schritt für mehr Transparenz im digitalen Raum.

Wir stehen an einem Scheideweg. Auf der einen Seite lockt die Bequemlichkeit schneller KI-Antworten. Auf der anderen Seite steht die Vielfalt unserer Informationslandschaft. Es liegt an uns – und an den Regulierungsbehörden –, den richtigen Weg zu finden. Einen Weg, der Innovation ermöglicht, aber die Grundlagen unserer demokratischen Informationsgesellschaft nicht opfert.