Viele private Nutzer, aber auch kleine und mittlere Unternehmen setzen in Sachen Datensicherung auf das Prinzip Hoffnung. Sie sind der Meinung, dass es reicht, überhaupt eine Backup-Strategie zu fahren. Dabei greifen sie gerne auf Network Attached Storages (NAS) als Datensicherung zurück. Warum es fatal werden kann, wenn dies das einzige Backup ist – und wie ihr euch 2026 richtig absichert.

Datenverlust ist eine Gefahr, die vor allem für Unternehmen eine große Herausforderung darstellt, denn meist bedeutet das nicht nur Ärger und zeitlichen Aufwand, sondern auch große finanzielle Schäden. Mehr als 150 Milliarden Euro Schaden jährlich entstehen Firmen inzwischen durch Sabotage, Datendiebstahl oder Spionage, wie der Digitalverband Bitkom in aktuellen Studien ermittelt hat. Die Schadenssumme ist in den letzten Jahren kontinuierlich gestiegen – nicht zuletzt durch die Zunahme von KI-gestützten Cyberangriffen und raffinierteren Ransomware-Varianten.

Backups sind mittlerweile jedem Computer-Nutzer ein Begriff. Doch das alleine reicht nicht. Die korrekte Funktion des Backups sollte regelmäßig überprüft werden, zudem sollte eine Datensicherung immer aktuell und vollständig sein. Kommt es dennoch zu einem Verlust wichtiger und sensibler Daten, solltet ihr einen zuverlässigen und erfahrenen Datenretter beauftragen, wie etwa die Datenrettung von QNAP Systemen.

Was sind die Ursachen für Datenverluste trotz Backup?

Peter Böhret, Managing Director bei Kroll Ontrack, beklagt vor allem unzureichende Richtlinien in Unternehmen. Ist beispielsweise ein Gerät nicht in den Backup-Protokollen erfasst, können dessen Daten auch nicht automatisch gesichert werden. Ebenso verheerend kann es ihm zufolge für Unternehmen sein, wenn ein Defekt im Sicherungssystem unentdeckt bleibt und erst ans Licht kommt, wenn man auf das Backup angewiesen ist.

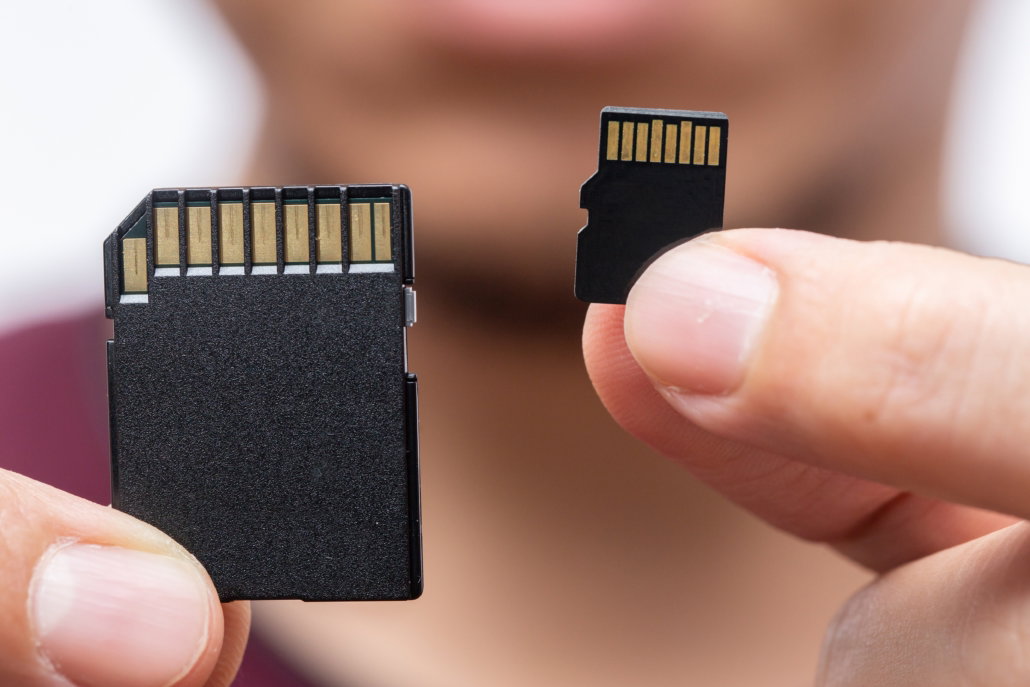

Ein großes Problem ist, dass viele User auf NAS als einzige Datensicherung setzen. Dabei handelt es sich um einen konfigurierbaren Datenspeicher, um in einem Netzwerk Speicherplatz zur Verfügung zu stellen. Bei NAS sind die Festplatten nicht an einen Server gebunden, sondern werden als eine eigenständige Einheit gesehen. Der Zugriff wird nicht zentral, sondern innerhalb des NAS geregelt.

Doch 2026 ist das Problem noch vielschichtiger geworden: KI-gestützte Ransomware wie die neuen Varianten von BlackCat oder LockBit analysieren inzwischen gezielt Backup-Strategien und greifen diese systematisch an. Diese intelligenten Schadprogramme können sogar zeitverzögert agieren und warten ab, bis Backup-Zyklen durchlaufen sind, bevor sie zuschlagen.

Eine mögliche Erklärung für Datenverluste trotz Backup ist dessen System: Wenn nicht alle Endgeräte darin eingebunden sind, können Daten auf diesem Weg verloren gehen. Besonders kritisch sind heute Cloud-basierte Arbeitsplätze und hybride Umgebungen, wo Daten zwischen lokalen Systemen, Cloud-Diensten und Edge-Geräten synchronisiert werden.

Eine große Gefahr ist nach wie vor Ransomware, die nicht nur lokale Daten des infizierten Computers verschlüsselt, sondern gleichzeitig angeschlossene USB-Medien und verbundene Netzlaufwerke. Dadurch ist Ransomware auch für NAS-Systeme extrem gefährlich, ohne dass das NAS selbst mit Ransomware infiziert ist.

Moderne Schutzmaßnahmen: Die 3-2-1-1-0 Regel

Die klassische 3-2-1 Backup-Regel (3 Kopien, 2 verschiedene Medientypen, 1 Offsite-Backup) wurde inzwischen zur 3-2-1-1-0 Regel erweitert:

- 3 Kopien eurer Daten

- 2 verschiedene Speichermedien

- 1 Offsite-Backup (am besten in der Cloud)

- 1 Offline-/Air-Gap-Backup (physisch getrennt)

- 0 Fehler bei der Wiederherstellung (regelmäßige Tests!)

Synology und QNAP, die beiden Marktführer bei NAS-Systemen, haben ihre Sicherheitsfeatures 2025/2026 massiv ausgebaut. Synology Active Backup Suite bietet jetzt KI-basierte Anomalieerkennung, während QNAP mit QuTS hero und seinem ZFS-Dateisystem Snapshots anbietet, die selbst bei Ransomware-Angriffen schützen können.

Was tun für gute Ergebnisse beim Backup

Experten empfehlen folgende Maßnahmen, um beim Backup optimale Ergebnisse zu erzielen:

- Investiert in eine professionelle Backup-Lösung mit Zero Trust-Architektur und erstellt einen Sicherungsplan für alle Geräte – inklusive IoT-Devices und Smart Home-Komponenten.

- Führt mindestens alle 6 Stunden eine inkrementelle Datensicherung durch, bei kritischen Systemen sogar kontinuierlich (Continuous Data Protection).

- Nutzt Software mit automatischen Erfolgsberichten per E-Mail oder Webhook und implementiert Monitoring-Tools wie Prometheus oder Grafana.

- Bindet mobile Endgeräte, Cloud-Workloads und Container-Umgebungen in die Backup-Routine ein.

- Implementiert Immutable Backups – diese können nachträglich nicht verändert oder gelöscht werden, selbst nicht von Administratoren.

- Testet eure Backups regelmäßig mit automatisierten Recovery-Tests und dokumentiert die Recovery Time Objectives (RTO).

Cloud-Backup als zusätzliche Absicherung

Reine NAS-Lösungen reichen 2026 nicht mehr aus. Cloud-Backup-Services wie AWS S3 Glacier Deep Archive, Microsoft Azure Backup oder spezialisierte Anbieter wie Backblaze bieten zusätzliche Sicherheit. Viele moderne Lösungen nutzen Client-Side-Verschlüsselung und Zero-Knowledge-Architekturen – selbst der Anbieter kann eure Daten nicht einsehen.

Wichtig ist dabei die Auswahl des richtigen Cloud-Anbieters: Achtet auf DSGVO-Konformität, Zertifizierungen wie ISO 27001 und transparente Sicherheitspraktiken. Services wie Acronis Cyber Backup oder Veeam Backup & Replication bieten inzwischen KI-gestützte Anomalieerkennung, die verdächtige Aktivitäten automatisch meldet.

Gehen Daten trotzdem verloren, wendet euch direkt an einen professionellen Datenretter. Moderne Datenrettungsunternehmen arbeiten inzwischen auch mit KI-Tools, um auch bei komplexen Verschlüsselungsangriffen oder Hardware-Schäden noch Daten retten zu können.

Zuletzt aktualisiert am 27.02.2026