Strom kommt aus der Steckdose – und KI kommt aus dem Netz. Mehr muss man doch eigentlich nicht wissen, oder? Von wegen! Während wir uns längst daran gewöhnt haben, dass ChatGPT, Claude oder Gemini unsere Fragen beantworten, Bilder generieren oder Code schreiben, verschließen wir die Augen vor der Realität: KI verschlingt Unmengen an Energie. Und das Problem wird dramatisch größer.

2026 stehen wir nicht mehr am Anfang der KI-Revolution – wir sind mittendrin. Jeden Tag kommen neue Modelle auf den Markt, werden KI-Features in bestehende Software integriert. Doch die Rechnung für diesen digitalen Fortschritt ist heftiger als gedacht.

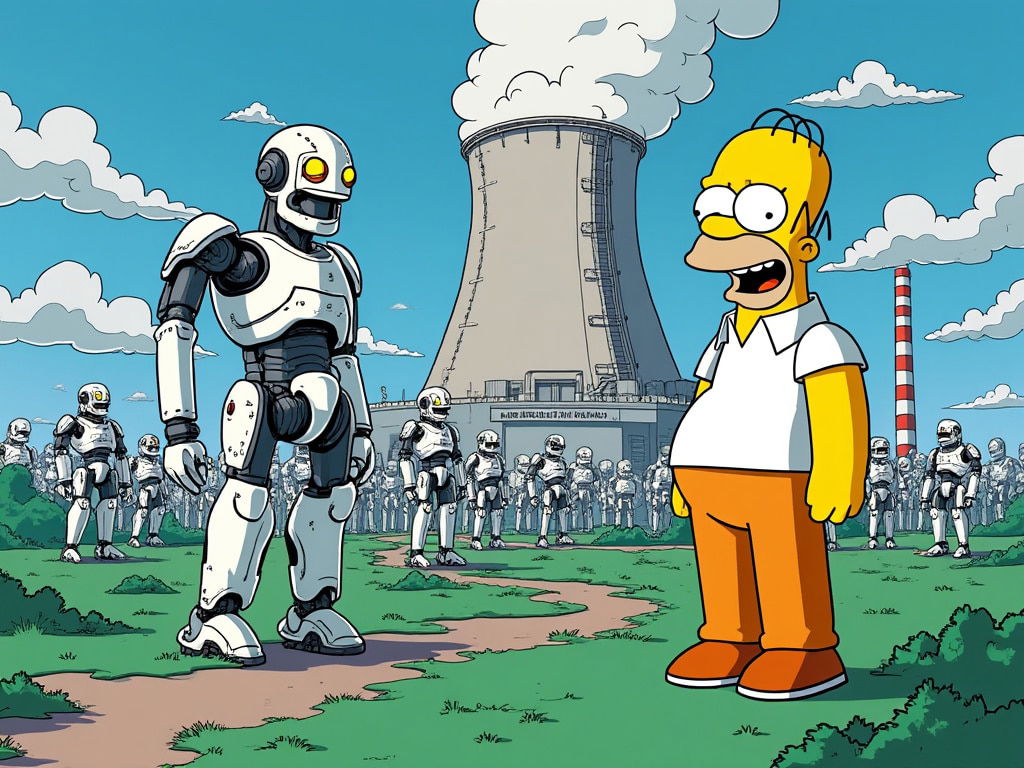

Dass es nicht nur viel, sondern absurd viel Energie sein muss, zeigen die Pläne der Tech-Giganten: Google hat bereits 2024 angekündigt, eigene modulare Atomkraftwerke zu nutzen – ausschließlich für KI. Microsoft reaktiviert stillgelegte AKWs, Amazon investiert Milliarden in nukleare Energie. Der Grund ist simpel: Das normale Stromnetz kann den KI-Hunger nicht mehr stillen.

KI frisst Strom wie ein Moloch

Die Zahlen sind ernüchternd: Eine einzige ChatGPT-Anfrage verbraucht 10 bis 300 Mal mehr Energie als eine Google-Suche – je nach Komplexität. Das Training von GPT-4 verschlang geschätzt 50 Gigawattstunden Strom, genug für 5000 deutsche Haushalte ein ganzes Jahr lang. Und das war nur das Training – der laufende Betrieb kommt noch dazu.

Aktuelle Studien zeigen: Der globale Energieverbrauch für KI könnte bis 2030 das Niveau ganzer Länder wie Argentinien erreichen. Allein OpenAI verbraucht täglich schätzungsweise 700.000 Kilowattstunden nur für ChatGPT – Tendenz stark steigend, seit immer mehr Menschen und Unternehmen KI täglich nutzen.

Das liegt an der Funktionsweise: Moderne KI-Modelle wie GPT-4, Claude 3 oder Googles Gemini Ultra laufen auf gewaltigen Clustern mit Tausenden von spezialisierten Chips (GPUs und TPUs). Diese Prozessoren sind extrem stromhungrig und müssen permanent gekühlt werden – ein doppelter Energieschlag.

Tech-Giganten bauen eigene Kraftwerke

Google macht Ernst: Ab 2030 bezieht der Konzern Strom von kleinen modularen Reaktoren des Anbieters Kairos Power. Bis 2035 sollen es 500 Megawatt werden – genug für 400.000 Haushalte. Sechs bis sieben Kraftwerke sind geplant, teilweise direkt an Rechenzentren gekoppelt.

Doch Google ist nicht allein: Microsoft hat einen 20-Jahre-Vertrag mit Constellation Energy geschlossen und reaktiviert das stillgelegte AKW Three Mile Island. Amazon investierte 2024 über 500 Millionen Dollar in kleine Nuklearreaktoren. Meta prüft ähnliche Schritte. Der Grund ist überall derselbe: normaler Netzstrom reicht nicht mehr.

Besonders brisant: Diese Kraftwerke werden oft exklusiv für KI gebaut. Während normale Verbraucher über Strompreise stöhnen, sichern sich Tech-Konzerne ihre eigene Energieversorgung. Ein Zweiklassen-Stromsystem entsteht.

Warum nicht Solar und Wind?

Die Antwort ist simpel: KI-Rechenzentren brauchen Strom rund um die Uhr, 365 Tage im Jahr, in konstant hohen Mengen. Wenn ChatGPT oder Claude eine Sekunde lang nicht antworten, wechseln die Nutzer zum Konkurrenten. Diese „Grundlast“ können erneuerbare Energien allein nicht liefern.

Hinzu kommt der Platzmangel: Um ein einziges großes KI-Rechenzentrum vollständig mit Solarstrom zu versorgen, bräuchte man Photovoltaik-Flächen in der Größe kleiner Städte. In dicht besiedelten Gebieten schlicht unmöglich.

Trotzdem investieren die Konzerne parallel in erneuerbare Energien: Google hat über 10 Gigawatt an Solar- und Windprojekten finanziert, Microsoft will bis 2030 klimaneutral werden. Doch für KI reicht das nicht – daher die Atomkraft als „saubere Grundlast“.

Deutschland hinkt hinterher

Während die USA auf nukleare KI-Energie setzen, steht Deutschland vor einem Dilemma: Nach dem Atomausstieg 2023 fehlen Grundlastkraftwerke. Deutsche KI-Startups wie Aleph Alpha oder europäische Anbieter wie Mistral AI sind auf Strom aus dem Mix angewiesen – oft mit hohem Kohleanteil.

Das wird zum Standortnachteil: Während US-Konzerne ihre KI mit „sauberer“ Atomkraft betreiben, müssen europäische Anbieter mit schlechteren CO2-Bilanzen leben oder teure Kompensationen kaufen. Ein strategisches Problem für Europas KI-Ambitionen.

Was bedeutet das für uns?

Erstens: KI ist nicht kostenlos, auch wenn sie oft gratis aussieht. Jede ChatGPT-Frage, jedes DALL-E-Bild, jede KI-Übersetzung kostet echte Energie. Wir sollten bewusster entscheiden, wann wir KI nutzen und wann eine einfache Google-Suche reicht.

Zweitens: Transparenz muss her. Anbieter sollten den Energieverbrauch ihrer KI-Services offenlegen, damit wir informierte Entscheidungen treffen können. Erste Ansätze gibt es bereits – etwa Hugging Face, die den CO2-Fußabdruck ihrer Modelle ausweisen.

Drittens: Die Politik ist gefordert. Es kann nicht sein, dass sich Konzerne ihre private Energieversorgung bauen, während normale Verbraucher die Kosten der Energiewende tragen. Wir brauchen Regeln für den KI-Energieverbrauch und faire Kostenverteilung.

Die KI-Revolution ist nicht aufzuhalten – aber sie darf nicht auf Kosten unserer Energiezukunft gehen. Es wird Zeit, dass wir als Gesellschaft ehrlich über die wahren Kosten der künstlichen Intelligenz sprechen. Bevor uns die Rechnung über den Kopf wächst.

Zuletzt aktualisiert am 16.02.2026