Der gesellschaftliche und politische Druck auf Social-Media-Plattformen wächst kontinuierlich. Meta hat seine Jugendschutz-Maßnahmen bei Instagram deutlich ausgebaut – mit KI-gestützten Nacktbild-Filtern, erweiterten Sextortion-Schutz und neuen Präventionstools, die bereits weltweit aktiv sind.

Instagram bleibt eine der dominierenden Social-Media-Plattformen, besonders bei der Generation Z und den Millennials. Doch die Schattenseiten werden immer deutlicher sichtbar – und die Plattform hat in den letzten zwei Jahren massive Änderungen vorgenommen, um den wachsenden Anforderungen beim Jugendschutz gerecht zu werden.

Neue Dimension der digitalen Bedrohung

Die Bedrohungslage hat sich seit 2024 drastisch verschärft. **Deepfake-Pornografie** ist zu einem massiven Problem geworden – KI-generierte Nacktbilder von Minderjährigen werden gezielt zur Erpressung eingesetzt. **AI-Sextortion** nutzt mittlerweile maschinelles Lernen, um gezielt vulnerable Jugendliche zu identifizieren und anzusprechen.

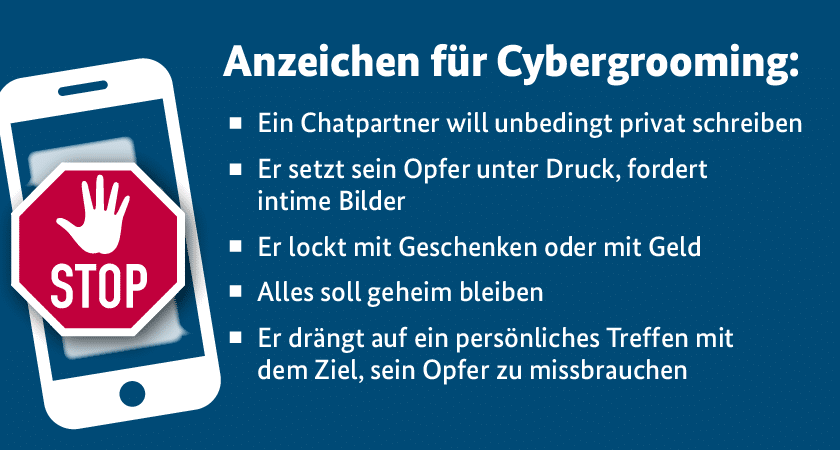

Die klassischen Probleme von **Sextortion**, **Sexting** und **Cybergrooming** haben durch KI-Tools eine neue Dimension erreicht. Täter können mittlerweile binnen Minuten überzeugende Fake-Profile erstellen, Gespräche automatisieren und psychologisch manipulative Nachrichten in Echtzeit generieren lassen.

Sextortion – die Erpressung mit intimen Aufnahmen – funktioniert heute oft ohne dass Opfer jemals echte Bilder geteilt haben. Deepfake-Technologie macht es möglich, aus harmlosen Social-Media-Fotos kompromittierende Inhalte zu erstellen.

Beim Sexting entstehen heute neue Risiken durch **Non-Consensual AI Enhancement** – das unerwünschte „Verbessern“ geteilter Bilder durch KI. Cybergrooming wird durch **Behavioral AI** effizienter: Algorithmen analysieren Nutzerverhalten und optimieren Ansprache-Strategien in Echtzeit.

Instagram wurde zum Hauptschauplatz dieser Entwicklungen, da die Plattform besonders bei der jungen Zielgruppe beliebt ist und visuelle Inhalte im Fokus stehen.

Metas umfassende Schutz-Offensive

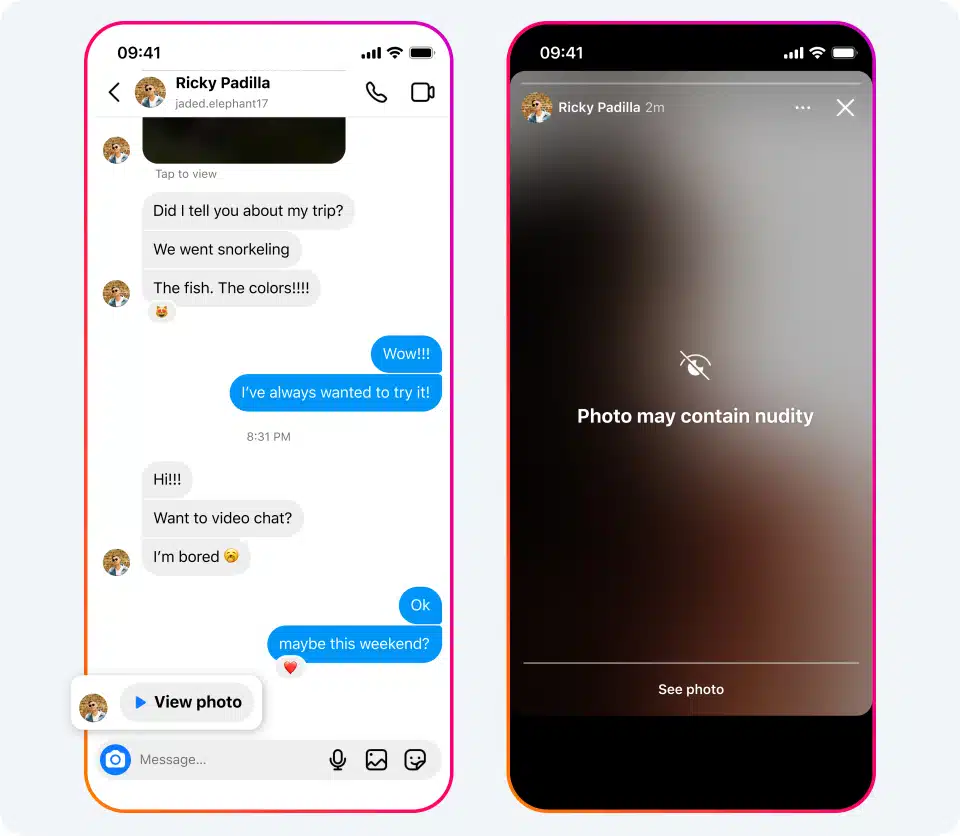

Meta hat seit 2024 ein ganzes Arsenal neuer Schutzmaßnahmen implementiert. Der **Advanced Nudity Protection Filter** ist mittlerweile global aktiv und wurde erheblich verfeinert. Das System erkennt nicht nur klassische Nacktheit, sondern auch suggestive Posen, Unterwäsche-Aufnahmen und **AI-generierte NSFW-Inhalte**.

Der **Proactive Sextortion Shield** überwacht Kommunikationsmuster und schlägt bei verdächtigen Verhaltensweisen Alarm – etwa wenn jemand nach persönlichen Daten fragt, Geschenke anbietet oder zu schnell auf private Kommunikation drängt.

**Unschärfefilter werden intelligent angepasst**

Die Blur-Technologie funktioniert heute deutlich sophistierter. **Smart Blur** passt sich dem Risikolevel an: Bei minderjährigen Nutzern werden auch grenzwertige Inhalte automatisch unscharf gestellt. **Contextual Analysis** berücksichtigt die Beziehung zwischen Sender und Empfänger sowie deren Interaktionshistorie.

Besonders innovativ: Der **Empathy Prompt**, der vor dem Versenden potenziell verletzender Inhalte aktiviert wird. „Könnte diese Nachricht jemanden verletzen oder in Bedrängnis bringen?“ – solche Fragen haben nachweislich die Anzahl problematischer Posts reduziert.

Erweiterte KI-Erkennung und Präventionstools

Die **On-Device AI** wurde massive ausgebaut. **Multi-Modal Content Analysis** prüft nicht nur Bilder, sondern auch Text, Audio-Nachrichten und sogar Emoji-Kombinationen auf problematische Muster. Das System lernt kontinuierlich dazu und erkennt neue Formen der Manipulation.

**Behavioral Pattern Recognition** identifiziert Grooming-Versuche bereits in frühen Phasen. Typische Eskalationsmuster – vom harmlosen Smalltalk über Komplimente bis hin zu intimen Fragen – werden automatisch erkannt und unterbrochen.

Neu ist auch das **Digital Wellbeing Dashboard** für Minderjährige. Hier können sie ihre Interaktionen überwachen, verdächtige Kontakte melden und ihre Privatsphäre-Einstellungen zentral verwalten. **Safety Nudges** erinnern regelmäßig an wichtige Schutzmaßnahmen.

**Ende-zu-Ende-Verschlüsselung bleibt gewährleistet**

Trotz aller Schutzmaßnahmen bleibt die Ende-zu-Ende-Verschlüsselung bestehen. Die **Privacy-Preserving Machine Learning** analysiert Inhalte ausschließlich lokal auf den Geräten. Meta hat keinen Zugriff auf die eigentlichen Nachrichten – nur anonymisierte Metadaten werden zur Verbesserung der Algorithmen genutzt.

Das **Federated Learning System** sorgt dafür, dass die KI-Modelle kontinuierlich verbessert werden, ohne dass dabei persönliche Daten das Gerät verlassen. Ein technischer Balanceakt zwischen Sicherheit und Privatsphäre.

Gesellschaftlicher Wandel und neue Regulierung

Der Druck auf Meta ist seit 2024 nochmals gestiegen. Das **EU Digital Services Act (DSA)** und der **UK Online Safety Act** haben rechtlich bindende Standards gesetzt. In den USA arbeitet der Kongress an einem umfassenden **Social Media Safety Act**, der noch 2026 verabschiedet werden könnte.

**Frances Haugens** Enthüllungen haben eine Lawine ausgelöst. Neue Whistleblower haben 2025 weitere interne Dokumente öffentlich gemacht, die zeigen: Meta wusste bereits 2019 über das Ausmaß der Probleme Bescheid, reagierte aber zu zögerlich.

Die **Eltern-Integration** wurde massiv ausgebaut. Das **Family Safety Center** ermöglicht es Erziehungsberechtigten, detaillierte Einblicke in die Instagram-Aktivitäten ihrer Kinder zu erhalten – ohne deren Privatsphäre vollständig aufzuheben. **Supervised Accounts** für unter 16-Jährige sind mittlerweile Standard.

**Ausblick: KI als Lösung und Problem**

Die nächste Generation von Schutztools steht bereits in den Startlöchern. **Predictive Safety AI** soll Risikosituationen vorhersagen, bevor sie entstehen. **Emotional State Detection** erkennt, wenn Nutzer in vulnerablen Zuständen sind und bietet gezielt Hilfe an.

Gleichzeitig entstehen neue Bedrohungen: **Adversarial AI** versucht, Schutzmaßnahmen gezielt zu umgehen. Der Wettlauf zwischen Schutz- und Angriffs-KI wird das Thema der kommenden Jahre bestimmen. Meta investiert mittlerweile über 5 Milliarden Dollar jährlich in Safety-Technologien – ein Zeichen dafür, wie ernst die Lage ist.

Die Maßnahmen zeigen Wirkung: Sextortion-Fälle bei Minderjährigen sind auf Instagram um 60% zurückgegangen. Doch der Kampf um die digitale Sicherheit einer ganzen Generation ist noch lange nicht gewonnen.

Zuletzt aktualisiert am 17.02.2026