Was früher nur in Hollywood-Studios mit Millionen-Budgets möglich war, läuft heute auf jedem Smartphone: KI-gesteuerte Gesichtstausch-Technologie hat sich rasant entwickelt und ist längst massentauglich geworden. Was als harmloser Spaß beginnt, birgt jedoch erhebliche Risiken für Privatsphäre und Gesellschaft.

Deep-Fake-Technologie hat sich seit 2020 dramatisch weiterentwickelt. Was damals noch pixelige Experimente waren, sind heute täuschend echte Videos, die selbst Experten ins Grübeln bringen. Die Gefahr von Deep-Fake-Videos ist real geworden – von manipulierten Politiker-Reden bis hin zu gefälschten Promi-Skandalen.

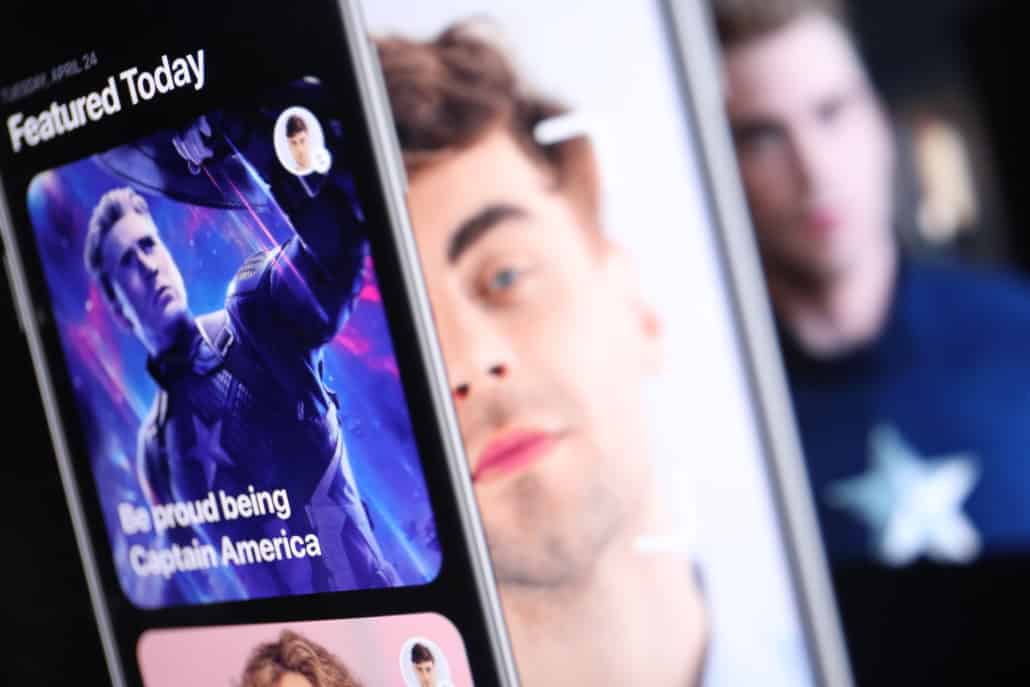

Reface war nur der Anfang einer Welle von Apps, die Face-Swapping demokratisiert haben. Heute konkurrieren Dutzende Anwendungen um eure Aufmerksamkeit: FaceSwap Live, Wombo AI, MyHeritage AI Time Machine und unzählige andere Tools machen aus jedem Smartphone ein Mini-Hollywood-Studio.

Von Reface zu KI-Video-Giganten

Die ursprüngliche Reface-App wurde 2023 von Runway ML übernommen und in deren Gen-3 Video-Pipeline integriert. Parallel dazu haben sich neue Platzhirsche etabliert: RunwayML Gen-3, Pika Labs und Stable Video Diffusion setzen neue Maßstäbe. Diese Tools erstellen nicht mehr nur Gesichtstausch-Videos, sondern komplette KI-generierte Szenen.

Die Qualität ist explodiert: Während frühe Apps noch erkennbar künstlich wirkten, sind moderne KI-Videos oft nicht mehr von echten Aufnahmen zu unterscheiden. Ein einzelnes Foto reicht heute aus, um jemanden in beliebige Videosequenzen zu „teleportieren“ – von Konzertbühnen bis zu Nachrichtenstudios.

Besonders brisant: Die Kosten sind drastisch gesunken. Was 2020 noch Premium-Abos erforderte, läuft heute oft kostenlos. Manche Apps finanzieren sich durch Werbung, andere verkaufen eure Gesichtsdaten weiter – ein Geschäftsmodell mit fragwürdigen Konsequenzen.

Die dunkle Seite der Face-Swap-Revolution

Was als harmloser TikTok-Trend begann, hat ernste gesellschaftliche Folgen entwickelt. Non-consensual Deepfake-Pornografie ist zu einem massiven Problem geworden: Laut einer Studie von Sensity AI sind 96% aller Deep-Fake-Videos pornografischer Natur – meist mit Gesichtern unwissender Frauen.

Politische Manipulation durch gefälschte Videos nimmt zu. Im US-Wahlkampf 2024 kursierten Hunderte manipulierte Kandidaten-Videos. Die EU hat deshalb 2025 den „Digital Services Act“ um spezielle Deep-Fake-Regelungen erweitert.

Doch auch im Alltag entstehen Probleme: Mobbing durch gefälschte „Kompromittierung“, Identitätsdiebstahl und Betrugsversuche nehmen zu. Versicherungen beginnen bereits, Deep-Fake-Schäden als eigene Kategorie zu führen.

Technologie-Boom mit Nebenwirkungen

Die technischen Fortschritte sind atemberaubend: Moderne Algorithmen wie StyleGAN3 und diffusionsbasierte Modelle schaffen fotorealistische Ergebnisse in Echtzeit. Nvidia’s Omniverse und Meta’s Codec Avatars zeigen, wohin die Reise geht: Vollständig KI-generierte Menschen, die live interagieren können.

Start-ups wie Synthesia haben das Business-Segment erobert: Unternehmen erstellen KI-Sprecher für Schulungsvideos, ohne echte Schauspieler zu benötigen. Der Markt für „Synthetic Media“ wird auf 2,4 Milliarden Dollar geschätzt – Tendenz exponentiell steigend.

Doch die Demokratisierung dieser Technologie bedeutet auch: Jeder kann heute gefährliche Deep-Fakes erstellen. Die Einstiegshürden sind praktisch verschwunden.

Schutzmaßnahmen und Erkennung

Die Industrie reagiert: Adobe entwickelt „Content Credentials“, eine Art digitaler Fingerabdruck für authentische Medien. Microsoft’s „Video Authenticator“ erkennt manipulierte Videos mit 95%iger Genauigkeit. Google’s „SynthID“ markiert KI-generierte Inhalte unsichtbar.

Ihr könnt euch schützen: Verwendet Face-Swap-Apps nur von vertrauenswürdigen Anbietern, lest die Datenschutzbestimmungen und überlegt zweimal, bevor ihr euer Gesicht hochladet. Einmal im Internet, sind eure biometrischen Daten praktisch unkontrollierbar.

Für die Erkennung von Deep-Fakes achtet auf: Unnatürliche Augenbewegungen, inkonsistente Beleuchtung, seltsame Schatten um Gesichtskonturen und auffällige Bildqualitäts-Sprünge.

Ausblick: KI-Videos werden alltäglich

Die Zukunft bringt noch realistischere Ergebnisse: OpenAI’s Sora und Google’s Lumiere können bereits minutenlange KI-Videos generieren. Bis 2027 erwarten Experten, dass Deep-Fakes von echten Videos praktisch nicht mehr unterscheidbar sind.

Parallel entwickeln sich aber auch Erkennungstools weiter. Ein digitales Wettrüsten zwischen Erstellern und Detektoren hat begonnen – mit ungewissem Ausgang.

Die Botschaft bleibt dieselbe wie 2020: Traut euren Augen nicht blind. Was ihr seht, könnte Realität sein – oder perfekt gefälschte KI-Kunst. In einer Welt voller Deep-Fakes wird kritisches Hinterfragen zur Überlebensstrategie.

[av_video src=’https://vimeo.com/453605950′ mobile_image=“ attachment=“ attachment_size=“ format=’16-9′ width=’16‘ height=’9′ conditional_play=“ av_uid=’av-6n07m1q‘]

Zuletzt aktualisiert am 28.02.2026