Beauty-Filter und KI-generierte Selfies prägen ein unrealistisches Schönheitsideal. Immer mehr Länder führen eine Kennzeichnungspflicht für bearbeitete Fotos ein. Auch Deutschland diskutiert über entsprechende Gesetze. Was bringen solche Maßnahmen wirklich?

Heute schon mal bei Instagram, TikTok oder BeReal vorbeigeschaut? Falls ja, seid ihr mit an Sicherheit grenzender Wahrscheinlichkeit bereits auf Fotos gestoßen, die mit Filtern nachbearbeitet wurden – oder sogar komplett KI-generiert sind.

Aufgehübscht, nachbearbeitet, aufgepimpt: Das ist heute Standard, wenn Fotos gepostet werden. Ganz besonders bei Influencerinnen und solchen, die es sein oder werden wollen. Doch solche aufgepimpten Bilder haben Folgen. Studien aus 2025 zeigen: Über 40% der jungen Menschen zwischen 13 und 25 Jahren sind unzufrieden mit ihrem Körper – Tendenz steigend.

Darum hat die Politik in mehreren Ländern bereits gehandelt: eine Kennzeichnungspflicht für manipulierte Aufnahmen in Werbung und Social Media. Was ist da passiert und bringt das wirklich etwas?

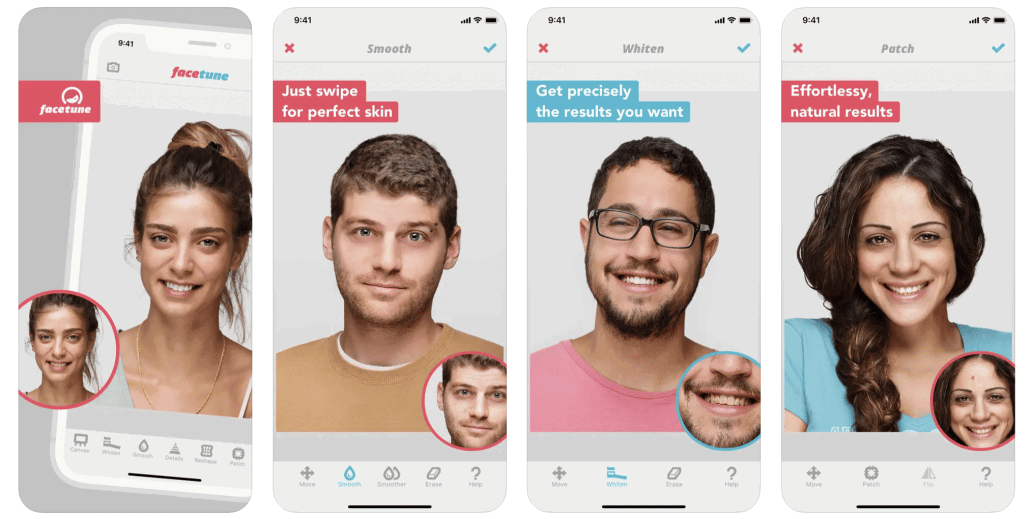

Einige Beauty-Apps geben biometrische Daten weiter

Deutschland zieht nach: Das Digitale Transparenz-Gesetz

Seit Januar 2026 ist es offiziell: Deutschland hat das „Digitale Transparenz-Gesetz“ verabschiedet. Accounts mit über 5.000 Followern müssen Posts kennzeichnen, wenn Beauty-Filter, KI-Tools oder andere Bildbearbeitungs-Software verwendet wurden. Die Regelung gilt für Instagram, TikTok, YouTube und alle anderen sozialen Plattformen.

Die Politik argumentiert: „KI-gestützte Beauty-Filter und Deepfake-Technologien haben die Manipulation von Bildern auf ein neues Level gehoben. Junge Menschen können echte von gefälschten Inhalten nicht mehr unterscheiden.“ Das Problem hat sich seit 2022 massiv verschärft. Heute gibt es nicht nur Millionen Beauty-Filter, die Gesichter schmaler, Nasen kleiner oder Haut glatter machen – sondern auch KI-Tools wie Midjourney oder DALL-E, die komplette Fake-Selfies generieren.

Die neuen Regelungen gehen weiter als frühere Überlegungen. Während 2022 noch über freiwillige Kennzeichnungen diskutiert wurde, sind sie jetzt Pflicht. Verstöße können bis zu 50.000 Euro kosten.

Internationale Vorbilder: Norwegen, Frankreich und die USA

Deutschland orientiert sich an internationalen Vorbildern. Norwegen war 2021 Vorreiter und hat bereits positive Erfahrungen gesammelt. Dort müssen Influencer mit über 500 Followern ihre Originalaufnahmen bei Behörden hinterlegen, wenn sie Filter verwenden.

Frankreich ging 2023 noch einen Schritt weiter: Dort sind in der Werbung nur noch gesamtheitliche Bildbearbeitungen wie Aufhellung oder Schärfung erlaubt. Verändert jemand einzelne Bildteile – Haut, Körperform, Gesichtszüge – ist eine deutliche Kennzeichnung Pflicht.

Auch die USA haben 2025 nachgezogen. Kalifornien, New York und Texas haben eigene Gesetze erlassen. Meta (Facebook/Instagram) und TikTok mussten ihre Algorithmen anpassen und zeigen jetzt automatische Warnhinweise bei erkannten Manipulationen.

KI macht Kontrolle möglich – aber auch schwieriger

Wie lässt sich überhaufen, ob alle Posts korrekt gekennzeichnet werden? Hier kommt KI ins Spiel – von beiden Seiten.

Einerseits machen es KI-Tools wie ChatGPT, Stable Diffusion oder das neue „PerfectMe“ von Adobe immer einfacher, täuschend echte Fake-Bilder zu erstellen. Andererseits können Erkennungs-Algorithmen inzwischen sehr zuverlässig identifizieren, ob Filter oder KI-Tools verwendet wurden.

Google hat 2025 sein „TruthLens“-System vorgestellt, das mit 97%iger Genauigkeit manipulierte Bilder erkennt. Meta hat ähnliche Technologie in Instagram und Facebook integriert. Die Plattformen scannen Posts automatisch und fordern bei Verdacht eine Kennzeichnung.

Bei Verstößen können Behörden die Originalaufnahmen anfordern – wie in Norwegen. Das Bundesamt für digitale Sicherheit (neu gegründet 2025) ist in Deutschland dafür zuständig. Allerdings konzentriert man sich auf relevante Accounts: mindestens 5.000 Follower oder kommerzielle Nutzung.

Die Realität: Erste Erfolge, aber auch Probleme

Wie wirken sich die neuen Gesetze aus? Die ersten Studien aus Norwegen und Frankreich sind durchaus ermutigend. Bei Jugendlichen, die regelmäßig entsprechende Hinweise sehen, ist das Bewusstsein für Bildmanipulation gestiegen. Die Körperzufriedenheit hat sich leicht verbessert.

Allerdings gibt es auch einen Gewöhnungseffekt. Wie bei „Werbung“-Kennzeichnungen nehmen viele Nutzer die Hinweise nach einiger Zeit nicht mehr bewusst wahr. Manche Influencer umgehen die Regeln auch, indem sie ihre Accounts aufteilen oder ins Ausland verlagern.

Ein neues Problem sind außerdem KI-generierte „Influencer“ – komplett künstliche Personen, die als echt ausgegeben werden. Diese müssen seit 2026 in Deutschland als „KI-generiert“ gekennzeichnet werden. Aber die Grenzen verschwimmen: Was ist noch ein Foto einer echten Person mit Filter – und was schon ein KI-Avatar?

Das berühmte Obama-Video ist ein Deep Fake: Täuschend echt – aber Fake

Ausblick: Metaverse und die Zukunft der Realität

Die Diskussion wird komplizierter, je mehr sich digitale und physische Realität vermischen. Im Metaverse – das 2026 endlich Fahrt aufnimmt – sind alle Avatare künstlich. Braucht es dort Kennzeichnungen? Und was passiert mit Augmented-Reality-Filtern, die das echte Gesicht in Echtzeit verändern?

Meta arbeitet an „Reality Labels“ – Kennzeichnungen, die in AR/VR-Umgebungen anzeigen, was echt und was digital ist. Apple hat in Vision Pro 2 (erschienen Anfang 2026) ähnliche Features integriert.

Parallel dazu werden Deep Fakes in Videos immer problematischer. Die EU arbeitet an einer erweiterten Kennzeichnungspflicht, die 2027 auch bewegte Bilder erfassen soll.

Fazit: Ein wichtiger Schritt, aber kein Allheilmittel

Die Kennzeichnungspflicht für bearbeitete Bilder ist ein richtiger und wichtiger Schritt. Sie sensibilisiert für die Manipulation von Bildern und kann helfen, unrealistische Schönheitsideale zu entlarven.

Allerdings ist sie kein Allheilmittel. Medienbildung bleibt entscheidend – junge Menschen müssen lernen, kritisch mit digitalen Inhalten umzugehen. Und die Technologie entwickelt sich schneller als die Gesetze.

Immerhin: Das Bewusstsein für das Problem ist da. Und das ist schon mal ein Anfang. Denn am Ende geht es um nicht weniger als die Frage: Was ist noch echt in unserer digitalen Welt?

Zuletzt aktualisiert am 21.02.2026