Die Zeiten werden unheimlich: Deepfakes sind längst keine Science-Fiction mehr, sondern bittere Realität. Was früher Hollywood-Studios mit Millionenbudgets hinbekommen haben, schafft heute jeder mit dem Smartphone. Wir können Videos, Audios und Fotos nicht mehr trauen – und brauchen dringend neue Strategien im Umgang damit.

Jeder kann heute mit Apps wie FaceSwap oder Reface binnen Minuten täuschend echte Videos erstellen. Ein paar Selfies hochladen, Ziel-Video auswählen – fertig ist der Gesichtstausch. Was als Spaß-App begann, ist zur ernsthaften Bedrohung geworden. Pornovideos mit fremden Gesichtern, gefälschte Politiker-Statements oder manipulierte Beweise vor Gericht.

KI macht Fakes perfekt

Die Technologie dahinter heißt Generative Adversarial Networks (GANs). Zwei KI-Systeme kämpfen gegeneinander: Eines erstellt Fakes, das andere versucht sie zu entlarven. So perfektionieren sie sich gegenseitig. Das Resultat: Videos, die selbst Experten täuschen.

Besonders problematisch sind kommerzielle Tools wie DeepFaceLab oder FaceSwap, die kostenlos verfügbar sind. Binnen weniger Stunden Training kann jeder realistische Deepfakes erstellen. YouTube ist voll mit Tutorials dazu.

Doch erst professionelle KI-Services wie Synthesia oder D-ID zeigen das wahre Potenzial. Hier reichen wenige Minuten Videomaterial, um jemanden alles sagen zu lassen. Nachrichtensprecher, Politiker, CEOs – niemand ist sicher.

Obama warnt vor sich selbst

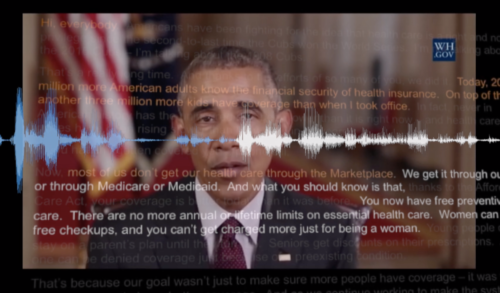

Das berühmteste Beispiel stammt von BuzzFeed und Filmemacher Jordan Peele aus 2018. Sie ließen Barack Obama scheinbar vor Deepfakes warnen – mit einem Deepfake von Obama selbst.

Der Clou: Obama sagt Dinge, die er niemals sagen würde. „President Trump is a total and complete dipshit“ – ein Satz, den der echte Obama nie aussprechen würde. Aber das Video sieht perfekt echt aus.

Entstanden ist das an der University of Washington mit damals noch experimenteller Technologie. Heute braucht man dafür nur noch eine gute Grafikkarte und etwas Geduld.

Stimmen klonen wird zum Kinderspiel

Noch beängstigender sind Voice-Cloning-Tools. ElevenLabs, Murf oder Descript brauchen nur wenige Minuten Audiomaterial, um jede Stimme perfekt zu imitieren. Ein paar Sprachnachrichten aus WhatsApp reichen bereits.

Die Folgen sind verheerend: Enkeltrick-Betrüger nutzen geklonte Stimmen, um Angehörige zu täuschen. Politiker werden Aussagen untergeschoben. Unternehmen fallen auf gefälschte CEO-Anweisungen herein.

2024 verlor eine Bank in Hongkong 25 Millionen Dollar durch ein Deepfake-Video-Call mit dem vermeintlichen CFO. 2025 beeinflussten Deepfakes bereits mehrere Wahlkämpfe weltweit.

Erkennung wird immer schwieriger

Wie erkennt man Deepfakes? Die klassischen Hinweise verschwinden: Unstimmige Beleuchtung, unnatürliche Augenbewegungen oder Bildverzerrungen beim Gesichtswechsel sind längst Geschichte.

Professionelle Detection-Tools wie Deepware Scanner, Microsoft Video Authenticator oder Intel FakeCatcher helfen, sind aber nicht fehlerfrei. Die Detektionsrate liegt bei bestenfalls 90 Prozent – und sinkt stetig.

Google und Meta investieren Millionen in Deepfake-Detection. Doch es ist ein Wettrüsten: Sobald ein Erkennungsalgorithmus bekannt wird, trainieren die Fälscher ihre KI dagegen.

Digitale Signaturen als Rettung?

Die Lösung könnte Content Authenticity Initiative (CAI) sein. Adobe, Microsoft und weitere Tech-Riesen arbeiten an Standards, die Medieninhalte von der Entstehung an digital signieren.

Tools wie Project Origin oder Truepic versiegeln Fotos und Videos bereits bei der Aufnahme. Jede Manipulation wird sichtbar. Nachrichtenagenturen wie Reuters nutzen solche Systeme bereits.

Doch das funktioniert nur bei neuen Inhalten. Billionen existierender Medien bleiben ungeschützt.

Was können wir tun?

Skeptisch bleiben ist das A und O. Fragt euch bei jedem viralen Video: Wer hat es veröffentlicht? Gibt es andere Quellen? Passt der Inhalt zur Person?

Achtet auf Details: Unnatürliche Gesichtskonturen, inkonsistente Schatten oder Audioqualität können Hinweise sein. Bei wichtigen Entscheidungen mehrere Quellen prüfen.

Unternehmen sollten Verification-Protokolle einführen. Sensible Anweisungen per Video-Call? Zusätzlich telefonisch bestätigen lassen.

Browsererweiterungen wie InVID oder TinEye helfen bei der Quellenprüfung. Reverse Image Search zeigt, ob Bilder bereits anderswo verwendet wurden.

Die Zukunft wird kompliziert

Deepfakes werden besser, billiger und einfacher zu erstellen. Gleichzeitig arbeiten Forscher an besseren Detection-Methoden und rechtlichen Frameworks.

Die EU plant strengere Regulierung für KI-generierte Inhalte. Plattformen wie TikTok und YouTube kennzeichnen bereits KI-Content – wenn sie ihn erkennen.

Am Ende bleibt nur eins: Medienkompetenz wird überlebenswichtig. Wir müssen lernen, in einer Welt zu leben, in der wir unseren Augen nicht mehr trauen können.

Denn eines ist sicher: Die Büchse der Pandora ist geöffnet. Deepfakes sind da, um zu bleiben.

Zuletzt aktualisiert am 06.03.2026