DeepFakes werden immer besser, lassen sich immer schwerer erkennen – und sind gleichzeitig immer einfacher herzustellen. Eine unheilvolle Kombination.

Im Netz kursieren nicht nur merkwürdige Behauptungen und FakeNews, sondern immer öfter auch perfekt gefälschte Fotos und Videos. 2024 war ein Wendepunkt: Deepfakes sind massentauglich geworden und überfluten soziale Medien.

Die Aufnahmen, die KI-Systeme heute ausspucken, sind kaum noch von echten Fotos zu unterscheiden. Während wir früher noch unscharfe Finger oder unrealistische Gesichtszüge entdecken konnten, haben moderne AI-Generatoren wie Midjourney V6, DALL-E 3 und Stable Diffusion XL diese Kinderkrankheiten überwunden.

Fotos, die Donald Trump in einer solchen Situation zeigen, sind brisant

2024: Das Jahr der Deepfake-Explosion

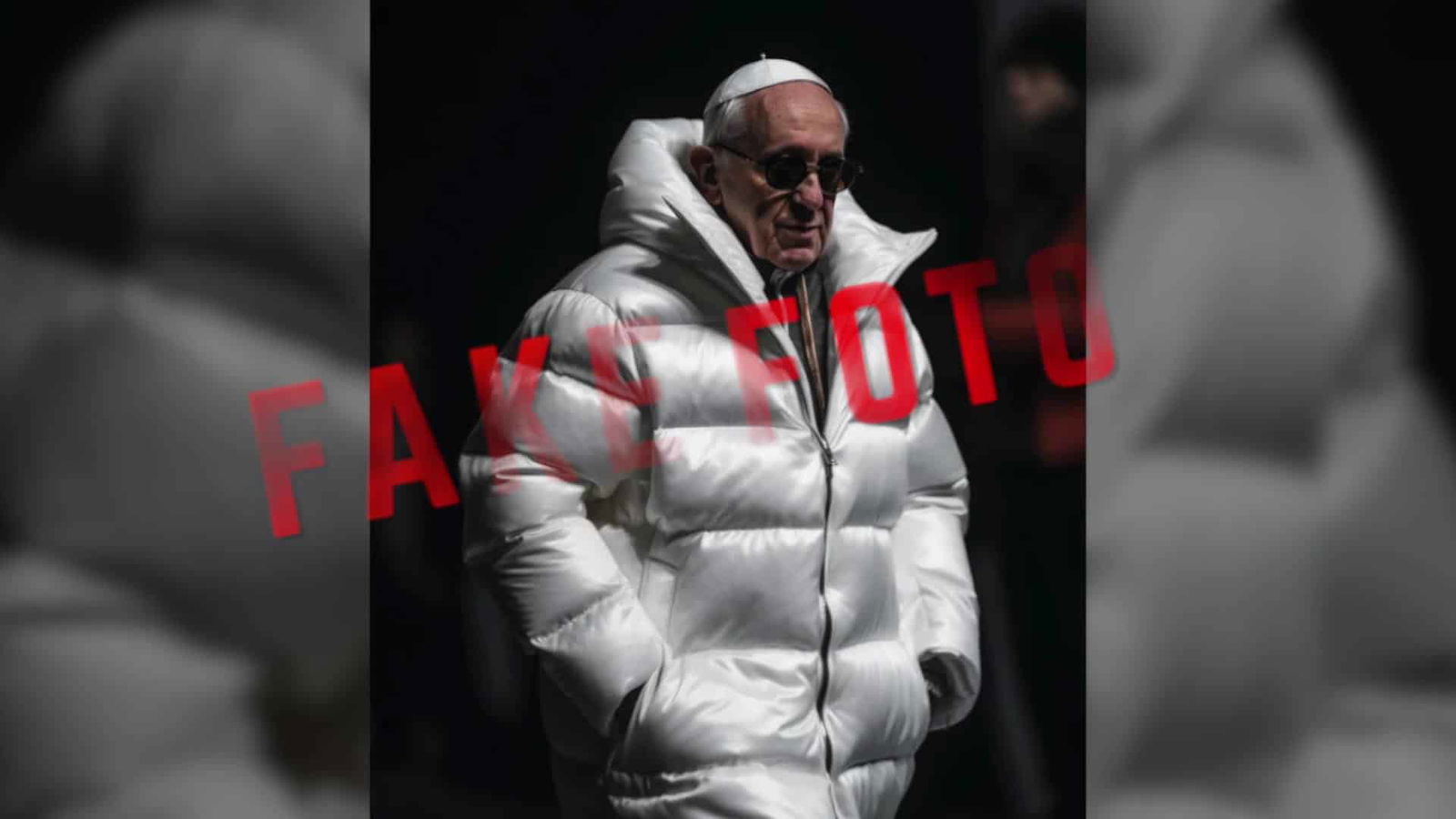

Was 2023 noch Schlagzeilen machte – der Papst in weißer Daunenjacke, gefakte Trump-Verhaftungsfotos – wirkt heute fast harmlos. 2024 brachte uns AI-generierte Wahlkampfvideos, gefälschte CEO-Statements, die Aktienkurse bewegten, und deepfake-Videos von Prominenten, die für fragwürdige Produkte warben.

Die Qualität ist explosionsartig gestiegen. Moderne Text-zu-Bild-Modelle wie Midjourney V6 oder das neue Adobe Firefly Image 3 erstellen in Sekundenschnelle fotorealistische Bilder. Video-Deepfakes, früher Experten vorbehalten, lassen sich jetzt mit Apps wie FaceSwap oder DeepFaceLab von jedem erstellen.

Besonders perfide: Face-Swap-Technologie wird zunehmend für nicht-konsensuelle intime Inhalte missbraucht. Schätzungen gehen davon aus, dass über 90% aller Deepfake-Videos pornographischen Inhalt zeigen – meist mit Frauen als Opfern.

Es gibt diverse KI-Systeme, mit denen sich hochwertige Deepfakes herstellen lassen

Die neue Generation der KI-Bildgeneratoren

Midjourney ist längst nicht mehr allein auf weiter Flur. OpenAIs DALL-E 3, Googles Imagen 3 und Stability AIs SDXL Turbo kämpfen um die Krone der realistischsten Bildgenerierung. Adobe hat Firefly Image 3 direkt in Photoshop integriert – Deepfakes erstellen war noch nie so komfortabel.

Die Geschwindigkeit ist atemberaubend: Was früher Minuten dauerte, passiert heute in Echtzeit. Runway ML und Pika Labs generieren bereits hochauflösende Videos aus simplen Textbeschreibungen. Googles VideoPoet und Metas Make-A-Video zeigen, wohin die Reise geht: Vollständig AI-generierte Filme sind nicht mehr Science Fiction.

Besonders brisant: Real-Time-Deepfakes für Video-Calls. Tools wie DeepFaceLive ermöglichen es, während Zoom-Meetings live das Gesicht zu tauschen. Perfekt für Betrug oder um bei wichtigen Terminen einen „besseren“ Eindruck zu machen.

Midjourney produziert erstaunliche Fotos und Aufnahmen

Der Aufstieg der Smartphone-Deepfakes

Vorbei sind die Zeiten, in denen professionelle Software nötig war. Apps wie Reface, Wombo AI oder FacePlay bringen Deepfake-Technologie auf jedes Smartphone. Mit wenigen Klicks könnt ihr euer Gesicht in Filmszenen einfügen oder bekannte Persönlichkeiten tanzen lassen.

Doch die spielerische Nutzung hat eine dunkle Seite: Cybermobbing erreicht neue Dimensionen, wenn Mitschüler in kompromittierenden Situationen dargestellt werden können. Messenger wie Telegram sind voller Channels, die gegen Geld personalisierte Deepfakes erstellen.

Meta (Facebook/Instagram) und TikTok kämpfen einen aussichtslosen Kampf gegen die Flut gefälschter Inhalte. Ihre KI-Erkennungssysteme hinken der Entwicklung hinterher – ein Katz-und-Maus-Spiel, bei dem die Maus derzeit gewinnt.

Wenn Jörg mal ins Weiße Haus einzieht…

Moderne Erkennungsmethoden und ihre Grenzen

Die klassischen Warnsignale – unscharfe Finger, unnatürliche Augen, Bildstörungen – gehören der Vergangenheit an. Aktuelle Deepfakes sind technisch brillant. Dennoch gibt es neue Ansätze zur Erkennung:

Technische Detektoren: Tools wie Microsoft Video Authenticator, Intel FakeCatcher oder Sensity analysieren Mikropattern in Pixelstrukturen. Ihre Trefferquote liegt bei modernen Deepfakes aber nur noch bei 60-70%.

Biologische Marker: Forscher suchen nach unwillkürlichen menschlichen Eigenarten – Lidschlag-Frequenz, Mikro-Ausdrücke, Pulssignale in der Haut. Doch auch diese lassen sich bereits simulieren.

Blockchain-Verifikation: C2PA (Coalition for Content Provenance and Authenticity) entwickelt Standards für kryptographische Signaturen in Bildern. Adobe, Microsoft und andere implementieren diese bereits – aber nur bei neuen Inhalten.

Verhaltensanalyse: KI-Systeme lernen, typische Bewegungsmuster und Sprechgewohnheiten echter Personen zu erkennen. Deepfakes kopieren zwar das Aussehen, aber selten diese subtilen Eigenarten perfekt.

Hinweise für DeepFakes sind Störungen und Unzulänglichkeiten

Gesetzgebung und gesellschaftliche Antworten

Die Politik reagiert: Die EU arbeitet an verschärften Regelungen im AI Act, mehrere US-Bundesstaaten haben Deepfake-Verbote erlassen. In Deutschland diskutiert man über Strafverschärfungen bei nicht-konsensuellen Deepfakes.

Doch Gesetze hinken der Technologie hinterher. Während Parlamentarier noch debattieren, entstehen täglich Millionen neuer KI-generierter Bilder. Die Durchsetzung ist praktisch unmöglich, wenn Server in rechtsfreien Räumen stehen.

Plattformen setzen auf Community-Richtlinien und AI-Detection, aber der Kampf gleicht dem Kampf gegen Spam: Für jede gesperrte Methode entstehen drei neue.

Praktische Tipps für den Alltag

Gesunder Skeptizismus: Fragt euch bei spektakulären Bildern: Wer profitiert davon? Warum taucht das Foto gerade jetzt auf? Gibt es andere Quellen?

Reverse Image Search: Google Lens, TinEye oder Yandex Images helfen, die Herkunft von Bildern zu verfolgen. Oft findet ihr das Original oder ähnliche Versionen.

Details prüfen: Auch moderne Deepfakes haben Schwächen bei komplexen Details – Schmuck, Logos, Hintergrundobjekte wirken oft inkonsistent.

Kontext beachten: Stimmt die Beleuchtung? Passen Schatten zusammen? Wirkt die Kleidung zur Situation?

Mehrfachquellen: Seriöse Medien haben Fact-Checking-Teams. Wenn nur obskure Accounts ein „sensationelles“ Foto teilen, ist Vorsicht geboten.

Die Deepfake-Revolution ist unaufhaltsam. Wir müssen lernen, in einer Welt zu leben, in der „sehen“ nicht mehr „glauben“ bedeutet. Critical Thinking wird zur wichtigsten Kompetenz der digitalen Zukunft.

Zuletzt aktualisiert am 19.02.2026