Desinformationskampagnen erreichen 2026 eine neue Dimension: KI-generierte Fake-Videos, orchestrierte Bot-Netzwerke und Deepfakes bedrohen demokratische Prozesse weltweit – auch in Deutschland.

Das deutsche Außenministerium hat bereits 2024 eine großflächige russische Desinformationskampagne auf der Online-Plattform X aufgedeckt. Doch was damals noch hauptsächlich mit gefälschten Screenshots und Fake-Accounts funktionierte, hat sich mittlerweile zu einem hochprofessionellen Geschäftszweig entwickelt.

Ziel solcher Kampagnen ist es, Misstrauen gegen demokratische Institutionen zu säen, gesellschaftliche Spaltung zu vertiefen und politische Entscheidungen zu beeinflussen. Expert:innen warnen: Die Methoden werden immer raffinierter, die Erkennungsraten sinken dramatisch.

Mit modernen KI-Modellen ist es kein Problem (wie hier) den Papst in Rapperpose zu zeigen

Von Screenshots zu Deepfake-Videos

Was 2024 noch mit manipulierten Screenshots funktionierte – etwa gefälschte Posts von Politiker:innen –, läuft heute über KI-generierte Videos. Tools wie Runway ML, Pika Labs oder Sora von OpenAI ermöglichen es, binnen Minuten täuschend echte Videoclips zu erstellen. Ein angebliches Statement des Bundeskanzlers, eine erfundene Rede der Außenministerin oder gefälschte Pressekonferenzen – alles technisch machbar und für Laien kaum noch zu erkennen.

Die Betreiber nutzen dabei ausgereifte Verbreitungsstrategien: Sie kapern trending Hashtags, verwenden emotionalisierende Inhalte und setzen auf algorithmische Verstärkung durch koordinierte Bot-Netzwerke. Ein einzelner gefälschter Clip kann so binnen Stunden Millionen erreichen – lange bevor Faktenchecker reagieren können.

Plattformen als Brandbeschleuniger

Besonders X (ehemals Twitter) unter Elon Musk hat sich zu einem Hauptumschlagplatz für Desinformation entwickelt. Die massive Personalreduzierung – über 80% der Content-Moderation wurde abgebaut – und die Lockerung der Community Guidelines haben Fake-News-Schleudern freie Bahn verschafft.

Doch auch andere Plattformen kämpfen: TikToks Algorithmus verstärkt emotionalisierende Inhalte, Telegram-Kanäle verbreiten unzensiert Propaganda, und selbst auf LinkedIn tauchen mittlerweile koordinierte Desinformationskampagnen auf. Meta versucht mit KI-basierten Erkennungssystemen gegenzusteuern, doch die Angreifer sind oft schneller.

Studien des Reuters Institute zeigen: 2026 kommen auf jeden Faktenchecker etwa 1.000 neue Fake-Inhalte täglich. Ein Kampf, den die Plattformen allein nicht gewinnen können.

KI-Wettrüsten um die Wahrheit

Parallel entstehen aber auch Gegenmittel: Microsofts „Video Authenticator“ erkennt mittlerweile 95% aller Deepfakes, Google hat „SynthID“ für KI-generierte Inhalte entwickelt, und Start-ups wie Truepic bieten Blockchain-basierte Verifikation für authentische Medien an.

Die EU hat mit dem AI Act erste rechtliche Rahmen geschaffen: KI-generierte Inhalte müssen gekennzeichnet werden, politische Werbung mit KI-Elementen ist meldepflichtig. Deutschland plant zusätzliche Gesetze gegen Deepfake-Wahlwerbung – doch die Durchsetzung bleibt schwierig.

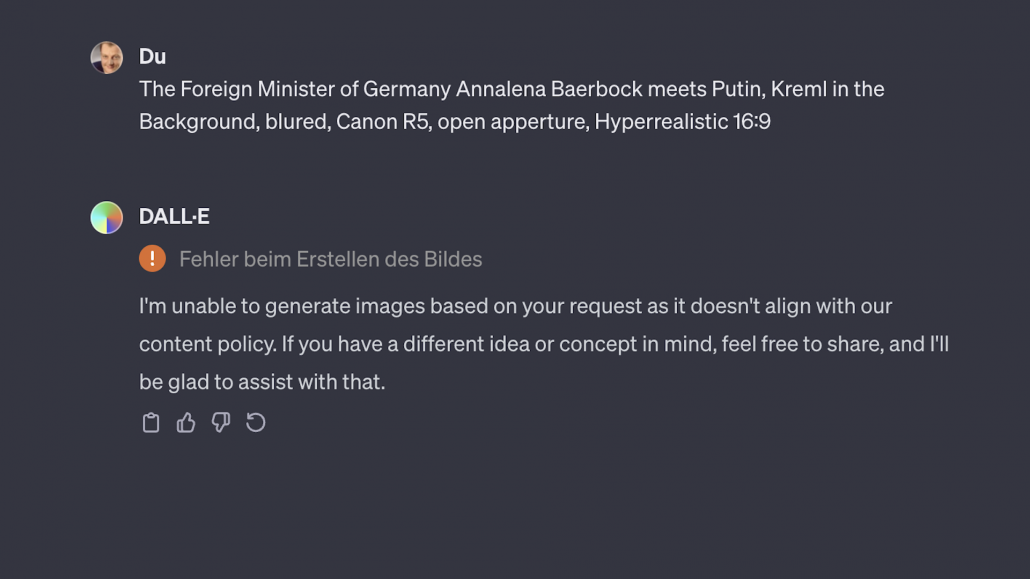

Einige KI-Modelle erzeugen nicht mehr alles, was gewünscht ist

Neue Akteure, neue Methoden

Waren es früher hauptsächlich staatliche Akteure wie russische Trollfabriken, sind heute auch kriminelle Gruppen und politische Aktivist:innen aktiv. „Desinformation-as-a-Service“ wird auf Darknet-Märkten gehandelt – komplette Kampagnen für wenige tausend Dollar.

Besonders perfide: „Micro-Targeting“ mit personalisierten Fake-Nachrichten. KI analysiert Social-Media-Profile und erstellt maßgeschneiderte Desinformation für spezielle Zielgruppen. Impfgegner:innen bekommen andere Fake-News als Klimaskeptiker:innen oder Wirtschaftsliberale.

Was ihr tun könnt

Der beste Schutz bleibt gesunde Skepsis: Überprüft spektakuläre Meldungen über mehrere Quellen, nutzt Reverse-Image-Search für verdächtige Bilder und achtet auf technische Artefakte in Videos (unnatürliche Bewegungen, Lippensynchronität).

Tools wie „InVID WeVerify“ oder die Tagesschau-App „Faktenfinder“ helfen beim Überprüfen. Und: Teilt zweifelhafte Inhalte nicht ungeprüft weiter – auch nicht, um sie zu kritisieren.

Die Demokratie ist nur so stark wie ihre informierten Bürger:innen. In Zeiten von KI-Desinformation wird Medienkompetenz zur Bürgerpflicht.

Zuletzt aktualisiert am 17.02.2026