Es ist keine einfache Aufgabe: Wie lässt sich verhindern, dass auf Plattformen wie TikTok, Instagram, Telegram, Youtube oder X bewusst Falschinformationen zum Thema Impfen und Gesundheit verbreitet werden, die unnötige und unangemessene Angst und Panik verbreiten? Das Recht auf freie Meinungsäußerung ist wichtig – gleichzeitig sollten bewusst gestreute Zweifel eingedämmt werden. Eine interne Studie von Facebook (heute Meta) belegte bereits 2021: Es sind einige wenige Personen, die für Verunsicherung sorgen – ein Muster, das sich bis heute fortsetzt.

Wir wissen es längst: Social Media wie TikTok, Instagram, Telegram, YouTube und X sind nicht unbedingt die beste Adresse, wenn ihr euch solide und seriös informieren möchtet. Denn Wahres steht gleichwertig neben Falschem, das Aufklärende sieht grundsätzlich genau aus wie das Verunsichernde und Zerstörende.

Zu allem Überfluss begünstigen die Algorithmen von Meta und Co. alles, was Krawall macht, Emotionen aufwühlt und für Aufmerksamkeit sorgt. So ist sie eben, die „Erregungsökonomie“ – einige wenige Portale profitieren davon, wenn Verschwörungsgeschichten die Runde machen.

Klassische Studie zeigt zeitloses Muster

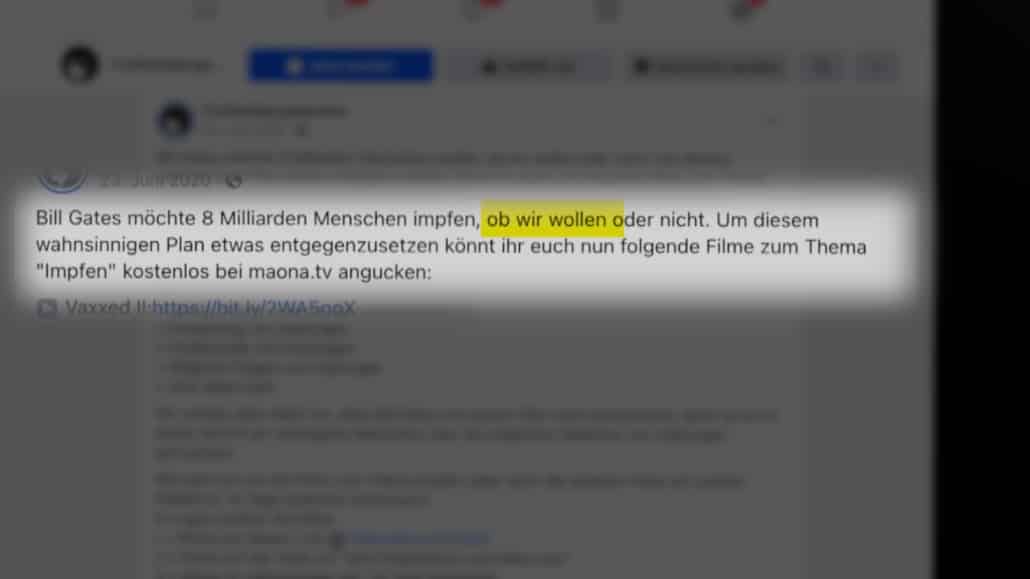

Eine interne Studie von Facebook aus dem Jahr 2021, die damals in der Washington Post zitiert wurde, bleibt hochaktuell. Facebook wollte wissen: Wer ist eigentlich für verunsichernde, fehl leitende und falsche Informationen über Corona-Impfungen und Impfstoffe verantwortlich? Dazu wurden die US-Nutzer in 638 Gruppen mit jeweils mindestens 3 Millionen Mitgliedern eingeteilt.

Das Ergebnis war eindeutig: Nur 10 Gruppen waren für über 50% der problematischen Inhalte verantwortlich. Und in der aktivsten Gruppe nur 111 Personen wiederum für erneut über 50% der Inhalte. Dieses Muster zeigt sich auch heute noch – bei Gesundheitsmythen, Klimawandel-Leugnung oder anderen Verschwörungserzählungen.

Neue Plattformen, alte Probleme

Während sich die digitale Landschaft seit 2021 stark verändert hat, sind die Mechanismen dieselben geblieben. TikTok ist zur Haupt-Informationsquelle vieler Jugendlicher geworden, Telegram dient als Rückzugsraum für radikale Gruppen, und X (ehemals Twitter) hat seine Moderationsrichtlinien gelockert.

Besonders problematisch: Auf TikTok verpacken Desinformanten ihre Botschaften in unterhaltsame Videos, die viral gehen. Instagram Reels verstärken den Effekt zusätzlich. Die kurzen Formate erschweren differenzierte Aufklärung – komplexe Sachverhalte lassen sich schlecht in 30-Sekunden-Clips erklären.

KI verstärkt das Problem

Seit 2024 verschärft künstliche Intelligenz die Situation dramatisch. Deepfakes von Ärzten, die angeblich vor Impfungen warnen, sind täuschend echt geworden. ChatGPT-generierte „wissenschaftliche“ Texte klingen seriös, enthalten aber Falschinformationen. Automatisierte Bots verbreiten Verschwörungstheorien effizienter denn je.

Die gleichen wenigen Akteure nutzen jetzt KI-Tools, um ihre Reichweite zu multiplizieren. Was früher manuell gepostet wurde, erledigen heute Algorithmen rund um die Uhr.

Neue Strategien gegen alte Muster

Die Erkenntnisse von damals helfen heute noch: Da nur wenige „Super-Spreader“ für den Großteil der Desinformation verantwortlich sind, lassen sich gezielte Gegenmaßnahmen entwickeln. Plattformen experimentieren mit verschiedenen Ansätzen:

- Community Notes bei X: Nutzer können irreführende Posts mit Kontext versehen

- Algorithmus-Anpassungen: Gesundheitsinhalte ohne seriöse Quellen werden weniger verbreitet

- Fact-Checking-Labels: Zweifelhafte Inhalte werden markiert

- Shadow-Banning: Problematische Accounts erreichen weniger Menschen

Digital Services Act zeigt Wirkung

Seit 2024 greift der EU Digital Services Act (DSA) auch bei Desinformation durch. Große Plattformen müssen transparenter über ihre Algorithmen werden und Risiken für die öffentliche Gesundheit minimieren. Erste Erfolge sind sichtbar: Die Reichweite von Gesundheitsmythen ist messbar zurückgegangen.

Trotzdem bleiben Telegram und kleinere Plattformen Rückzugsräume für Verschwörungsgruppen. Das Katz-und-Maus-Spiel geht weiter.

Was ihr tun könnt

Als Nutzer seid ihr nicht machtlos. Meldet offensichtliche Falschinformationen, nutzt die Community-Features der Plattformen und informiert euch bei seriösen Quellen. Die überwiegende Mehrheit macht bei der Desinformation nicht mit – das zeigt: Aufklärung wirkt.

Verantwortliche in Politik und Gesundheitswesen sollten die Lehren aus der Facebook-Studie beherzigen: Wenige Akteure, große Wirkung. Gezielte Maßnahmen sind effektiver als Gießkannen-Ansätze.

[av_video src=’https://vimeo.com/525994730′ mobile_image=“ attachment=“ attachment_size=“ format=’16-9′ width=’16‘ height=’9′ conditional_play=“ av_uid=’av-8mg89gn‘]

Jana Baumann von netzpolitik.org erklärt die Hintergründe der Studie

Zuletzt aktualisiert am 26.02.2026