Multimodale KI-Systeme verbinden Text, Bild und Sprache zu einer neuen Generation intelligenter Anwendungen. Was früher Science Fiction war, ist heute Realität – mit beeindruckenden Möglichkeiten.

Die Entwicklung multimodaler KI hat seit 2023 einen enormen Sprung gemacht. Was damals mit MiniGPT-4 als experimentellem Projekt begann, ist heute Standard in führenden KI-Systemen. GPT-4V (Vision), Anthropics Claude 3, und Googles Gemini Ultra beherrschen längst die nahtlose Verarbeitung von Text, Bildern und sogar Audio in einem einzigen Modell.

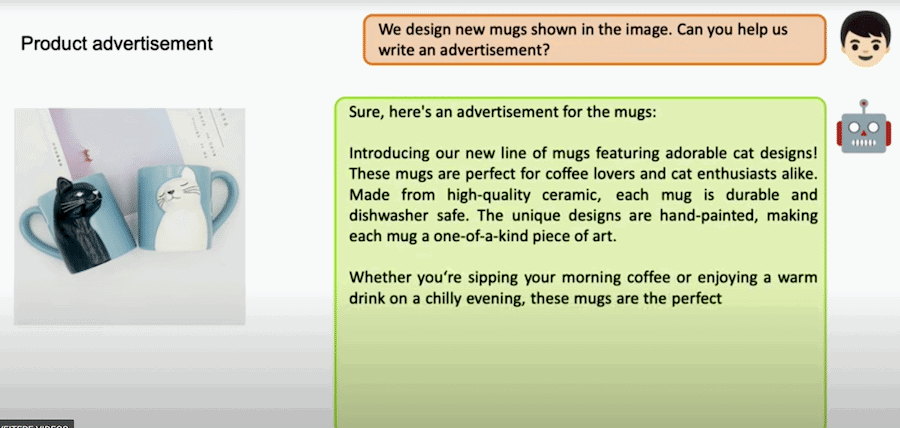

Diese KI-Systeme können heute weit mehr als nur Bilder beschreiben. Sie analysieren Screenshots von Webseiten und erstellen den dazugehörigen Code, entwickeln aus handgemalten Skizzen funktionsfähige Apps, oder erstellen komplette Rezepte basierend auf einem Foto eurer Kühlschrank-Inhalte. Die Zeiten, in denen man verschiedene Tools für verschiedene Medientypen brauchte, sind vorbei.

Rezepte erstellen basierend auf den Zutaten in einem Bild

Revolution der multimodalen Verarbeitung

Die heutigen multimodalen KI-Systeme haben das ursprüngliche Konzept von MiniGPT-4 weit übertroffen. OpenAIs GPT-4V verarbeitet nicht nur Texte und Bilder gleichzeitig, sondern versteht auch den Kontext zwischen beiden Medien auf einem Niveau, das 2023 undenkbar war. Claude 3 Opus von Anthropic kann sogar komplexe Diagramme interpretieren und mathematische Formeln aus handgeschriebenen Notizen extrahieren.

Besonders beeindruckend: Diese Systeme benötigen heute keine spezielle Hardware mehr. Was früher eine Nvidia RTX 3090 erforderte, läuft jetzt über Cloud-APIs und ist für jedermann zugänglich. Meta hat mit Llama 3.2 Vision sogar Open-Source-Alternativen geschaffen, die auf handelsüblichen Computern laufen.

Die praktischen Anwendungen sind explosionsartig gewachsen. Ärzte nutzen multimodale KI zur Analyse von Röntgenbildern kombiniert mit Patientendaten. Architekturbüros lassen sich von groben Skizzen komplette 3D-Modelle erstellen. Und Content-Creator verwandeln einfache Fotos in durchdachte Social-Media-Kampagnen – alles mit einem einzigen Tool.

KI sieht, hört und versteht

Die neueste Generation multimodaler KI geht weit über Bildbeschreibungen hinaus. OpenAIs Advanced Voice Mode kombiniert bereits Sprache mit Bilderkennung in Echtzeit. Ihr könnt euer Smartphone auf einen defekten Gegenstand richten, das Problem beschreiben, und bekommt sofort eine Reparaturanleitung – visuell und akustisch aufbereitet.

Google DeepMind hat mit Gemini 2.0 im Dezember 2025 gezeigt, wohin die Reise geht: Die KI kann Live-Videos analysieren, gleichzeitig auf Sprachbefehle reagieren und kontextuelle Informationen einblenden. Das funktioniert bereits in Google Lens, wo ihr Gegenstände einfach mit der Kamera erfasst und sofort relevante Informationen erhaltet.

Die Bilderzeugung haben diese Systeme ebenfalls revolutioniert. Während das ursprüngliche MiniGPT-4 nur analysieren konnte, erzeugen heutige multimodale Systeme auf Wunsch auch visuelle Inhalte. DALL-E 3 ist direkt in ChatGPT integriert, Midjourney V7 versteht komplexe Textanweisungen, und Adobe Firefly erstellt sogar Videos aus Textbeschreibungen.

Was passiert, wenn jemand die Ballon loslässt?

Neue Herausforderungen entstehen

Mit der rasanten Entwicklung sind auch neue Probleme entstanden. Die Datenschutzfrage ist drängender denn je: Diese KI-Systeme analysieren nicht nur Text, sondern auch private Fotos, Screenshots und sogar Live-Kamerabilder. Europäische Unternehmen setzen daher verstärkt auf lokale Lösungen wie Aleph Alphas Luminous oder deutsche Entwicklungen aus dem LEAM-Projekt.

Die Gefahr von Deepfakes hat sich durch multimodale KI potenziert. Systeme können heute aus wenigen Fotos einer Person täuschend echte Videos erstellen. Meta und OpenAI haben zwar Schutzmaßnahmen implementiert, aber die Technologie ist bereits in freier Wildbahn verfügbar. Tools wie FaceSwap oder DeepFaceLive zeigen, wie zugänglich diese Technologie geworden ist.

Ein weiteres Problem: Die schiere Menge an Trainingskosten und Energieverbrauch. Training multimodaler Modelle kostet Millionen und verbraucht Unmengen an Strom. Forscher arbeiten daher an effizienteren Architekturen. Apples On-Device-Modelle in iOS 18 zeigen, dass auch lokale Verarbeitung möglich ist, ohne Cloud-Abhängigkeit.

Ausblick: Was kommt als Nächstes?

Die nächste Evolutionsstufe steht bereits vor der Tür: Embodied AI, also KI-Systeme, die nicht nur verschiedene Medien verstehen, sondern auch physisch in der Welt agieren können. Teslas Optimus-Roboter und Bostons Atlas zeigen erste Ansätze, wie multimodale KI in robotische Systeme integriert wird.

Augmented Reality wird durch multimodale KI völlig neu definiert. Apples Vision Pro und Meta Quest 3S nutzen bereits KI, um die Realität zu erweitern. Bald werdet ihr einfach auf einen Gegenstand zeigen können und alle relevanten Informationen holographisch eingeblendet bekommen.

Für Entwickler eröffnen sich ungeahnte Möglichkeiten. APIs wie die von Anthropic, OpenAI oder Google machen multimodale Funktionen für jedermann zugänglich. Startups entwickeln bereits spezialisierte Anwendungen: Von KI-Stylisten, die Outfit-Empfehlungen aus Kleiderschrank-Fotos geben, bis zu Haushalts-Assistenten, die aus Kühlschrank-Inhalten Wochenpläne erstellen.

Verantwortung im KI-Zeitalter

Die Macht multimodaler KI bringt Verantwortung mit sich. Die EU-KI-Verordnung, die 2024 in Kraft getreten ist, reguliert bereits den Einsatz solcher Systeme in kritischen Bereichen. Unternehmen müssen Transparenz schaffen: Wann wird KI eingesetzt, welche Daten werden verarbeitet, und wie werden Entscheidungen getroffen?

Bias und Diskriminierung sind nach wie vor brennende Themen. Multimodale Systeme können Vorurteile sowohl aus Text- als auch aus Bilddaten übernehmen. OpenAI und andere Anbieter investieren massiv in „AI Safety“, aber die Herausforderung bleibt komplex.

Die Zukunft liegt in der Balance: Maximaler Nutzen bei minimalen Risiken. Multimodale KI wird unseren Alltag revolutionieren – von der Art, wie wir arbeiten, bis hin zu unserem Umgang mit Information. Die Technologie ist da, jetzt liegt es an uns, sie weise zu nutzen.

Zuletzt aktualisiert am 19.02.2026