KI-basierte Gesichtserkennung ist heute allgegenwärtig – von Social Media bis zu staatlichen Überwachungssystemen. Je mehr Fotos von uns im Netz landen, desto gläserner werden wir. Doch es gibt Widerstand: Forscher entwickeln immer raffiniertere Methoden, um Gesichtserkennungs-Algorithmen auszutricksen. Die bekannteste ist „Fawkes“ – eine Software, die winzige, für Menschen unsichtbare Veränderungen an Fotos vornimmt und damit KI-Systeme komplett verwirrt.

Die Zeiten, in denen nur Masken vor Gesichtserkennung schützten, sind längst vorbei. Moderne KI-Systeme erkennen Menschen selbst mit Mundschutz zuverlässig – anhand der Augenpartie, der Stirn oder sogar der Gangart. Die Trefferquote aktueller Gesichtserkennungssysteme liegt bei über 99 Prozent, sie können mühelos Hunderte Millionen von Menschen unterscheiden.

Deshalb sind kommerzielle Suchmaschinen wie Clearview AI oder Pimeyes auch eine ernsthafte Bedrohung für unsere Privatsphäre: Diese Unternehmen durchforsten das gesamte Internet nach Fotos, erstellen riesige Datenbanken und bieten dann Gesichtssuche als Service an. Selbst wenn sie damit gegen Datenschutz-Vorschriften verstoßen – das Ende der Anonymität ist Realität geworden.

Die digitale Guy-Fawkes-Maske: Wie „Fawkes“ funktioniert

Was tun, wenn Gesetze und Behörden nicht ausreichen? Forscher der Universität Chicago haben bereits 2020 eine elegante Lösung entwickelt: den Algorithmus „Fawkes“, benannt nach Guy Fawkes, dem berühmten Widerstandskämpfer gegen die englische Krone. Wie die Guy-Fawkes-Masken, die Anonymous-Hacker oder Demonstranten tragen, soll auch diese Software die Identität schützen – nur virtuell und unsichtbar.

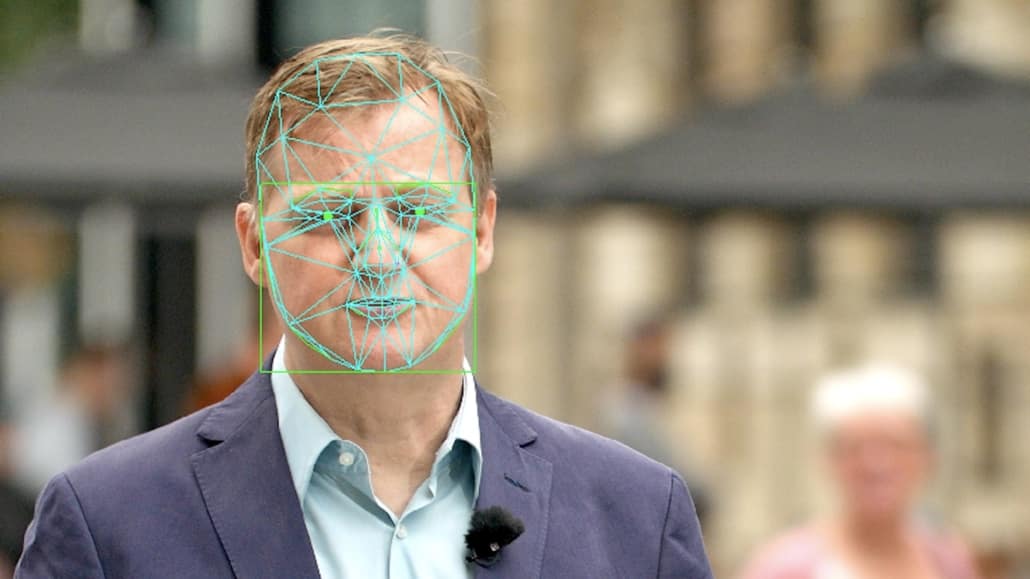

Der Algorithmus verändert Gesichtsfotos so minimal, dass Menschen keinen Unterschied sehen, Gesichtserkennungs-Systeme aber völlig durcheinander geraten. Wangenknochen werden um Bruchteile von Millimetern verschoben, Augenlider minimal verzerrt, Kinnlinien fast unmerklich angepasst. Diese winzigen Veränderungen reichen aus, um die biometrischen Referenzpunkte zu verfälschen, auf die KI-Systeme angewiesen sind.

Adversarial Training: Wenn KI gegen KI kämpft

Das Prinzip dahinter heißt „Adversarial Training“ – ein Wettrüsten zwischen zwei KI-Systemen. „Fawkes“ analysiert, wie Gesichtserkennungsalgorithmen funktionieren, und entwickelt dann gezielt Störungen, die diese Systeme ins Leere laufen lassen. Das ist wie ein digitaler Tarnmantel, der speziell gegen maschinelle Wahrnehmung entwickelt wurde.

Wer alle Fotos, die er auf Instagram, TikTok, LinkedIn oder Facebook hochlädt, vorher per „Fawkes“ bearbeitet, trainiert die Scanner gewissermaßen falsch. Neuronale Netze lernen aus Daten: Wenn sie Dutzende manipulierte Bilder einer Person sehen, merken sie sich ein falsches biometrisches Profil. Ein unbearbeitetes Foto derselben Person können sie dann nicht mehr zuordnen.

Die Grenzen des digitalen Schutzes

„Fawkes“ war ein Durchbruch, aber kein Allheilmittel. Die Software funktioniert nur, wenn sie konsequent bei allen hochgeladenen Fotos verwendet wird. Außerdem haben sich Gesichtserkennungssysteme weiterentwickelt. Moderne Algorithmen sind robuster gegen solche Angriffe geworden, verwenden mehrere Erkennungsmethoden parallel oder können adversariale Störungen teilweise herausfiltern.

Trotzdem haben die Chicagoer Forscher einen wichtigen Präzedenzfall geschaffen. Ihr kostenlos verfügbarer Algorithmus inspirierte eine ganze Generation von Privacy-Tools. Heute gibt es verschiedene Apps und Browser-Extensions, die ähnliche Techniken verwenden – von „Adversarial.io“ bis zu integrierten Funktionen in Messaging-Apps.

Der aktuelle Stand: Neue Tools, neue Herausforderungen

Seit 2020 ist viel passiert. Die EU-Datenschutzgrundverordnung wird strenger durchgesetzt, mehrere Länder haben kommerzielle Gesichtserkennung eingeschränkt. Gleichzeitig sind neue Akteure wie chinesische Tech-Konzerne mit noch leistungsfähigeren Systemen auf den Plan getreten.

Moderne Smartphones integrieren inzwischen Privacy-Features direkt ins Betriebssystem. Apples „Private Relay“ und Googles „Privacy Sandbox“ zeigen, dass auch große Tech-Unternehmen umdenken. Dennoch bleibt das Grundproblem bestehen: Wer seine Privatsphäre schützen will, muss aktiv werden.

Die Forschung geht weiter. Neue Ansätze wie „StyleGAN“-basierte Verzerrungen oder „Deepfake“-Schutztechnologien versprechen noch besseren Schutz. Das Wettrüsten zwischen Überwachung und Privatsphäre wird weitergehen – „Fawkes“ war nur der Anfang.

[av_video src=’https://vimeo.com/451424481′ mobile_image=“ attachment=“ attachment_size=“ format=’16-9′ width=’16‘ height=’9′ conditional_play=“ av_uid=’av-6syjnpw‘]

Zuletzt aktualisiert am 28.02.2026