Faktencheck-Bots für WhatsApp: Falschmeldungen sofort entlarven

Auch auf WhatsApp verbreiten sich krude Verschwörungstheorien und gefährliche Falschmeldungen – inzwischen nicht mehr nur zu Corona, sondern zu allen möglichen Themen. Von Impfungen über Klimawandel bis hin zu politischen Ereignissen. Doch wer hat schon Lust,...

KI-Manipulation in Social Media: Wie Deepfakes Wahlen beeinflussen

Soziale Netzwerke wie Meta (Facebook/Instagram), X (ehemals Twitter), TikTok und YouTube sind zu mächtigen Werkzeugen für Desinformation und Wahlmanipulation geworden. Künstliche Intelligenz macht es noch einfacher: 2025 haben KI-generierte Deepfakes und...

KI erstellt hyperrealistische Porträts von Menschen, die nie existiert haben

Künstliche Intelligenz (KI) hat eine neue Dimension der Bilderzeugung erreicht. Was früher Science-Fiction war, ist heute Realität: KI-Systeme erstellen hyperrealistische Porträtfotos von Menschen, die niemals gelebt haben. Diese Technologie hat sich seit 2019...

Deepfakes 2026: Erkennen, abwehren, überleben

Die Zeiten werden unheimlich: Deepfakes sind längst keine Science-Fiction mehr, sondern bittere Realität. Was früher Hollywood-Studios mit Millionenbudgets hinbekommen haben, schafft heute jeder mit dem Smartphone. Wir können Videos, Audios und Fotos nicht mehr trauen...

DeepFakes 2026: Wie KI Videos und Fotos perfekt fälscht

Es ist heute erschreckend einfach geworden, Fotos und Videos derart grundlegend zu verändern, dass sie nicht mehr die Wahrheit zeigen. Die Technologie ist so weit fortgeschritten, dass selbst Experten oft Schwierigkeiten haben zu erkennen: Hat jemand wirklich das...

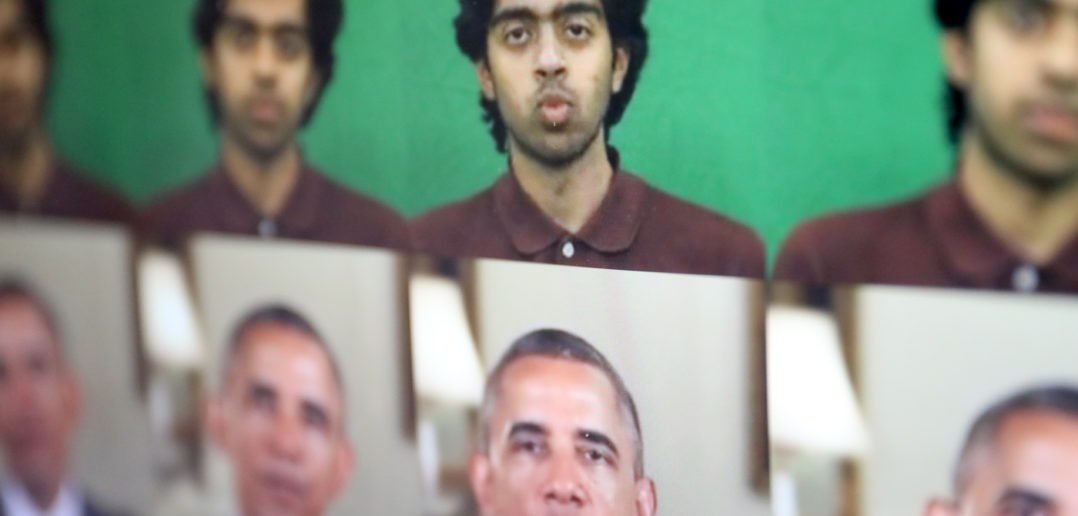

Fake-Videos werden immer überzeugender

Besser, man traut seinen Augen nicht: Heute lassen sich auch Videos leicht retuschieren oder manipulieren. Mehr als das: Selbst komplette Fake-Videos lassen sich heute herstellen. So lassen sich Prominenten so ziemlich alles in den Mund legen. Acht Forscher haben...