Der Kampf zwischen freier Meinungsäußerung und dem Schutz vor Desinformation wird immer komplexer. Der Fall #allesaufdentisch zeigt exemplarisch, wie schwierig die Content-Moderation für Plattformen geworden ist – und welche rechtlichen Grenzen Gerichte ihnen setzen.

Das Spannungsfeld zwischen freier Meinungsäußerung und der Bekämpfung von Desinformation hat sich seit 2021 dramatisch verschärft. Was damals mit #allesaufdentisch begann, ist heute zur zentralen Herausforderung der digitalen Gesellschaft geworden. Plattformen wie YouTube, TikTok und X (ehemals Twitter) stehen unter enormem Druck, schädliche Inhalte zu entfernen – müssen aber gleichzeitig rechtmäßige Meinungsäußerungen schützen.

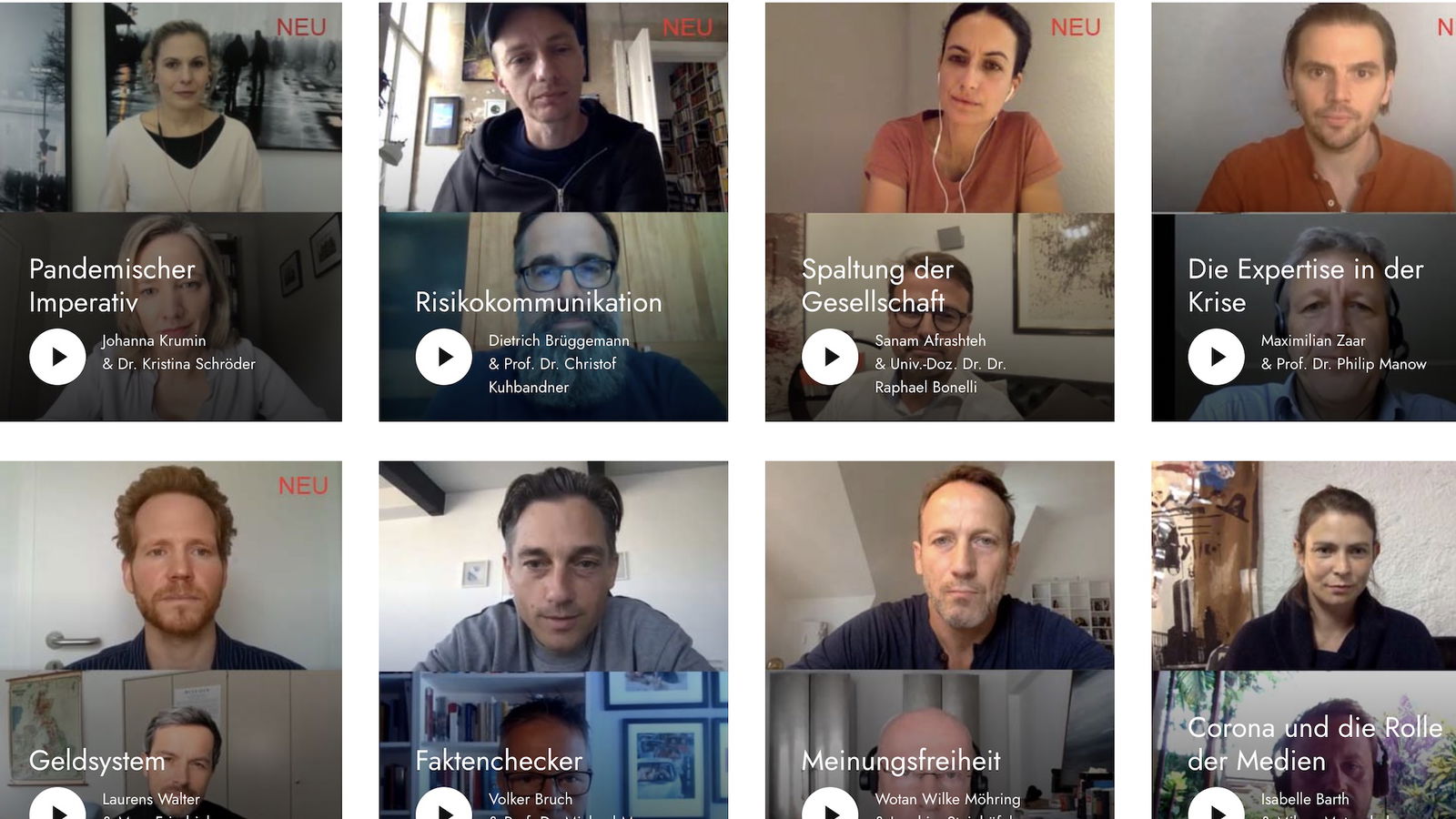

Der ursprüngliche Fall um die Initiative #allesaufdentisch war ein Wendepunkt: YouTube hatte Videos mit Gesprächen zwischen Künstlern und Wissenschaftlern gelöscht, das Landgericht Köln hob die Sperrung auf, woraufhin die Plattform andere Videos entfernte. Dieses Katz-und-Maus-Spiel wurde zum Präzedenzfall für die heutige Content-Moderation.

Wie sich Content-Moderation entwickelt hat

Seit 2022 haben sich die Regeln fundamental gewandelt. Der Digital Services Act (DSA) der EU verpflichtet große Plattformen zu transparenteren Moderationsprozessen. YouTube muss heute bei Löschungen konkret begründen, welche Passagen gegen welche Richtlinien verstoßen – eine direkte Folge der damaligen Gerichtsentscheidungen.

Die Plattformen setzen mittlerweile auf mehrschichtige Ansätze: KI-Systeme erkennen potentiell problematische Inhalte, menschliche Moderatoren prüfen Grenzfälle, und bei kontroversen Themen kommen externe Faktenchecker ins Spiel. TikTok führte 2023 „Community Notes“ ein, X erweiterte sein Programm für Nutzer-basierte Faktenchecks.

Besonders interessant ist die Entwicklung bei gesundheitsbezogenen Desinformationen. Während der Pandemie gingen Plattformen sehr restriktiv vor – heute sind die Algorithmen deutlich nuancierter geworden. Sie unterscheiden zwischen offensichtlich falschen medizinischen Behauptungen und legitimen wissenschaftlichen Diskussionen.

Der rechtliche Rahmen wird schärfer

Das Landgericht Köln hatte 2021 eine wichtige Weiche gestellt: Plattformen dürfen nicht ohne konkrete Begründung löschen. Der Bundesgerichtshof bestätigte diese Linie in mehreren Urteilen – nicht nur gegen Facebook, sondern auch gegen Instagram, TikTok und andere Dienste.

Heute ist die Rechtslage klarer, aber auch komplexer geworden. Das Netzwerkdurchsetzungsgesetz (NetzDG) wurde 2024 überarbeitet und sieht härtere Strafen für willkürliche Löschungen vor. Gleichzeitig müssen Plattformen bei „offensichtlich rechtswidrigen“ Inhalten schneller handeln.

Der Digital Services Act hat zusätzlich neue Transparenzpflichten eingeführt. Große Plattformen müssen halbjährlich Berichte über ihre Moderationsentscheidungen veröffentlichen. Diese Daten zeigen: Die Löschquote bei umstrittenen politischen Inhalten ist seit 2022 um etwa 30 Prozent gesunken – die Plattformen sind vorsichtiger geworden.

Neue Herausforderungen: KI und Deepfakes

Während sich die Debatte um #allesaufdentisch noch um klassische Video-Interviews drehte, stehen Plattformen heute vor völlig neuen Problemen. KI-generierte Inhalte, Deepfakes und synthetische Medien erschweren die Moderation erheblich.

YouTube hat 2024 eine Kennzeichnungspflicht für KI-generierte Inhalte eingeführt. TikTok nutzt eigene KI-Systeme, um gefälschte Videos zu erkennen. X experimentiert mit Community-basierten Ansätzen, bei denen Nutzer verdächtige Inhalte melden und bewerten können.

Besonders problematisch sind subtile Desinformationskampagnen, die geschickt Halbwahrheiten mit legitimen Diskussionen vermischen. Die Algorithmen haben gelernt, nicht mehr nur auf Schlagworte zu reagieren, sondern Kontext und Nuancen zu bewerten.

Zwischen Zensur und Verantwortung

Der ursprüngliche Vorwurf der #allesaufdentisch-Macher lautete, alternative wissenschaftliche Stimmen würden unterdrückt. Heute ist die Diskussion differenzierter geworden. Plattformen haben „Breathing Space“-Konzepte entwickelt: Bei kontroversen aber nicht eindeutig schädlichen Inhalten wird oft nur die Reichweite reduziert, statt komplett zu löschen.

Diese „Shadow Banning“ genannte Praxis ist rechtlich umstritten. Kritiker sehen darin eine versteckte Form der Zensur, Befürworter argumentieren, so könne man schädliche Inhalte eindämmen, ohne die Meinungsfreiheit zu beschneiden.

Die EU arbeitet an einem „Content Moderation Framework“, das europaweit einheitliche Standards schaffen soll. Dabei geht es auch um die Frage, ob Plattformen zur Förderung bestimmter Inhalte verpflichtet werden können – etwa wissenschaftlich fundierter Gesundheitsinformationen.

Die Zukunft der digitalen Meinungsfreiheit

Was mit #allesaufdentisch begann, ist zu einer grundsätzlichen Debatte über die Zukunft der digitalen Öffentlichkeit geworden. Die nächsten Jahre werden entscheidend sein: Schaffen wir es, einen Rahmen zu entwickeln, der sowohl freie Meinungsäußerung schützt als auch vor den Gefahren von Desinformation bewahrt?

Eines ist klar geworden: Die simplen Lösungen von früher – entweder alles erlauben oder rigoros löschen – funktionieren nicht mehr. Die Zukunft liegt in nuancierten, transparenten und demokratisch legitimierten Moderationsverfahren. Der Fall #allesaufdentisch war nur der Anfang einer Diskussion, die unsere digitale Gesellschaft noch lange beschäftigen wird.

Verschwörungserzählungen sind im Netz weit verbreitet und gefährlich

Zuletzt aktualisiert am 23.02.2026