Künstliche Intelligenz erstellt heute wie selbstverständlich Texte, Bilder oder Videos. Wie sollen wir noch unterscheiden, was vom Menschen ist und was von der Maschine? Die Idee: Ein Label für „made by humans“ – relevanter denn je.

Die rasant zunehmende Verbreitung von Künstlicher Intelligenz (KI) führt bei uns allen zur unvermeidlichen Frage: Kommt das von KI – oder ist das von einem Menschen gemacht?

KI kann heute beeindruckende und täuschend echte Bilder kreieren. Es reicht, wenn jemand aufschreibt, was er haben will. KI-Systeme wie DALL-E 3, Midjourney V6, Adobe Firefly, Stable Diffusion XL oder die neueren Modelle wie Flux und Imagen 3 erzeugen in kürzester Zeit erstaunliche Bilder. Sogar Video-KI wie OpenAI Sora, RunwayML oder Pika Labs erstellt mittlerweile fotorealistische Clips.

KI erzeugt immer mehr Inhalte – und das wird zu einem Problem

Bei manchen Produktionen sieht man gleich: Taugt nichts. Bei anderen ahnt man: Hat KI gemacht. Es gibt aber auch Bilder und Videos, da fällt es extrem schwer zu entscheiden, ob von Mensch oder Maschine. Und je besser die KI-Systeme werden, desto schwieriger wird das zu beantworten sein.

Das gilt für Texte genauso. Spätestens seit dem ungeheuren Erfolg von ChatGPT ist klar: KI kann auch Texte – und das verdammt gut. ChatGPT, Claude, Gemini oder die neueren Modelle wie GPT-4o und Claude 3.5 Sonnet machen das so gut, auch und besonders als Chatbots im Dialog, dass sie längst den „Turing Test“ bestanden haben. Bedeutet: Menschen können nicht mit Gewissheit sagen, ob sie gerade mit einem Menschen oder einer Maschine plaudern.

Und dann sind da noch die Audio-KI-Systeme: ElevenLabs, Murf oder Adobe’s Voice Synthesis können Stimmen klonen und täuschend echte Sprachaufnahmen erstellen. Sogar Musik wird mittlerweile von KI komponiert – Suno, Udio oder AIVA machen’s möglich.

All das hat massive Konsequenzen. Ist der Text hier von einer Maschine geschrieben – oder von einem Menschen?

Damit wir Konsumenten eine Orientierung haben, gibt es verschiedene Ansätze. Unter notbyai gibt es Banner zum Download, die jede(r) auf seiner Webseite oder auf seine digitalen Produkte pappen kann, um zu erklären: Das ist menschengemacht. Die Initiative hat sich mittlerweile zu einer regelrechten Bewegung entwickelt.

Bedingung ist, dass wenigstens 90% des Contents von Menschen kommen. Ein bisschen darf man sich also sogar helfen lassen – etwa bei der Recherche oder beim Brainstorming.

Die Zertifizierungs-Landschaft wächst

Mittlerweile haben sich weitere Standards etabliert. Die Content Authenticity Initiative (CAI) von Adobe arbeitet mit großen Medienunternehmen zusammen, um eine Art „digitalen Fingerabdruck“ für Inhalte zu schaffen. Auch Tech-Giganten wie Google, Microsoft und Meta haben eigene Kennzeichnungssysteme entwickelt.

Die EU arbeitet zudem am AI Act, der ab 2026 vollständig in Kraft tritt und Transparenz-Pflichten für KI-generierte Inhalte vorsieht. Plattformen müssen dann deutlich kennzeichnen, wenn Inhalte von KI stammen.

Warum das wichtig ist

Experten schätzen, dass bereits über 50 Prozent der Online-Inhalte von KI generiert sind – Tendenz stark steigend. Bis 2027 könnte dieser Anteil auf über 90 Prozent anwachsen.

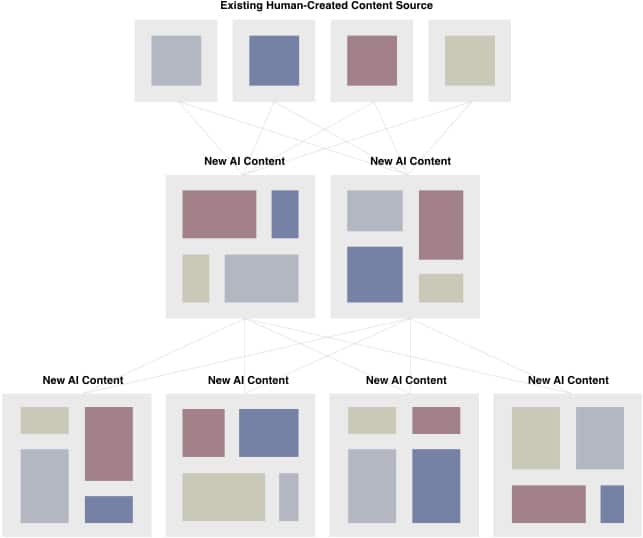

Ein massives Problem. Denn bei der Zunahme von KI-generierten Inhalten ist es wichtig zu beachten, dass KI auf von Menschen generierten Inhalten trainiert wird. Wenn sich Menschen bei der Generierung von Inhalten in Zukunft ausschließlich auf KI verlassen, könnte es sich bei neuen, von KI generierten Inhalten lediglich um recycelte Inhalte aus der Vergangenheit handeln – ein Phänomen, das Forscher „Model Collapse“ nennen.

Dies könnte ein großes Hindernis für den menschlichen Fortschritt darstellen. Nur wenn wir die Abhängigkeit von der KI einschränken und weiterhin originelle Inhalte schaffen, können wir als Spezies vorankommen.

Dazu kommt: In einer Welt voller KI-Content wird menschlich erstellter Content wieder wertvoller. Authentizität wird zum Luxusgut. Viele Leser sind bereits heute bereit, mehr für garantiert menschengemachte Inhalte zu zahlen.

Wie ihr euch schützen könnt

Als Konsumenten solltet ihr kritisch bleiben. Fragt nach der Quelle, prüft Inhalte auf Plausibilität und nutzt Tools wie AI-Detektoren – auch wenn diese nicht hundertprozentig zuverlässig sind.

Als Content-Ersteller könnt ihr euch mit Labels wie „Human Made“ positionieren. Das schafft Vertrauen und Differenzierung im Markt.

Ich finde diese Entwicklung wichtig – und habe deshalb auch schieb.de mit entsprechenden Kennzeichnungen versehen. Transparenz ist der Schlüssel in einer Welt, in der die Grenzen zwischen menschlicher und maschineller Kreativität verschwimmen.

Zuletzt aktualisiert am 19.02.2026