Face Swap Apps: Sie ermöglichen es, die eigenen Gesichter oder die von Freunden in die Szene eines Actionfilms einzusetzen – aus Gaudi! Aber leider wird die KI-Technologie immer öfter auch missbraucht – mit schlimmen Folgen.

Face-Swap-Technologie ist längst Mainstream geworden. Was früher Hollywood-Studios mit Millionenbudgets vorbehalten war, macht heute jede Smartphone-App in Sekunden. Die Technik dahinter wird immer raffinierter – und leider auch der Missbrauch.

Während wir uns noch über verjüngte Schauspieler in Blockbustern wundern, produzieren KI-Systeme bereits täuschend echte Fake-Videos von Politikern, Celebrities und ganz normalen Menschen. Das Problem: Die Grenze zwischen harmlosen Spaß-Filtern und kriminellem Missbrauch verschwimmt zusehends.

Besonders alarmierend ist die Zunahme nicht-konsensueller pornographischer Deepfakes. Laut aktuellen Studien sind über 95% aller Deepfake-Videos pornographischen Inhalts, wobei fast ausschließlich Frauen betroffen sind. Die gemeinnützige Organisation HateAid warnt vor dieser dramatischen Entwicklung.

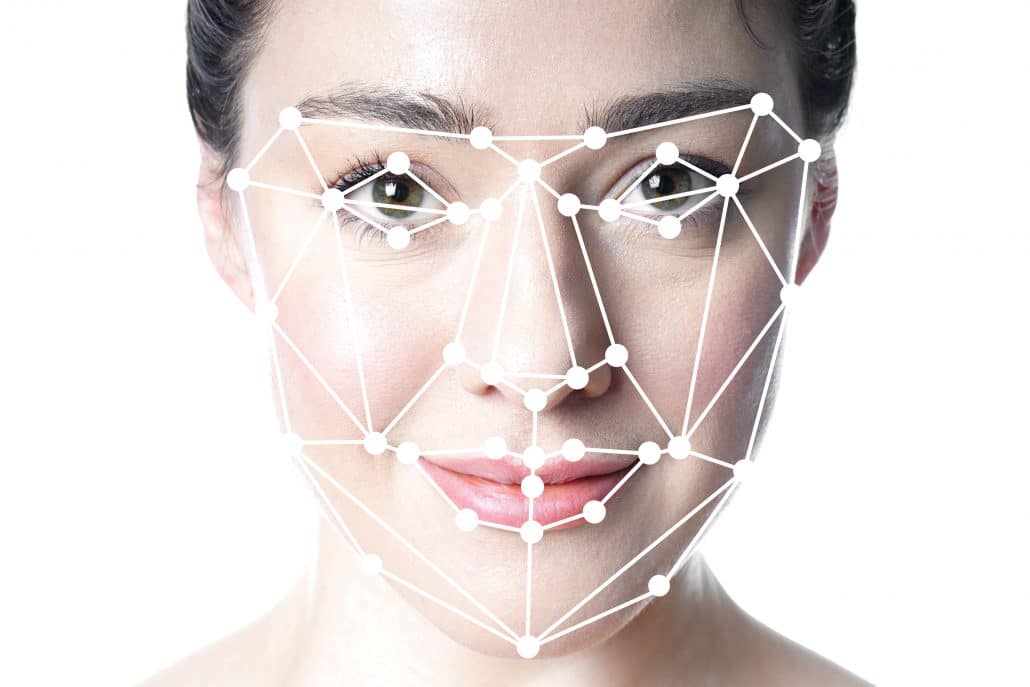

Jedes Gesicht hat Tausende von Punkten, die von der KI vermessen werden

So funktioniert Face Swap heute

Die Technik hat sich seit 2024 dramatisch weiterentwickelt. Moderne KI-Systeme analysieren nicht nur statische Gesichtsmerkmale, sondern erfassen dynamische Eigenschaften: Mimik, Sprachmuster, sogar individuelle Bewegungsabläufe.

Die KI scannt dabei bis zu 70.000 Referenzpunkte pro Gesicht – deutlich mehr als frühere Systeme. Augenabstand, Nasenwurzel, Kinnlinie, Hautstruktur, sogar kleinste Asymmetrien werden erfasst. Daraus entsteht ein hochpräzises 3D-Modell, das auf praktisch jedes Zielvideo angewendet werden kann.

Besonders raffiniert: Aktuelle Systeme können auch bei schwierigen Lichtverhältnissen, Seitenansichten oder teilweise verdeckten Gesichtern überzeugende Ergebnisse erzielen. Real-Time Face Swap funktioniert mittlerweile sogar live in Videokonferenzen – ein Albtraum für die Authentizität digitaler Kommunikation.

Die neuesten Generative Adversarial Networks (GANs) arbeiten so präzise, dass selbst Experten Schwierigkeiten haben, Fakes auf den ersten Blick zu erkennen. Ein einziges Profilbild aus sozialen Medien reicht oft schon aus.

Missbrauch: Gesichter von Frauen werden auf nackte Körper montiert

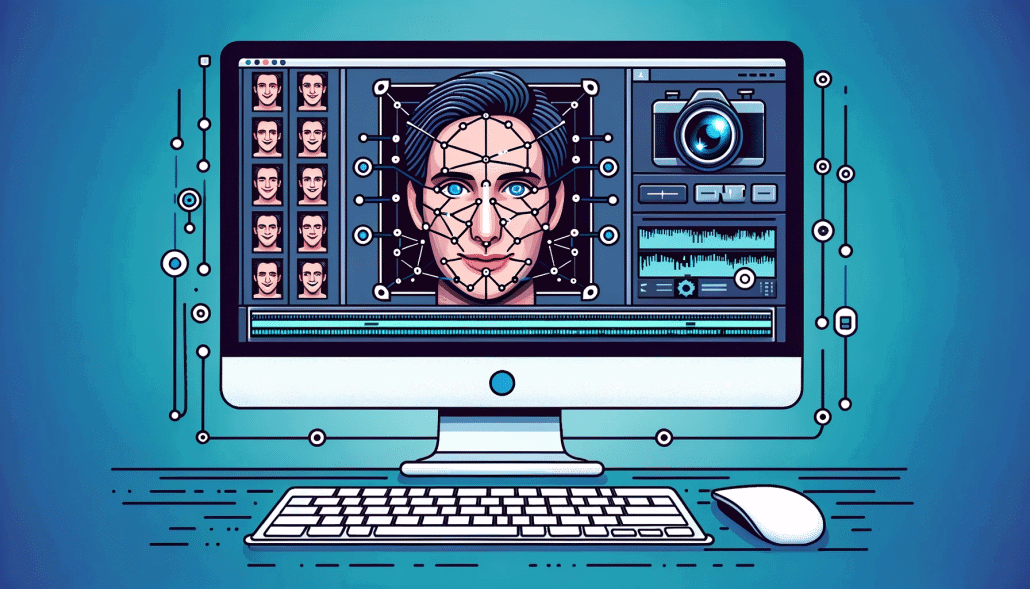

KI erzeugt heute Hollywood-Qualität

Die Qualitätssprünge der letzten zwei Jahre sind beeindruckend. Was 2024 noch Stunden Rechenzeit brauchte, schaffen aktuelle Cloud-basierte Services in wenigen Minuten. Einige Apps versprechen sogar „One-Click-Deepfakes“ – ein bedenklicher Trend.

Entscheidend für die Qualität sind mehrere Faktoren: Die Auflösung des Quellmaterials, Beleuchtung, Gesichtswinkel und natürlich die verwendete KI-Engine. Premium-Services arbeiten mit 4K-Auflösung und berücksichtigen sogar Hautporen und Mikroexpressionen.

Besonders problematisch: Mobile Apps demokratisieren die Technologie. Was früher technisches Know-how erforderte, macht heute jeder Teenager mit seinem Smartphone. Die Hemmschwelle für Missbrauch sinkt dramatisch.

Die neuesten KI-Modelle können auch Stimmen synchron zum Gesichtstausch anpassen. Voice Cloning in Kombination mit Face Swap erzeugt Inhalte, die praktisch nicht mehr von echten Aufnahmen zu unterscheiden sind.

Deepfakes haben heute eine erstaunliche Qualität

Der dunkle Missbrauch nimmt zu

Was als harmloser Spaß begann, entwickelt sich zur ernsten Bedrohung. Image-based Sexual Abuse durch KI explodiert förmlich. Studien zeigen: Alle 96 Minuten wird eine neue Person Opfer von Deepfake-Pornographie.

Besonders perfide: Kriminelle nutzen die Technik für Erpressung. Ein manipuliertes Compromat-Video reicht, um Karrieren zu zerstören oder Lösegelder zu erpressen. Politische Deepfakes während Wahlkämpfen werden zur realen Gefahr für demokratische Prozesse.

Neu ist auch der Trend zu „Deepfake as a Service“ – kommerzielle Plattformen, die anonymen Missbrauch gegen Bezahlung anbieten. Diese Services operieren oft in rechtlichen Grauzonen oder von Ländern ohne entsprechende Gesetze.

Cybermobbing bekommt eine neue Dimension: Schüler erstellen kompromittierende Fake-Videos von Mitschülern. Die psychischen Folgen sind verheerend, auch wenn die Manipulation später aufgedeckt wird.

Deepfake-Erkennung: Der Wettlauf hat begonnen

Forscher entwickeln fieberhaft Erkennungstechnologien. Aktuelle Detection-Tools analysieren Inkonsistenzen in Pixelmustern, unnatürliche Augenbewegungen oder physiologisch unmögliche Lichtverhältnisse. Doch es ist ein Katz-und-Maus-Spiel.

Problematisch: Während Detection-KI lernt, Fakes zu erkennen, lernen Generator-KIs gleichzeitig, diese Erkennungsmerkmale zu umgehen. Adversarial Training macht Deepfakes immer raffinierter.

Einige Plattformen integrieren bereits automatische Deepfake-Erkennung. TikTok, Twitter/X und Meta investieren Millionen in entsprechende Technologien. Doch kleinere Plattformen und private Chats bleiben ungefiltert.

Vielversprechend sind Blockchain-basierte Authentifizierungssysteme. Diese erstellen kryptographische Signaturen für echte Inhalte – doch die Implementierung steht noch am Anfang.

Provenance-Technologien wie C2PA (Coalition for Content Provenance and Authenticity) werden 2026 zunehmend Standard. Kameras und Smartphones beginnen, Metadaten zu signieren, die Manipulationen nachweisbar machen.

Schutz und rechtliche Entwicklungen

Die Gesetzgebung reagiert langsam, aber stetig. Das deutsche Strafgesetzbuch wurde 2024 um spezifische Deepfake-Paragrafen erweitert. Auch die EU plant schärfere Regulierungen im Rahmen des AI Acts.

Vorbeugende Maßnahmen werden wichtiger: Viele Experten empfehlen, Profilbilder bewusst zu wählen und die Privatsphäre-Einstellungen sozialer Medien zu verschärfen. Weniger öffentlich verfügbare Bilder bedeuten weniger Angriffsfläche.

Medienbildung wird essentiell. Schon Jugendliche müssen lernen, kritisch zu hinterfragen, was sie online sehen. Der Grundsatz „Don’t trust, verify“ wird zur digitalen Überlebensstrategie.

Opfer-Hilfsorganisationen wie HateAid bieten mittlerweile spezialisierte Beratung. Wichtig: Deepfake-Opfer sollten Screenshots sichern, Strafanzeige erstatten und rechtliche Schritte prüfen – auch wenn die Erfolgsaussichten noch begrenzt sind.

Zuletzt aktualisiert am 17.02.2026