Extremistische Gewalt und Online-Radikalisierung nehmen zu. Wie Soziale Netzwerke und Messenger-Dienste zur Verrohung der Gesellschaft beitragen.

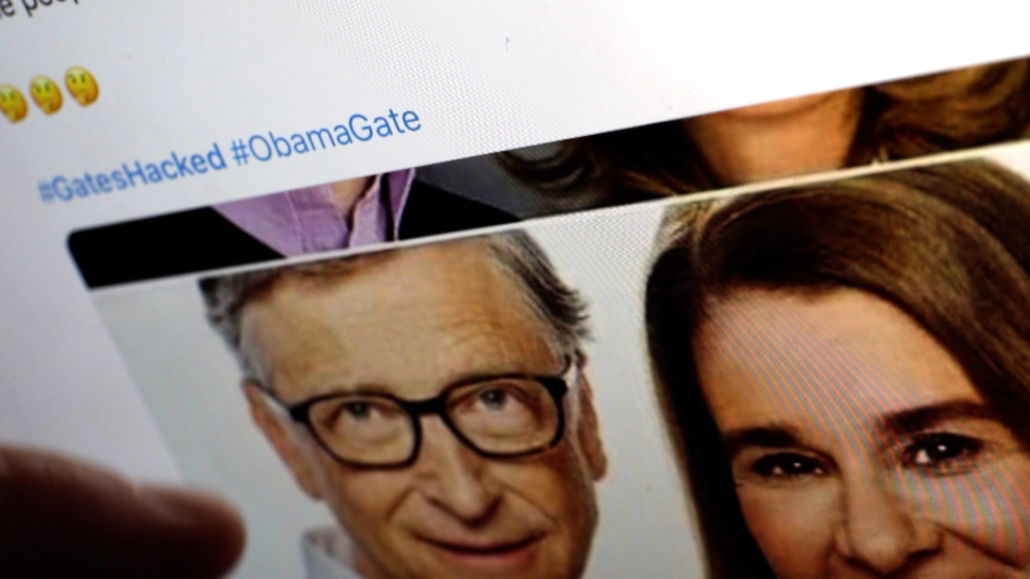

Der Fall aus Idar-Oberstein von 2021 war ein Wendepunkt: Ein Tankstellenmitarbeiter wurde erschossen, weil er einen Maskenverweigerer an Corona-Regeln erinnerte. Der Täter hatte sich zuvor in rechtsextremen Online-Communities radikalisiert. Drei Jahre später ist das Problem noch größer geworden. Verschwörungsgeschichten erreichen über Soziale Netzwerke Millionen Menschen – mit realen, oft tödlichen Folgen.

Die Polizei untersucht heute routinemäßig Social Media Profile von Gewalttätern. Was sie findet, ist ein Muster aus Hass, Desinformation und zunehmender Radikalisierung.

Wie Algorithmen Extremismus verstärken

Social Media Algorithmen sind darauf programmiert, Engagement zu maximieren. Emotionale, kontroverse Inhalte werden bevorzugt – auch extremistische. Wer einmal auf verschwörungstheoretische Inhalte klickt, bekommt immer mehr davon vorgeschlagen. Diese „Radikalisierungsschleifen“ sind gut dokumentiert: YouTube führte Nutzer vom Klimawandel-Skeptizismus zu Holocaust-Leugnung, TikTok von harmlosen Inhalten zu extremistischen Ideologien.

Meta (Facebook, Instagram) und andere Plattformen haben zwar Gegenmaßnahmen eingeführt, aber diese greifen oft zu spät. Bis ein extremistischer Kanal gesperrt wird, hat er bereits Tausende erreicht. Und die Akteure weichen einfach auf andere Plattformen aus.

»2024 verzeichneten deutsche Sicherheitsbehörden einen Anstieg politisch motivierter Gewalttaten um 23 Prozent – viele mit direktem Bezug zu Online-Radikalisierung«

Telegram und alternative Plattformen als Brandbeschleuniger

Telegram ist nach wie vor das Hauptproblem. Der Messenger unterliegt weiterhin nicht vollständig dem Netzwerkdurchsetzungsgesetz. Seit 2021 haben sich dort extremistische Communities weiter radikalisiert. Nach dem Hamas-Angriff auf Israel, dem Ukraine-Krieg und verschiedenen Terroranschlägen feiern Nutzer dort regelmäßig Gewalt gegen Zivilisten.

Neue Plattformen wie Truth Social, Gettr oder Parler ziehen bewusst extremistische Nutzer an. Sie werben mit „Meinungsfreiheit“ – meinen aber oft die Freiheit zu Hetze und Gewaltaufrufen. Auch dezentrale Plattformen wie Mastodon oder Nostr werden zunehmend von extremistischen Gruppen genutzt, die sich der Moderation entziehen wollen.

KI macht Desinformation perfekter

Künstliche Intelligenz hat die Desinformation revolutioniert. Deepfake-Videos von Politikern, KI-generierte „Beweise“ für Verschwörungstheorien und automatisierte Fake-Profile fluten die Netzwerke. ChatGPT und andere KI-Tools werden missbraucht, um überzeugende Propaganda zu erstellen.

Besonders perfide: KI-gesteuerte Chatbots in extremistischen Communities, die neue Mitglieder gezielt radikalisieren. Sie erkennen psychische Vulnerabilität und passen ihre Manipulation entsprechend an. Einsame, frustrierte Menschen werden systematisch in extremistische Ideologien hineingezogen.

Die Psychologie der Online-Radikalisierung

Moderne Extremisten nutzen ausgeklügelte psychologische Methoden. Sie beginnen mit harmlosen Inhalten, die Zweifel säen („Stellt kritische Fragen“), und steigern sich schrittweise zu extremistischen Positionen. Diese „Pipeline“-Strategie ist besonders auf YouTube und TikTok erfolgreich.

Verschwörungstheorien bieten einfache Antworten auf komplexe Probleme. Sie vermitteln das Gefühl, zu einer erleuchteten Gruppe zu gehören, die „die Wahrheit“ kennt. Das ist attraktiv für Menschen, die sich machtlos oder isoliert fühlen.

Was Plattformen tun – und was nicht

Der Digital Services Act der EU zwingt große Plattformen seit 2024 zu mehr Transparenz. Sie müssen extremistische Inhalte schneller entfernen und ihre Algorithmen offenlegen. Trotzdem ist die Umsetzung mangelhaft.

X (ehemals Twitter) unter Elon Musk hat Moderation sogar bewusst reduziert. Viele zuvor gesperrte extremistische Accounts wurden reaktiviert. Die Plattform ist zum Sammelbecken für Desinformation und Hetze geworden.

TikTok kämpft mit chinesischen Einfluss-Operationen und russischer Propaganda. Instagram wird von koordinierten Desinformations-Kampagnen geflutet. Die Plattformen sind der Herausforderung nicht gewachsen.

Gesellschaftliche Spaltung verstärkt das Problem

Die Polarisierung der Gesellschaft macht Menschen anfälliger für Extremismus. Links- und Rechtsextreme nutzen dieselben Strategien: Sie schaffen In- und Out-Groups, dämonisieren Andersdenkende und rechtfertigen Gewalt als „Notwehr“.

Das CeMAS (Zentrum für Monitoring, Analyse und Strategie) dokumentiert diese Entwicklungen. Ihre Analysen zeigen: Extremistische Narrative werden zunehmend in der politischen Mitte salonfähig. Was früher am Rand stand, wird heute in Talkshows diskutiert.

Lösungsansätze für die Zukunft

Effektive Gegenmaßnahmen brauchen mehrere Ebenen: Bessere Algorithmen, die Qualität statt Engagement belohnen. Verpflichtende Medienkompetenz-Bildung in Schulen. Professionelle Aussteiger-Programme für Radikalisierte.

Wichtig ist auch: Alternative Narrative anbieten. Menschen brauchen Sinn, Gemeinschaft und Hoffnung. Wenn demokratische Gesellschaften das nicht liefern, suchen sie es bei Extremisten.

Die Bekämpfung von Online-Radikalisierung ist eine der wichtigsten Aufgaben unserer Zeit. Es geht nicht nur um Meinungsfreiheit versus Sicherheit – es geht um die Zukunft der Demokratie.

Zuletzt aktualisiert am 23.02.2026