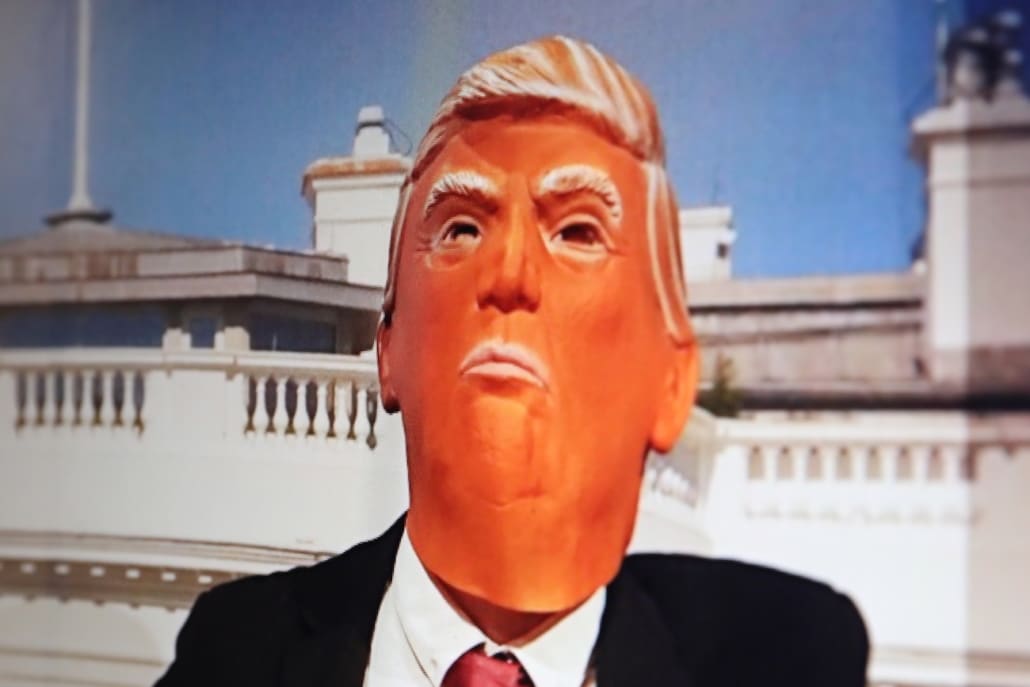

Die Bilder vom 6. Januar 2021 in Washington D.C. bleiben ein Wendepunkt: Der aufgeheizte Mob stürmt das Kapitol – und dringt sogar ins Gebäude ein. Die Sozialen Medien haben zweifellos eine entscheidende Rolle dabei gespielt. Aber welche? Nach dem Sturm aufs Kapitol wurden zum ersten Mal die Social Media Accounts von Donald Trump gesperrt. Was ist passiert – und was haben wir daraus gelernt?

Nach dem Angriff auf das Kapitol begann eine intensive Diskussion über die Rolle der sogenannten Sozialen Medien. Zu Recht?

Soziale Medien selbst verbreiten keinen Hass und keine Hetze – aber sie ermöglichen und verstärken sie exponentiell. Deswegen sind sie Teil des Problems, nicht Teil der Lösung. Trumps gebetsmühlenartige Wiederholung, die US-Wahl sei gestohlen, hatte verheerende Auswirkungen. Auf Plattformen wie X (ehemals Twitter), Facebook, TikTok, Instagram und Co. kursieren solche Behauptungen oft unwidersprochen und ohne Einordnung – wie Fakten.

Das hat selbstverständlich eine Wirkung – eine verheerende. Algorithmen verstärken diese Echokammern-Effekte noch zusätzlich. Jeder hält sich auf den Plattformen in Filterblasen auf – hört und liest vor allem das, was er oder sie hören will. Das spaltet die Gesellschaft nachhaltig. Keine neue Erkenntnis, aber mit dem Sturm aufs Kapitol wurde das überdeutlich – und bleibt als mahnendes Beispiel in Erinnerung.

Auch bei uns längst Realität

Aber ist das ein Problem, das wir nur in den USA haben – oder auch bei uns?

Wir haben hier genau dieselben Probleme. Zwar haben wir keinen Bundeskanzler, der über X hetzt – aber es mangelt nicht an Hass und Hetze im Netz. Die Corona-Pandemie, der Ukraine-Krieg, die Klimadebatte: Überall entstehen radikale Online-Communities, die Verschwörungstheorien verbreiten.

Nehmen wir Telegram als Beispiel: Die Plattform wurde während der Pandemie zum bevorzugten Medium für Querdenker und Impfgegner. Ohne diese digitalen Verstärker hätten solche Bewegungen niemals derart schnell Millionen erreicht. Das macht schon deutlich, welche Brisanz in diesen Werkzeugen steckt.

Besonders problematisch: Die Algorithmen der Plattformen belohnen emotionale, oft extreme Inhalte mit höherer Reichweite. Wut und Empörung generieren mehr Engagement als sachliche Diskussionen – ein systemisches Problem.

Was haben wir aus 2021 gelernt?

Nach dem Kapitol-Sturm sperrten Facebook, Twitter, Snapchat und Instagram den Account von Donald Trump – teilweise dauerhaft.

Doch war das die richtige Antwort? Es wurde überdeutlich, dass die Plattformen keinen wirklichen Plan hatten. Jahrelang tolerierten sie Trumps hetzerische Tweets, weil er als Präsident „newsworthy“ war. Erst als die Lage eskalierte, reagierten sie – viel zu spät.

Heute, fünf Jahre später, sehen wir: Das Problem ist nicht verschwunden. Elon Musks Übernahme von Twitter (jetzt X) führte zu einer Lockerung der Moderationsrichtlinien. Trump ist zurück auf der Plattform. Gleichzeitig entstehen neue Plattformen wie Truth Social oder Parler, die explizit „freie Meinungsäußerung“ ohne Moderation versprechen.

Der Digital Services Act: Europas Antwort

Die Community-Regeln der Netzwerke allein reichen definitiv nicht aus. Aber Europa hat reagiert.

Seit August 2023 gilt der Digital Services Act (DSA) der EU. Große Plattformen müssen jetzt transparenter über ihre Algorithmen sein, illegale Inhalte schneller löschen und unabhängige Risikobewertungen durchführen. Bei Verstößen drohen Strafen bis zu sechs Prozent des weltweiten Umsatzes.

Das ist ein wichtiger Schritt, aber noch längst nicht genug. Der DSA fokussiert auf illegale Inhalte – aber was ist mit legalen, aber gesellschaftlich schädlichen Falschinformationen? Hier bewegen wir uns in einem Spannungsfeld zwischen Meinungsfreiheit und Schutz der Demokratie.

KI macht alles komplizierter

Ein neues Problem verschärft die Lage: Generative KI. Deep Fakes werden immer perfekter und einfacher zu erstellen. Bald kann jeder täuschend echte Videos von Politikern produzieren. Bereits jetzt kursieren KI-generierte Bilder und Audio-Aufnahmen, die schwer von echten zu unterscheiden sind.

Content-Moderation wird dadurch exponentiell schwieriger. Plattformen müssen nicht nur prüfen, ob etwas wahr oder falsch ist, sondern auch, ob es überhaupt echt ist. Das überfordert sowohl automatische Systeme als auch menschliche Moderatoren.

Lösungsansätze für die Zukunft

Was brauchen wir also? Keine einfachen Antworten, aber einige konkrete Ansätze:

Erstens: Algorithmus-Transparenz. Nutzer sollten verstehen, warum ihnen bestimmte Inhalte gezeigt werden – und alternative Algorithmen wählen können.

Zweitens: Unabhängige Fact-Checking-Institutionen mit direkter API-Anbindung an die Plattformen. Falschinformationen könnten so binnen Minuten markiert werden.

Drittens: Digitale Medienkompetenz als Pflichtfach in Schulen. Nur wer versteht, wie Algorithmen funktionieren, kann sich davor schützen.

Viertens: Diversität in Empfehlungsalgorithmen. Statt nur ähnliche Meinungen zu zeigen, sollten Plattformen bewusst verschiedene Perspektiven präsentieren.

Das wird nicht einfach. Aber mit Politikern wie der ehemaligen EU-Kommissarin Margrethe Vestager haben wir gezeigt: Europa kann sich durchaus mit den Tech-Giganten anlegen. Der DSA war erst der Anfang. Es bleibt zu hoffen, dass wir aus den Ereignissen von 2021 die richtigen Lehren ziehen – bevor es wieder zu spät ist.

Zuletzt aktualisiert am 26.02.2026