Mit Hilfe von KI lassen sich heute täuschend echte Fotos, Videos und Audios erzeugen. Der Aufwand für solche „Deep Fakes“ wird immer geringer – und die Qualität immer besser. Neue Tools wie Sora, RunwayML und sogar Smartphone-Apps können binnen Minuten überzeugende Fälschungen erstellen. Das ist technisch faszinierend, aber gesellschaftlich brandgefährlich.

So manche Überzeugung sollten wir dringend überdenken. Etwa das weit verbreitete Prinzip: „Ich glaube nur, was ich mit eigenen Augen sehe!“

Das war zwar auch in der Vergangenheit schon nicht immer ein optimaler Zugang zur Welt, wird aber heute mehr denn je zum gefährlichen Trugschluss. Denn KI gaukelt uns eine Welt vor, die so gar nicht existiert – aber unglaublich real aussieht. In Zeiten von Desinformation und polarisierten Gesellschaften ist das explosiv.

Deep Fakes 2026: KI täuscht uns mühelos und in Echtzeit

Die Rede ist von Deep-Fakes: So werden Fotos, Videos und Audios genannt, die zwar echt aussehen und sich auch so anhören – aber komplett künstlich erzeugt sind. Fälschungen aus dem Computer, die heute kaum noch von echten Aufnahmen zu unterscheiden sind.

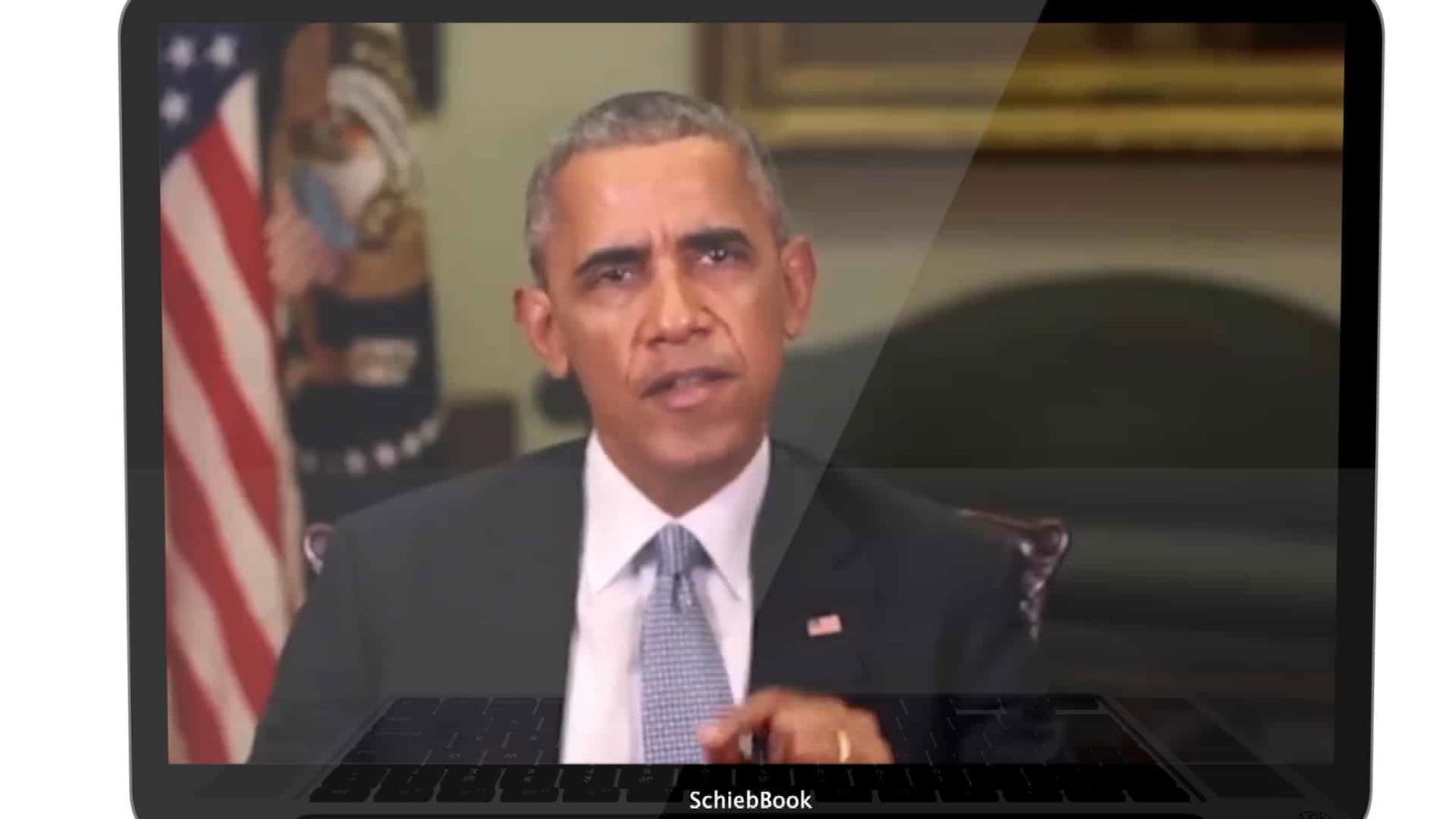

Mit Hilfe Künstlicher Intelligenz lassen sich heute verblüffend realistische Videos erzeugen, die jeden Betrachter überzeugen: Da sitzt Barack Obama und sagt in seinem unverwechselbaren Slang den Satz „Donald Trump is a totally and complete Dip Shit“.

Was vor Jahren noch Experten der Washington University vorbehalten war, können heute auch Hobby-Nutzer. Tools wie Runway ML, Synthesia oder die neuen Video-KI-Modelle von OpenAI und Google machen es möglich. Noch problematischer: Auch Echtzeit-Deep-Fakes sind längst Realität geworden.

Jens Spahn als Forrest Gump Fake

Neue Dimensionen der Manipulation

Die Entwicklung ist rasant: Während frühe Deep-Fakes noch stundenlange Berechnungen brauchten, erzeugen moderne KI-Tools wie FaceSwapper, Reface oder die integrierten Features in Adobe Creative Suite Videos in Minuten. Besonders brisant: Voice-Cloning-Tools wie ElevenLabs oder Murf können mit wenigen Sekunden Originalaufnahme täuschend echte Stimmen-Klone erstellen.

Fake-Videos, die praktisch alles behaupten können, sind geeignet, Gesellschaften zu spalten, Verwirrung zu stiften und den demokratischen Diskurs zu untergraben. Stellt euch vor: Videos kursieren, die Politiker bei vertraulichen Aussagen zeigen, die nie stattgefunden haben. Oder Wirtschaftsführer, die Unternehmensnachrichten verkünden, die Aktienkurse zum Absturz bringen.

Deep Fakes als Waffe der Desinformation

Die Folgen sind dramatisch: Welche Beweiskraft haben Videoaufnahmen noch, wenn sich alles täuschend echt fälschen lässt? Wie sollen Journalisten arbeiten, wenn Videos nicht mehr als vertrauensvolle Quellen gelten können?

Experten schätzen, dass sich die Zahl der Deep-Fakes alle vier Monate verdoppelt. Die Qualität verbessert sich exponentiell – während die Erkennungstools hinterherhinken. Sensity AI dokumentiert bereits über 85.000 Deep-Fake-Videos im Netz, Tendenz stark steigend.

Besonders perfide: Deep-Fakes werden gezielt für politische Manipulation eingesetzt. In den USA kursierten vor den Wahlen 2024 gefälschte Videos von Kandidaten. In der Ukraine entstanden Fake-Videos von Präsident Selenskyj, die zur Kapitulation aufrufen sollten.

Der Kampf gegen die Fälschungen

Tech-Konzerne reagieren: Meta, Google und Microsoft entwickeln Detection-Tools, die Deep-Fakes automatisch erkennen sollen. Die EU arbeitet an strengeren Regulierungen – der AI Act von 2024 klassifiziert täuschende Deep-Fakes als Hochrisiko-Anwendung.

Doch es bleibt ein Katz-und-Maus-Spiel: Kaum werden Erkennungsalgorithmen besser, entwickeln sich auch die Fälschungstools weiter. Watermarking-Technologien, die echte von gefälschten Inhalten unterscheiden helfen, sind noch nicht flächendeckend im Einsatz.

Medien-Literacy wird zur Überlebensstrategie: Wir müssen lernen, kritischer hinzuschauen, Quellen zu prüfen und verdächtige Inhalte zu hinterfragen. Faktenchecker und Verification-Tools werden unverzichtbar.

[av_video src=’https://vimeo.com/495729883′ mobile_image=“ attachment=“ attachment_size=“ format=’16-9′ width=’16‘ height=’9′ conditional_play=“ av_uid=’av-8i1uxo5′]

Netzpolitig.org-Frontmann Markus Beckedahl mit einem interessanten Vorschlag

Was können wir tun?

Der Umgang mit Deep-Fakes erfordert einen Mix aus technischen, rechtlichen und gesellschaftlichen Lösungen:

- Technologie: Bessere Erkennungstools und verpflichtende Kennzeichnung von KI-generierten Inhalten

- Regulierung: Klare rechtliche Rahmen für den Missbrauch von Deep-Fakes

- Bildung: Media Literacy als Grundausstattung für alle Bürger

- Plattform-Verantwortung: Social Media-Konzerne müssen konsequenter gegen Fake-Content vorgehen

Die Zeit drängt: Je länger wir warten, desto schwieriger wird es, die Kontrolle über Wahrheit und Manipulation zu behalten. Deep-Fakes sind längst keine Science-Fiction mehr – sie sind alltägliche Realität geworden.

Zuletzt aktualisiert am 26.02.2026