Die EU zwingt ChatGPT & Co. zur Transparenz – und das könnte alles ändern

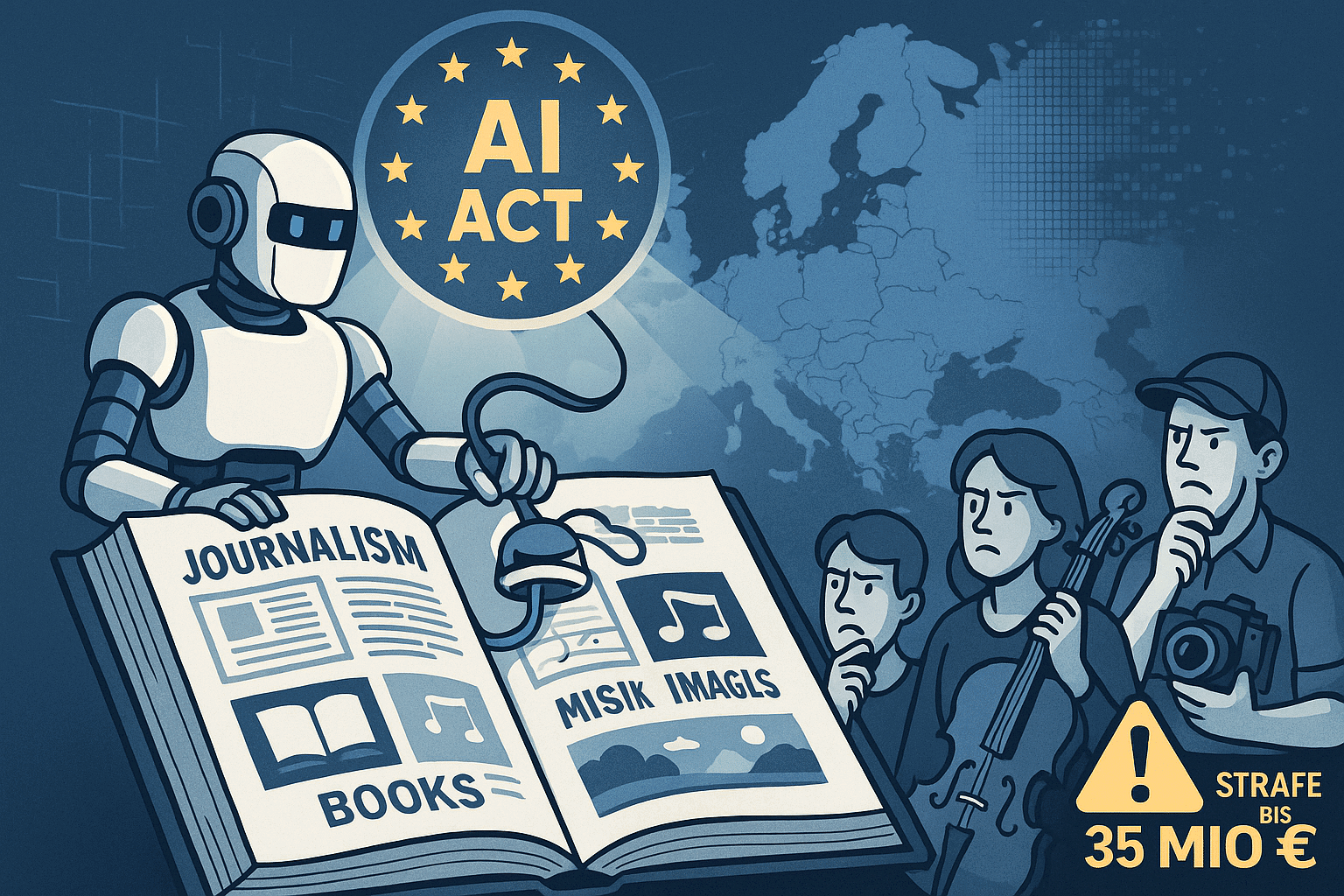

Es ist vollbracht: Nach drei Jahren Arbeit greift die EU-KI-Verordnung nun auch für die KI-Giganten wie ChatGPT, Gemini und Claude. Was bedeutet das konkret? Schluss mit den Geheimnissen rund um Trainingsdaten. Die Anbieter müssen ab sofort offenlegen, mit welchen urheberrechtlich geschützten Inhalten sie ihre Systeme gefüttert haben. Ein Paradigmenwechsel, der die gesamte KI-Branche zum Umdenken zwingen wird.

Von der Blackbox zur Glasbox

Bisher war es ein offenes Geheimnis: Millionen von Büchern, Artikeln, Bildern und Videos flossen heimlich in die Trainingsdaten der KI-Systeme. Künstler, Autoren und Verlage erfuhren oft erst nachträglich – wenn überhaupt –, dass ihre Werke für das Training von ChatGPT oder anderen KI-Modellen verwendet wurden. Diese Intransparenz gehört nun der Vergangenheit an.

Der AI Act ist die weltweit erste umfassende Regulierung künstlicher Intelligenz und folgt einem cleveren risikobasierten Ansatz: Je gefährlicher eine KI für Mensch und Gesellschaft, desto strenger die Regeln. Seit heute gelten die Vorschriften für sogenannte „General Purpose AI“-Modelle (GPAI) – also genau jene Allzweck-KI-Systeme, die praktisch jeder nutzt.

Der Zeitpunkt ist kein Zufall: Als die EU 2021 mit der Arbeit am AI Act begann, gab es ChatGPT noch gar nicht. Der Boom der generativen KI kam erst 2022, weshalb die Regeln für diese mächtigen neuen Systeme nachträglich eingefügt werden mussten.

Konkrete Pflichten für KI-Anbieter

Die Kernforderung der Verordnung lautet: völlige Transparenz über Trainingsdaten. Anbieter wie OpenAI oder Google müssen eine „hinreichend detaillierte Zusammenfassung“ aller urheberrechtlich geschützten Werke veröffentlichen, die sie zum Training verwendet haben.

Konkret bedeutet das: Wenn ChatGPT mit Harry Potter-Büchern, SPIEGEL-Artikeln oder Getty-Images-Fotos trainiert wurde, muss OpenAI das offenlegen. Was bisher ein gut gehütetes Geschäftsgeheimnis war, wird zur Pflichtangabe.

Zusätzlich müssen die Anbieter ihre KI-Systeme so programmieren, dass sie möglichst keine Inhalte erzeugen, die ihrerseits Urheberrechte verletzen. Wenn eine KI plötzlich originalgetreu längere Harry Potter-Passagen oder Beatles-Songtexte ausspuckt, verstößt das gegen die Verordnung.

Die EU macht auch technische Vorgaben: Wer seine Website mit einem entsprechenden Roboter-Ausschluss versehen hat – also technisch signalisiert „crawlt mich nicht“ –, dessen Inhalte dürfen nicht mehr für KI-Training verwendet werden. Ähnlich wie es robots.txt-Protokolle für Suchmaschinen gibt.

Drastische Strafen bei Verstößen

Die EU meint es ernst mit der Durchsetzung: Bei den schwersten Verstößen drohen Bußgelder von bis zu 35 Millionen Euro oder 7 Prozent des weltweiten Jahresumsatzes – je nachdem, was höher ist. Für Tech-Giganten wie Apple oder Microsoft wären das potenziell Milliarden-Strafen.

Allerdings gibt es noch eine Gnadenfrist: KI-Modelle, die bereits vor dem 2. August 2025 auf dem Markt waren – also praktisch alle aktuellen Systeme –, haben noch zwei Jahre Zeit bis zur vollständigen Konformität.

Das Problem liegt derzeit noch in der Durchsetzung: Die liegt bei den nationalen Behörden, und Deutschland hat seine KI-Aufsicht noch nicht komplett aufgebaut. Die Bundesnetzagentur soll diese Rolle übernehmen, aber die Strukturen sind noch im Aufbau.

Trotzdem nehmen die Unternehmen das Gesetz bereits ernst: OpenAI, Google und Meta arbeiten an der Umsetzung. Denn wer den europäischen Markt verlieren würde, büßt Milliarden an Umsatz ein.

Neue Chancen für Kreative

Für Autoren, Journalisten und andere Kreative eröffnen sich völlig neue Perspektiven. Die Verordnung schreibt zwar Transparenz vor, regelt aber nicht automatisch Vergütungen. Wenn ein Verlag erfährt, dass seine Artikel für ChatGPT-Training verwendet wurden, kann er noch nicht automatisch Schadenersatz fordern.

Aber: Die Transparenz schafft erstmals die Grundlage für Verhandlungen und Klagen. Verlage und Autoren wissen jetzt, wer ihre Werke wie verwendet hat. Das stärkt ihre Verhandlungsposition erheblich.

Erste Bewegung ist bereits sichtbar: Verlage wie Axel Springer und News Corp haben Lizenzdeals mit OpenAI abgeschlossen. The New York Times und andere klagen gegen KI-Anbieter. Die Transparenzpflicht wird solche Auseinandersetzungen beschleunigen.

Für kleinere Kreative entstehen neue Chancen: Spezialisierte Agenturen könnten ihre Rechte bündeln und kollektiv vertreten. Ähnlich wie bei der GEMA für Musik könnte es Verwertungsgesellschaften für KI-Training geben.

Ein neuer Markt entsteht

Langfristig dürfte sich ein echter Markt für Trainingsdaten entwickeln. Qualitativ hochwertige, rechtlich saubere Datensätze werden wertvoll. Das könnte paradoxerweise dazu führen, dass gute Inhalte in Zukunft doppelt vergütet werden: einmal vom Leser oder Zuschauer, einmal vom KI-Anbieter.

Die EU-KI-Verordnung markiert einen echten Wendepunkt: Was jahrelang im Verborgenen geschah – das massenhafte Sammeln kreativer Werke für KI-Training –, muss jetzt ans Licht. Ob das zu fairen Vergütungen für Kreative führt, wird sich zeigen. Sicher ist: Die wilden Zeiten der KI-Entwicklung, in denen sich jeder einfach bedienen konnte, sind endgültig vorbei.

Die Transparenzpflicht ist nur der erste Schritt. Doch sie könnte die Weichen für eine gerechtere Verteilung der Gewinne aus der KI-Revolution stellen. Gut so.