GeoSpy AI: Wo wurde das fotografiert?

Eine neue KI findet heraus, wo ein Foto aufgenommen wurde – und das manchmal schon erstaunlich präzise.

Ein Bild sagt mehr als Tausend Wort?

In vielen Fällen schon – und wenn ein Foto mit einer modernen Digitalkamera oder einem Smartphone aufgenommen wurde, ist die Chance groß, dass die Kamera die genaue Position der Daten in Form von GPS-Daten in den sogenannten Metadaten des Fotos speichert (EXIF).

GPS-Daten in Fotos

Dabei werden die genauen GPS-Koordinaten des Aufnahmeortes gespeichert. Um diese Geolokationsdaten anzeigen zu lassen, können gängige Bildbetrachter und Bildbearbeitungsprogramme verwendet werden. In vielen Programmen findet sich eine Option, die es ermöglicht, die EXIF-Daten eines Bildes einzublenden. Dort lassen sich dann die GPS-Koordinaten sowie oftmals auch weitere Informationen wie Aufnahmedatum und -zeit ablesen.

Einige Anwendungen bieten darüber hinaus die Möglichkeit, die Geokoordinaten direkt in einer Kartenanwendung anzuzeigen, wodurch der exakte Aufnahmeort auf einer Landkarte verortet werden kann.

Diese Daten zu nutzen ist also naheliegend. Wer schlau ist, entfernt diese Metadaten, bevor ein Foto online gestellt wird – zumindest wenn man nicht möchte, dass andere erfahren, wo das Bild entstanden ist.

Doch jetzt kann auch Künstliche Intelligenz (KI) verwendet werden. KI kann mittlerweile herausfinden, wo eine Aufnahme entstanden ist – die genaue Position, in vielen Fällen auf wenige Meter genau.

Geospy analysiert die Bildinhalte

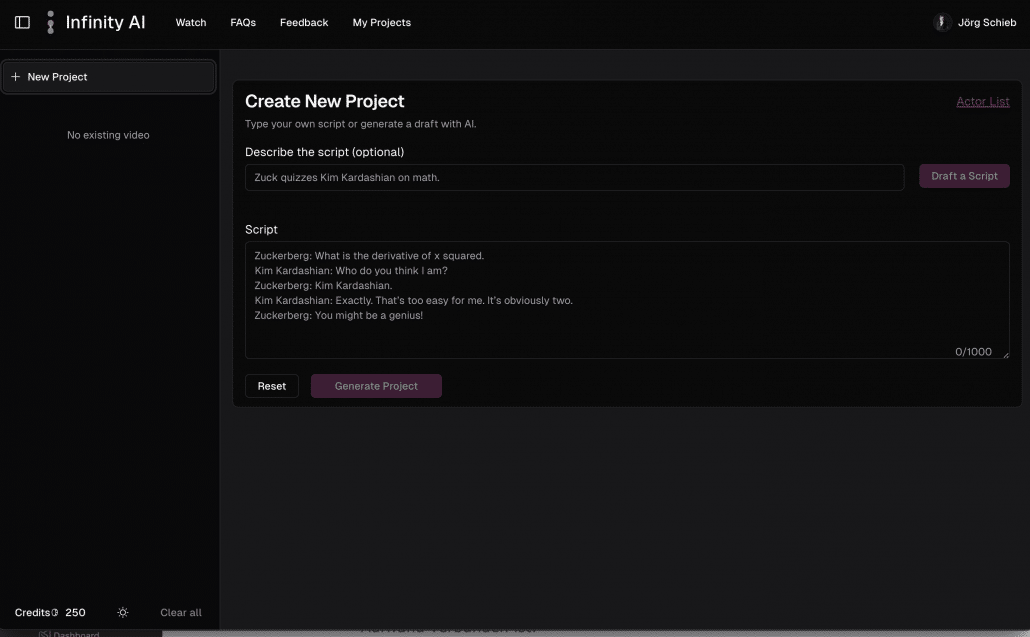

Eine neue KI namens Geospy AI verspricht genau das: Wer die öffentlich zugängliche Webseite unter geospy.ai besucht, sieht erst mal eine wenig schmuckvolle Webseite – und kann in das vorgesehene Feld per Drag and Drop ein Foto ablegen. Einfach einen Schnappschuss aus dem letzten Urlaub reinziehen und sehen, was passiert…

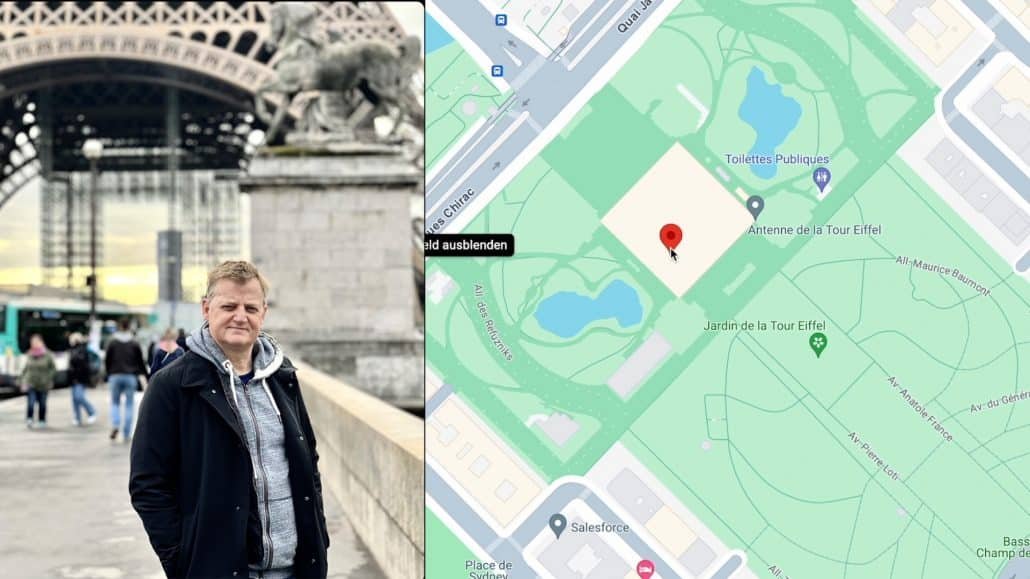

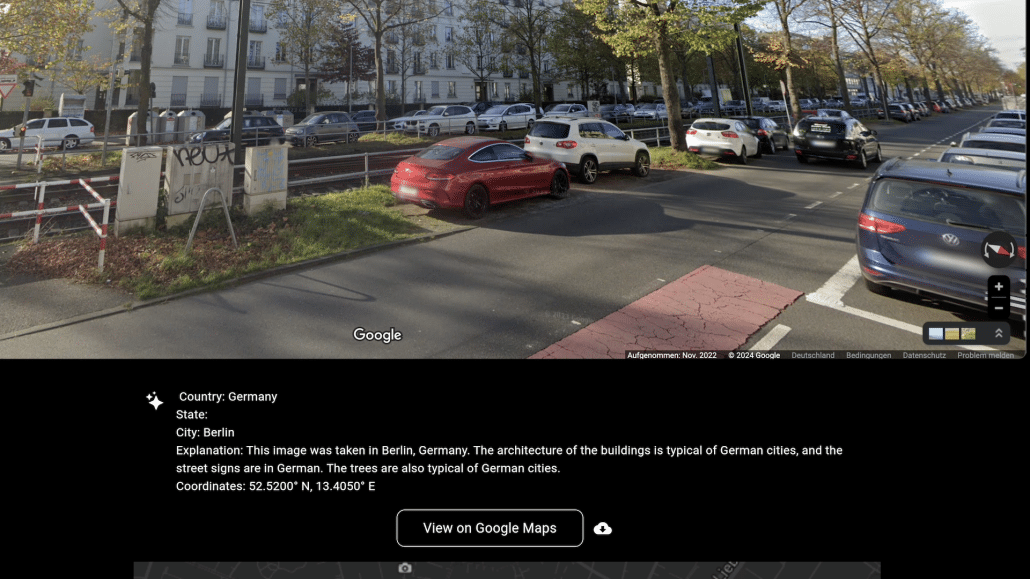

Geospy AI liefert bereits nach wenigen Sekunden eine erste Analyse von dem, was im Bild zu sehen ist. Die KI beschreibt die Architektur und für welches Land oder Gebiet sie typisch ist, achtet auf markante Bedachung, das Layout der Autokennzeichen, die Art der Vegetation und die Natur an sich – viele Merkmale, die für die Bestimmung eines Ortes relevant sein könnten.

Und das, ohne auf das genannte Geo-Tagging in den Fotos angewiesen zu sein.

Treffgenauigkeit fällt unterschiedlich aus

Je nachdem, wie umfangreich und konkret die ermittelten Indizien sind, gibt Geospy AI eine Einschätzung ab. Eine frontal fotografierte Hausfassade führt nicht zum Ziel, ein Foto mit mehreren Gebäuden im Hintergrund schon eher. Wenn alles passt, nennt die KI einen konkreten Ort, manchmal sogar eine genaue Position.

In diesen Fällen präsentiert die KI unmittelbar unterhalb der kurzen Beschreibung auch noch eine Karte von Google Maps, mit der genauen Position, an der das entstanden sein könnte. Ein Klick, und man kann sich an dem Ort umschauen. In bestimmten Situationen – immer dann, wenn sich die KI absolut sicher ist – wird einem sogar die Blickrichtung des Fotografen angezeigt.

Selbsttest: Mal super, mal Voodoo

Ich habe das natürlich auch selbst ausprobiert. Da hat das häufig gut geklappt: Markante Gebäude oder Gegenden wie „Covent Garden“ in London identifiziert die KI völlig korrekt.

Vor allem bei Fotos, die Gebäude einer Stadt zeigen, scheint die Trefferquote hoch, mitunter auf wenige Meter genau. In anderen Fällen wird nur der Ort genannt, in der die Aufnahme entstanden sein könnte.

Die Fotos müssen schon einige Auffälligkeiten enthalten: Ein Foto mit einem Kornfeld ohne andere Hinweise führt bislang nicht zum Erfolg. Ähnliches gilt für Aufnahmen mit austauschbaren Häuserfronten.

Noch im Betastadium

Noch befindet sich die öffentlich zugängliche KI im Entwicklungsstadium (Betaversion) und produziert auch nach Angaben des Betreibers – ein kleines US-Unternehmen aus Boston – noch häufig Fehler. Doch das Ziel scheint klar: Eine KI anbieten zu können, die in der Lage ist, treffsicher den Aufnahmeort jedes Fotos zu identifizieren.

Drei Studenten der US-Universität Stanford haben eine ähnliche KI entwickelt, die sich “Predicting Image Geolocations” nennt (kurz “PIGEON”). Dazu haben die Studenten ihre KI zur wissenschaftlichen Zwecken mit Bildern aus Google Streetview trainiert. Hier sind jede Menge Straßen und Häuser zu finden, auch viele Parke und Naherholungsgebiete.

Trainiert mit Bildern aus dem Netz

Jede KI muss trainiert werden, mit einem sogenannten „Data Set“. Vermutlich wurde auch Geospy – unter anderem – mit diesen Daten trainiert. Je besser dieses Training ausfällt, je mehr solche Bilder verarbeitet werden können, umso besser wird die KI.

Das Unternehmen hat eine Pro-Version angekündigt, die für Strafverfolgungsbehörden, Journalisten und andere Personen entwickelt wird, die regelmäßig ein Foto geografisch zuordnen wollen und müssen. Wenn die KI besser trainiert wird, könnte das auch gelingen. ChatGPT hat in den ersten Versionen auch mehr Unsinn geschrieben als heute.

Missbrauch möglich

Laut Auskunft der Macher ist Geospy gar nicht dafür gedacht, die Privatsphäre von Menschen zu verletzen, sondern im Gegenteil: Das Projekt soll die Sensibilität erhöhen.

Denn für alle, die regelmäßig Fotos in Social Media posten, bedeutet das: Vorsicht! Schon jetzt lässt sich möglicherweise der Ort ermitteln. In wenigen Monaten sogar sehr wahrscheinlich. KI-Systeme wie Geospy mögen für die Polizei nützlich sein, könnten aber auch von Stalkern missbraucht werden.